随着人工智能技术的迅猛发展,大语言模型(LLM)在自然语言处理领域展现出前所未有的强大能力。然而,尽管这些模型在生成流畅、逻辑连贯的文本方面表现优异,它们在处理冷门或最新实体知识时仍存在明显的不足。这些不足不仅导致生成内容的事实不准确,还可能引起所谓的"幻觉"问题,即模型凭空编造信息。为了解决这一挑战,检索增强生成(Retrieval-Augmented Generation,简称RAG)作为一种新兴技术获得广泛关注。RAG通过引入外部知识库进行实时检索,辅助语言模型生成更准确、更具参考价值的内容。然而,RAG的关键环节之一是检索效率和准确度,而这正是瓶颈所在。

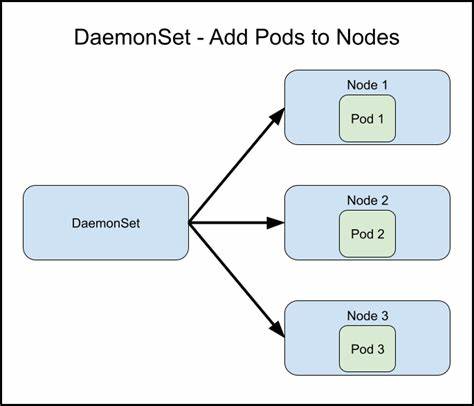

传统的基于嵌入向量的检索方法受到语言模型本身训练数据的限制,对于冷门或更新实体的识别与匹配能力不足。知识嵌入(Knowledgeable Embedding)技术应运而生,成为提升RAG表现的有效途径。知识嵌入通过动态注入实体知识,将现实世界的知识以结构化的形式融合到嵌入向量中,使得模型的理解和检索能力显著增强。这种方法不仅能够提升模型对冷门实体的敏感度,还能保证嵌入的时效性和可更新性,极大地缓解了知识陈旧所带来的问题。知识嵌入背后的核心思想在于将实体嵌入独立存储,并通过专门的实体链接器识别文本中的实体,将其对应的知识注入到模型嵌入中。这种方式使得实体知识的更新无需重训练整个模型,仅需替换或增加实体的嵌入即可完成,极大降低了维护成本和更新难度。

知识嵌入技术具备良好的扩展性,支持利用不同知识库作为实体知识源。默认情况下,维基百科被广泛应用,因其覆盖面广泛、更新频繁,且知识结构化程度较高。除此之外,任何具备丰富实体信息的知识库均可接入,满足不同行业和应用场景的需求。此外,知识嵌入技术基于多款高效的开源模型,如基于BERT、RetroMAE以及BGE(Bi-Encoder Representations from Transformers)等预训练语言模型,为嵌入生成奠定坚实基础。推荐使用面向英语的知识嵌入模型kpr-bge系列,因其在识别与理解冷门实体及长期未见实体的查询中表现尤为突出,同时在对普通实体知识查询的处理上也达到行业领先水平。该技术不仅在学术研究中获得认可,同时通过Hugging Face Transformers和Sentence Transformers等流行工具链提供便捷接口,开发者可以轻松将知识嵌入整合到现有的RAG系统中。

简单的代码示例展现了加载预训练模型与对应分词器、输入文本编码成高质量向量嵌入的流程,无需复杂参数调优即可快速上手。值得一提的是,实体知识的持续更新机制设计合理。通过重新构建实体词汇表、实体嵌入向量及实体链接器,用户能够基于最新知识构建新版本的知识嵌入模型,保障知识库的时效性和准确性。同时,支持将更新后的模型推送至Hugging Face Hub,实现模型的分发与共享,推动社区生态的发展。知识嵌入技术在多个实际应用领域展现出广泛潜力。无论是智能客服、专业问答系统还是个性化推荐引擎,准确理解用户查询中的特定实体,并结合实时知识库信息生成详实回答,均大幅提升用户体验和系统可信度。

在法律、医疗、金融等行业,实体知识的精确注入尤为关键,有助于避免因知识缺失带来的决策风险。随着知识嵌入机制的不断完善,未来RAG系统或将更加轻量化与高效化,摆脱对庞大模型参数的过度依赖,实现知识与文本生成能力的有机结合。研究者正在探索更灵活的知识注入方法,包括结合图神经网络处理复杂实体关系、多模态知识融合等方向,拓展知识嵌入的适用范围。总结来看,知识嵌入作为一项创新技术,突破了传统语言模型在实体知识方面的短板,通过动态更新的实体知识注入,极大提升了检索增强生成系统的性能和适应性。它不仅为解决事实准确性问题提供了有效手段,也为智能问答和信息检索领域开辟了新的发展路径。面对信息爆炸和知识快速更新的时代背景,采用知识嵌入的RAG系统将成为未来人工智能的重要基石,推动自然语言理解和生成技术迈入更高水平。

。