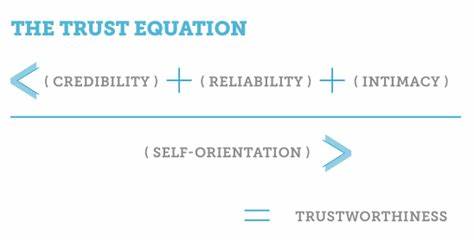

在当今人工智能(AI)日益深入生活的时代,信任已经成为人与机器共存的关键纽带。信任商数(TQ,Trust Quotient)作为一个衡量和评估人工智能系统可信度的指标,其重要性不断凸显,甚至有望超越传统的智能商数(IQ)。信任不仅关乎机器的准确性,更牵涉到安全性、责任感和问责机制。理解信任商数的起源、发展及未来趋势,对我们合理利用AI、推进科技进步以及构建良好的人机关系都具有深远意义。信任与自主权息息相关,任何自主系统的存在都建立在双方互相信任的基础上。人类从育儿教育中学会信任孩子,这种过程也同样适用于AI代理 - - 只有在信任的前提下,代理才能承担起更多自主决策的责任。

机器之间互相协作,同样需要建立复杂的信任链条,确保信息传递及任务执行的有效性。当前,科技领域已经尝试了一些初级的信任管理系统,这些系统主要面向数据安全和身份验证,用于判断设备是否具备访问权限,是否能被信赖执行特定任务。然而,这些系统主要针对的是静态系统,面对行为多变、身份动态且能力逐渐增强的自主AI代理,信任的评估难度更高,对技术要求也更为严苛。购物时判断AI回答的准确性,只是信任的表面体现。随着AI开始介入人类生活的各个维度,从预订机票到管理药物处方,甚至牵涉生命安全,信任的深度和广度都在不断加码。信任既包含安全机制,也涉及系统的可靠性、责任承担和出错后的问责能力。

作为一个复合概念,信任商数将随着AI生态的发展被细化、量化,并逐渐成为衡量AI质量的核心指标之一。未来,用户在选择不同AI应用时,不仅会关注速度和智能表现,还会参考其信任商数。就像电器标注的能耗或数码产品的存储容量,AI的信任商数将成为厂商宣传的卖点。AI系统的风险评估也将成为行业标准,不同任务由于潜在后果的轻重,会被赋予不同的风险系数。比如,处理机票购买的AI与管理处方药的AI,它们的风险等级和信任要求自然不同。个体AI代理基于其过往表现,会动态积累和调整信任分值。

信任的提升往往需要多次成功交互的积累,而一旦发生严重失误,信任值可能瞬间崩塌。多数人工智能的工作将在AI与AI之间悄无声息地完成,只有极少数AI代理会直接与人类交互。虽然相关的AI数量庞大,但人类实际接触的机体有限,这就使得少数与用户直接相关的AI,其信任价值尤为关键。对于面向最终用户的AI代理而言,除了赢得用户信任,也必须选择并依赖其自身信任度高的子代理,构建健全的信任网络。在这一过程中,伪造信任凭证、冒用身份、假冒任务等威胁将层出不穷。对质量和安全的严格监管,成为保护信任体系稳定的关键。

错误的定位和修正同样是信任商数体系的重要组成部分。无论是人类还是人工智能,错误在所难免。如何及时、有效地修正错误,承担相应责任,是高信任代理的标志。最受信赖的AI系统,除了做好自身的决策外,还必须具备足够的能力和意愿来纠正错误。未来,人们将更乐于看到展示信任商数的AI代理,用该指标来衡量代理的真实表现与责任担当。与汽车或手机等传统产品不同,AI的信任商数不仅是自主智能的证明,更代表了一种对人类生活全方位影响的信心。

人类往往避免对彼此进行数值化评分,而AI代理系统则因可采集大量交互数据,信任指数可以被准确测量、比对和公开。高信任商数的AI代理往往也意味着更高的使用成本,但同时,这些代理因广泛的应用和持续的优化而不断进步。未来,每个人和企业都将拥有属于自己的"AI代表",它们将在数字世界中代表其身份和利益,维护资源并展开交互。确保个人AI代理的信任商数处于高位,将成为个人责任的重要组成部分。需要明确的是,这与社会信用评分不同,TQ衡量的是代理本身的可信度,而非个人的社会表现。一个人即便拥有良好社会声誉,其代理若无法获得高信任商数,也可能被其他AI系统拒绝交互,限制其数字生态中的权利。

反之,高TQ的代理可为自身用户赢得更多协作机会和资源分配优势。法律责任方面,随着AI代理介入更为重要且复杂的决策领域,信任商数体系也将影响责任归属的判定。目前,AI尚无法律主体资格,错误产生的后果需由人类承担。然而,随着技术演进,法律体系可能调整规则,将更高级别的责任委托给表现优异且高度可信的AI代理,形成新的监管挑战。总之,信任商数将成为塑造未来AI生态的一项基础指标。它融合了安全保障、可靠执行、错误补救和责任承诺等多重维度,综合体现了AI"人格"的可信赖程度。

信任商数不仅是技术指标,更关乎未来社会秩序的构建、人机关系的重塑以及人类对机器依赖的深度程度。在人工智能日益自主、复杂的时代,建立完善的TQ评估体系,是人类确保科技进步健康可持续的必由之路。 。