在当前的人工智能(AI)发展浪潮中,尤其是在深度学习和推理领域,GPU(图形处理单元)一直被视为核心驱动力。然而,随着对计算能力的需求不断增加,传统GPU架构逐渐面临瓶颈。在这种背景下,Cerebras系统公司凭借其创新技术,正在打破GPU的桎梏,为AI推理带来新机遇。 Cerebras成立于2015年,总部位于加州洛杉矶,致力于开发专为AI工作负载优化的硬件解决方案。该公司的核心产品Cerebras Wafer Scale Engine(WSE)是目前世界上最大的芯片,采用了前所未有的设计思路,能够在单个芯片上集成数以万计的处理核心。与传统的GPU不同,WSE实现了真正的并行计算,显著提高了AI推理的速度和效率。

在传统的GPU架构中,多核处理器之间的通信速度成为限制整体性能的一大瓶颈。尤其是在处理复杂的深度学习模型时,数据传输的延迟往往会造成计算资源的浪费。Cerebras WSE通过将计算单元与内存紧密结合,几乎消除了这一延迟,使得数据可以快速流动,实现即时的推理响应。这一技术创新,意味着AI模型在实时分析和决策支持中的应用将变得更加广泛。 Cerebras还在计算架构上进行了多项突破。其独特的设计使得WSE能够同时处理多个任务,这一点在许多复杂的AI应用中尤为重要。

例如,在医疗图像处理、自动驾驶、自然语言处理等领域,AI模型常常需要在极短的时间内处理海量数据。Cerebras的解决方案正是为了解决这些高并发任务带来的挑战。 除了硬件上的创新,Cerebras同样注重软件生态的建设。由于AI推理不仅仅依赖于强大的硬件,还需要合适的软件平台进行支持,Cerebras推出了专属于WSE的编程框架,使得开发者可以更方便地针对其硬件进行优化。此外,该框架与现有的深度学习库(如TensorFlow和PyTorch)兼容,使得开发者可以轻松迁移现有项目,利用Cerebras的强大计算能力。 尽管Cerebras在技术上取得了显著的进展,但它所面临的挑战也不容小觑。

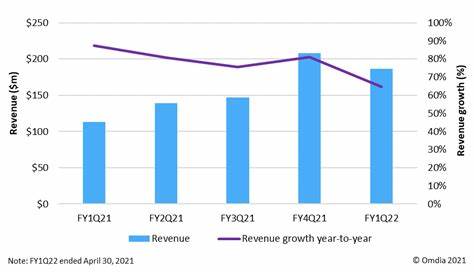

在市场竞争方面,许多科技巨头如英伟达和谷歌也在积极布局AI硬件领域。英伟达在GPU市场已经占据了绝对的主导地位,并且不断推出新一代的高性能显卡;而谷歌则推出了TPU(张量处理单元),旨在提升深度学习任务的计算效率。因此,Cerebras需要在技术创新的同时,寻找合适的市场定位,以在竞争中脱颖而出。 然而,各行各业对AI的需求正在以指数级增长,推动着对高性能计算的持续需求。Cerebras恰好站在了这一趋势的风口浪尖。根据市场调研机构的预测,未来几年内,AI硬件市场将迎来爆发式增长,Cerebras的技术如果能够成功验证,也将使其在这个不断扩大的市场中赢得一席之地。

在实践中,Cerebras的技术已经引起了全球多个行业的关注。例如,许多研究机构正在使用Cerebras的解决方案进行基因组学研究,希望通过AI加速数据分析以解锁更多的生物信息;而在金融领域,机器学习模型的实时推理能力更是可以帮助银行及时发现和防范风险。因此,Cerebras的产品不仅受到科研界的追捧,也被越来越多的企业认同并采用。 此外,Cerebras还积极参与人工智能的科研合作,与各大高校和研究机构建立了紧密的合作关系。这种战略合作不仅加速了技术的验证与迭代,也为Cerebras赢得了良好的口碑和行业认可。通过不断吸取前沿领域的反馈,Cerebras能够及时调整自身的发展战略,确保在快速变化的市场中保持竞争力。

回顾Cerebras的发展历程,它所展示的不仅仅是技术上的突破,更是对人工智能未来发展的深刻洞察。随着AI在各个领域的渗透,对计算能力的需求渴望加剧,Cerebras在这一波浪潮中的表现,无疑为整个行业的发展方向提供了一种新的思路。 在未来的日子里,随着技术的成熟与市场的不断扩展,Cerebras将如何引领AI推理的变革,值得我们拭目以待。打破GPU瓶颈的Cerebras,或许正在为AI的美好未来铺设一条崭新的道路。