随着人工智能技术的飞速发展,基于大型语言模型(LLM)的应用愈发广泛,而Claude-code代理作为一款创新性工具,却在连接Anthropic Claude与OpenAI生态系统之间架起了一座桥梁。Claude-code代理的核心价值是能够将Claude API请求转换为OpenAI格式的调用,使得开发者无需修改原有请求,即可利用众多支持OpenAI协议的服务提供商,包括OpenAI官方、Azure OpenAI、本地模型及其他兼容API,为开发工作带来了极大的便利。Claude-code代理兼顾了灵活性与兼容性,摒弃了传统接口锁定带来的局限,它通过/v1/messages端点的完整支持,实现了Claude消息交互接口的无缝转接。无论是大规模模型(BIG)、中间模型(MIDDLE)还是小规模模型(SMALL),代理都能智能映射,确保调用时准确匹配对应的后端模型,满足不同场景下的性能与资源需求。同时,代理支持函数调用,能够正确转换工具调用请求,极大提升了其在复杂应用中的适用性。实时流式响应是Claude-code代理一大技术亮点。

借助Server Sent Events(SSE)技术,它为用户提供了流畅的交互体验,保证了对话的实时性和互动性。这一点对于开发者来说尤为重要,因为流式传输避免了等待完整响应的时间,令应用更加灵敏和用户友好。此外,该代理支持图像输入的base64编码处理,为多模态应用扩展了可能。错误处理方面,Claude-code代理同样表现出专业水准。代理具备完善的异常捕获和日志记录机制,确保在面对网络异常或API调用失败时能迅速定位问题,保障系统的稳定运行。对于构建在Claude Code CLI之上的开发环境而言,代理简化了配置流程。

用户只需配置好环境变量,如API密钥、模型映射、服务器地址等,即可快速启动代理服务,兼容多种部署模式,包括本地环境、容器化和使用UV等运行时。多样化的环境变量配置赋予了用户高度自由度,其中关键变量如OPENAI_API_KEY和ANTHROPIC_API_KEY帮助实现安全访问和调用鉴权,而模型变量如BIG_MODEL、MIDDLE_MODEL、SMALL_MODEL则方便用户根据实际需求调优模型性能。代理的架构蕴含性能优化思想,异步编程模式配合连接池技术,有效提升了高并发请求下的响应速度和资源利用率。这使得Claude-code代理不仅适合个人开发者使用,也适合企业级大规模部署。在具体应用场景中,无论是通过Python的httpx库调用API,还是直接在命令行下通过Claude Code CLI调用代理服务,流程简单且高效。代理的灵活性进一步体现于它支持多类后端提供商,从OpenAI官方API到Azure OpenAI、甚至本地搭建的Ollama模型,都可通过配置即刻集成,降低了跨平台适配成本。

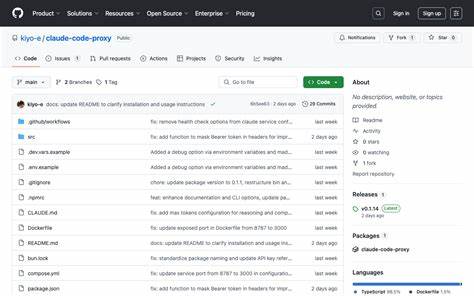

对于开发者社区而言,Claude-code代理作为开源项目,拥有活跃的贡献者阵营和频繁的维护更新,确保了持续的功能完善和兼容性支持。详细的文档和示例代码也极大降低了入门门槛,使得团队协作与二次开发更加顺畅。总结来看,Claude-code代理不仅解决了Claude与OpenAI系列API兼容性难题,更通过其全面的功能支持、灵活的配置选项和卓越的性能表现,助力开发者高效构建创新型应用。面对日益多样化的LLM服务环境,它无疑是一款不可或缺的中间层工具,适用于想要快速切换不同服务提供商、提升系统兼容性和扩展能力的技术团队。未来,随着AI模型的持续迭代与开放接口的丰富,相信Claude-code代理将不断进化,带来更加广泛和深度的应用可能,推动智能交互技术迈向更高峰。