随着人工智能与自然语言处理技术的飞速发展,语音控制正在逐渐成为电子游戏交互领域的重要革新方向。尤其在实时战略(Real-Time Strategy,RTS)游戏中,玩家需要迅速做出决策并精准指挥单位,传统的鼠标键盘操作虽细致但存在一定的限制。借助大型语言模型(Large Language Models,LLM)智能代理,语音控制为RTS游戏带来了更为自然、高效且沉浸感强的体验。本文将围绕语音控制RTS游戏的原型制作,重点解析如何结合LLM智能代理实现有效的语音指令理解和策略执行,开启互动式游戏新时代。 实时战略游戏强调实时的战略规划、资源调配与战术执行,玩家需在动态变化的战场环境中管理多个单位与建筑,指挥复杂的操作流程。传统交互模式下,玩家通过点击、拖拽等鼠标操作以及快捷键输入完成指令。

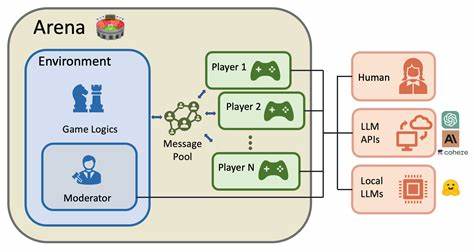

然而,当游戏规模扩大、操作复杂度提升时,玩家往往需要花费更多精力学习繁琐的操作方法,影响游戏体验的流畅度和投入感。语音控制作为一种直观自然的人机交互方式,可以极大降低玩家操作门槛,使得指挥如同口头交流般快捷自然。 实现语音控制RTS游戏的关键在于精确地捕捉和理解玩家的语言指令,并将其转化为游戏中的具体操作。这里,大型语言模型智能代理扮演着核心角色。基于深度学习的LLM具备强大的语义理解能力,能够识别复杂、多样的指令形式,不仅限于预设的命令模板,从而支持更加灵活多变的语音输入。通过训练和微调模型,系统能够理解游戏内特定的战略术语、单位命令及上下文信息,提升指令解析的准确率。

在语音识别环节,现代的自动语音识别(ASR)技术配合高性能麦克风和降噪算法,保障了指令输入的清晰度和准确性。语音识别的输出文本被送入LLM智能代理,依托其上下文感知能力和推理功能进一步处理指令的语义。为了实现实时响应,系统需要优化模型推理速度,确保语音指令能迅速转换为游戏行动,避免延迟影响玩家体验。 游戏原型设计中,需要充分考虑命令映射策略。语音指令和游戏操作之间的映射并非一一对应,而是包含多层嵌套和逻辑判断。例如,玩家说“派兵攻击东侧敌军据点”,系统不仅需识别“派兵”、“攻击”、“东侧敌军据点”的关键词,还要关联游戏当前地图位置、单位状态以及战情动态,智能代理需进行推理后生成最合适的执行指令。

此外,系统应支持模糊指令处理,针对不明确或部分缺失的信息,通过上下文推断或向玩家反馈确认,实现高容错率的交互。 为了提升互动的自然程度,结合LLM代理还可实现对话式交流。玩家不仅能下达指令,还能通过问答互动了解游戏状态、请求策略建议或调整战术规划。这种双向沟通机制大大丰富了游戏的策略深度与玩家的沉浸体验,使得语音控制不再只是单向指令输入,而是演变为智能助理式的战略顾问。 开发语音控制RTS游戏原型时,设计团队需跨领域协作,涵盖语音识别、自然语言处理、游戏引擎开发及用户体验设计。迭代测试过程非常重要,通过用户反馈不断优化语音指令识别准确性、智能代理响应逻辑及交互界面。

玩法设计也需适配语音输入特点,平衡指令简洁性与策略复杂性,确保游戏既富有挑战性又易于操作。 当前阶段,语音控制RTS游戏仍处于探索与原型验证阶段,但其潜力巨大。随着LLM技术和计算能力的持续进步,未来的游戏将更加智能化,玩家与游戏世界的交流将突破传统操作模式,迈向更为人性化和沉浸式的体验。此外,多模态交互结合语音、手势及视觉识别技术,将进一步提升游戏控制的精准度和自由度。 综上所述,通过引入大型语言模型智能代理来实现语音控制RTS游戏,不仅解决了操作复杂带来的痛点,更开创了人机交互的新纪元。未来,随着技术的成熟和创新,语音控制将成为游戏设计的重要方向之一,助力打造更具沉浸感和互动性的战略游戏体验。

接下来的文章将深入剖析具体技术实现细节、架构设计与原型开发过程,期待为游戏开发者提供有价值的参考与启示。