随着人工智能辅助编码工具的普及,GitHub Copilot因其强大的代码生成能力而受到广大开发者的欢迎。作为Copilot的增强服务版本,Copilot Premium为用户提供了更智能的模型支持和更灵活的使用体验。然而,近期部分Copilot Premium用户反映出现了令人困惑的无端请求现象,即系统在用户未主动操作的情况下产生大量高频率的Copilot高级请求,给用户带来了不小的经济压力和使用上的困惑。了解这一问题的背景和具体表现,有助于用户更好地评估自身使用策略,避免因异常请求带来的额外费用和潜在安全风险。首先,关于异常请求的具体表现,用户反馈普遍集中于每分钟产生多达数次的Copilot Premium请求,尤其是指向被称为“Padawan”模型的请求源。这些请求似乎在用户未主动调用Copilot或Copilot Agent的情况下自动发生,且即使用户关闭或撤销了与GitHub内部智能代理如SWE Agent的相关权限,异常请求依旧持续。

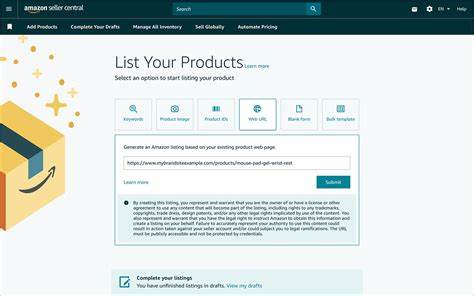

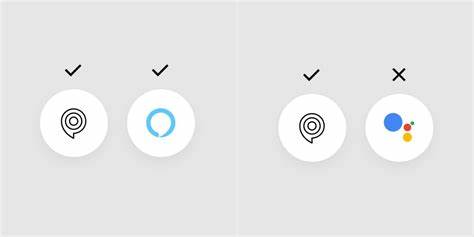

另一个令人疑惑的现象是,这些消耗请求并没有在GitHub Web界面的标准计量使用页中显示,用户需要额外下载“Copilot高级请求使用报告”才可查看详尽数据。这种使用数据的不对称展示让用户难以即时监控和控制其实际消耗,从而在账单结算时造成意外开支。针对以上问题,探究这种无解释的请求原因成为关键。可能的原因之一是内部服务或集成应用自动触发的后台调用,这些调用未被明确定义为终端用户直接发起,导致计费系统依然将其计入使用额度。另一种可能是某些第三方扩展或IDE插件存在问题,错误调用了高阶模型API,从而产生了大量额外请求。此外,部分用户怀疑与GitHub的某些自动化流程或监测机制有关,这些流程可能为了维护服务稳定性或数据同步,在后台频繁请求模型,用户本人无感。

无论具体源头为何,用户均遭遇了预算超支与监控困难的双重挑战。由于GitHub目前尚未在Copilot Pro+账号及以上版本中提供针对高级请求的预算限制功能,用户无法通过自定义阈值来阻止意外的费用发生。这种缺失导致即使用户察觉到异常调用,也难以设置硬性控制措施避免账单激增。此外,由于计费逻辑的复杂性和隐蔽性,用户很难自行诊断到底是何种客户端或服务引发了异常请求,这增加了问题排查的难度。针对以上状况,GitHub官方尚未给出明确的公开回复和解决方案,用户只能求助于GitHub客服或相关支持渠道,希望取得更多信息及防护建议。同时用户社区中也展开了多角度尝试,如临时关闭集成应用、暂停插件服务、监控API访问日志等方法,以期尽快定位问题根源。

截至目前,这些方法对于减少异常请求有部分帮助,但并不能完全根治问题。从长远角度出发,此类Copilot高级请求异常现象反映出AI代码辅助工具商业化进程中出现的技术和管理挑战。一方面,智能辅助技术依赖于后台模型进行复杂计算与交互,导致使用行为的透明度大幅降低。另一方面,复杂计费机制与多样化的用户接口环境带来了额外的使用风险与成本负担。为此,服务提供商需要进一步优化调用监控和用户控制面板,提供实时流量分析和预算限制功能,让用户清楚掌控每一次请求的费用归属和调用动因。对于用户来说,保持对系统调用和集成应用的定期检查,谨慎授权第三方插件权限,是避免无谓消费的有效手段。

此外,应及时关注官方公告和用户社区动态,获取最新问题解决信息,确保自身权益。整体而言,GitHub Copilot作为人工智能编码革命的重要驱动力,其高级服务版本在性能和便利性上优势显著,但也暴露出计费与使用监控的不足。面向未来,如何在提升AI辅助能力的同时,保障用户利益不被无理损害,将成为普遍关注的议题。技术服务商与用户之间需要基于开放透明的沟通机制,共同构建健康持续的使用生态。总结来看,面对GitHub Copilot高级请求异常频发的情况,用户应保持警觉,主动排查潜在影响因素,积极寻求官方支持,并在日常使用中强化成本控制意识。只有这样,才能在享受创新工具带来生产力提升的同时,规避因系统异常导致的经济风险。

随着相关政策和技术的不断完善,相信异常请求问题将逐步得到有效缓解,Copilot Premium也将迎来更加稳定可靠的使用体验。