近年来,人工智能技术的迅速发展为软件开发领域带来了前所未有的变革。自动代码生成、智能代码补全以及基于AI的漏洞检测等工具极大地提升了开发效率和代码质量。然而,Gotosocial作为一个注重社区文化和伦理原则的开源项目,却坚定地宣布将不接受任何由"AI"辅助创作的代码或其他变更。这一决定不仅引起了技术界的广泛关注,也引发了对开源伦理和AI应用边界的深层讨论。Gotosocial是一个以社交软件为核心的开源平台,致力于营造健康、包容且安全的网络社区环境。其团队在最新发布的代码行为准则中明确表示,拒绝吸纳任何来自极端主义、歧视性群体以及那些推行有害社会行为的个人或组织的贡献。

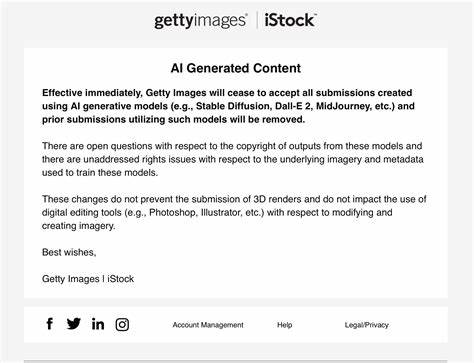

同时,它还特别指出,所有以"AI"工具辅助完成的代码变更都将被拒绝。Gotosocial此举背后的核心考虑在于保护原创者权益和维护社区健康。AI模型的训练往往依赖于大量的数据,其中不乏未经授权使用的代码或内容素材,存在侵犯知识产权的风险。此外,训练过程中依靠大量低薪工人筛选不当内容,这不仅带来了伦理争议,也引发了对劳动剥削的关注。团队担忧,采用由AI辅助生成的代码可能会间接助长这一链条,破坏公正的开源生态系统。另一方面,Gotosocial也反对将开源项目导向企业监控或其他有害的资本主义用途。

通过限制AI生成代码的引入,他们试图避免平台被用于大规模数据监控或滥用,保护用户隐私和信息安全。此种策略凸显了开源社区与商业利益之间的微妙平衡以及价值观的坚持。在更广泛的开源生态中,AI辅助生成代码的使用正在迅速普及,许多项目和企业正积极拥抱这类技术以提高开发速度和降低成本。然而,这也带来了代码质量参差不齐、潜在版权纠纷和维护难度增加等问题。Gotosocial的立场提醒我们,技术的便利应当与道德责任并行,尤其是在公共共享和协作的开源平台上。深入分析其政策,可以发现Gotosocial试图打造一个明确的界限,维护人类开发者的原创贡献及对社区价值的尊重,同时防止技术滥用及可能对社会造成的不良影响。

这不仅是对软件代码的一种保护,更是一种对社区文化和社会责任的坚守。此外,Gotosocial也特别强调不接受任何助长有害社交行为的变更。它承认社交媒体仍是人类探索安全互动方式的试验场,但拒绝容忍鼓励骚扰、歧视和恶意行为的内容。这与拒绝AI生成代码的原则相辅相成,体现了项目对健康数字环境的承诺。Gotosocial的这一政策,也引发了行业专家对AI和开源关系的深入探讨。部分人认为,AI技术应被合理规范和利用,而非完全排斥,毕竟技术本质中立。

另一些人则支持Gotosocial的态度,认为在AI尚未完全成熟并面临版权和伦理多重挑战的阶段,谨慎甚至限制是必要的保护措施。无论观点如何,Gotosocial提供了一个鲜明的案例,表明在技术飞速发展背景下,开源社区有权决定其核心价值观和贡献者行为的边界。通过明确不接受AI辅助的变更,Gotosocial不仅守护了项目的纯粹性,也为全球开源项目树立了可持续发展的伦理标准。展望未来,如何在促进技术创新与保障原创权益、社区健康之间达成平衡,将是更多开源项目乃至整个软件生态需要共同面对的重要课题。Gotosocial的实践经验和思考,或许能为其他项目提供借鉴,推动形成更加规范、公正且富有责任感的开源文化。总的来说,Gotosocial拒绝AI辅助变更的决定,不仅仅是对代码质量的严格要求,更是对开源哲学和社区伦理的深度诠释。

这一行动反映出部分技术社群对于AI带来的机遇与挑战的复杂态度,同时引领了关于开源软件与新兴技术融合的关键讨论。无论是开发者还是普通用户,都应关注这一动态,并思考如何在快速发展的科技时代,共同维护一个公平、开放和健康的数字未来。 。