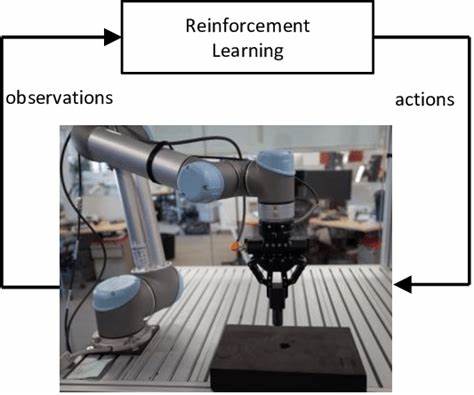

插销入孔任务是机器人操作领域中典型的精密装配挑战,涉及机器人对空间的精确感知与运动控制协调。随着人工智能技术的快速发展,深度强化学习(DRL)逐渐成为解决复杂机器人控制问题的核心方法。尤其是结合视觉反馈的DRL策略,使机器人能够从自身感知视角实时调整动作,显著提升任务的完成度和鲁棒性。本文聚焦于基于PyBullet仿真平台和Gymnasium强化学习环境,利用UR5机器人机械臂执行插销入孔任务的创新实现,介绍其环境设计、算法选择及实验结果,为工业机器人智能化应用提供参考。 UR5机器人因其灵活性和适用性广泛而备受青睐,项目中通过模拟一个装有插销的机械臂终端执行器,搭载一个100×100像素的灰度摄像头,直接拍摄夹持末端视觉图像。这种眼在手(Eye-in-Hand)视觉伺服配置,使机器人能够基于视觉信息即时调整动作轨迹,克服传统外部视觉系统的局限,提高空间反馈精度和时间响应速度。

该环境的观测空间为单通道灰度图像,输入数据原始且信息密度高,有助于深度神经网络自动提取相关特征。动作空间则设计为连续的小幅X、Y、Z轴移动,这种微调动作控制适合惯性及位置误差补偿,确保插销对准孔洞中心。训练中设定成功插入为目标,实现通过接触检测即时判断任务完成与否,若插销触碰到桌面或孔边则判定失败并终止当前训练回合,促使算法学习避免错误行为。 深度强化学习算法方面,项目对比了三种主流策略—软行为者评论家算法(SAC)、近端策略优化(PPO)和优势行动者评论家算法(A2C)。结果显示SAC凭借其采样效率和稳定性,在25万步训练中迅速达到卓越表现,1000回合测试成功率高达95.6%。相比之下,PPO表现适中但不稳定,仅获得26.9%成功率,A2C则在此任务中表现不佳甚至难以收敛。

该成功归功于SAC独特的熵正则化机制,使策略既保证探索充分,又不牺牲已有经验的利用效率。通过连续动作空间设计,SAC能细致调整机械臂位置,实现插销精准对准孔心。训练过程中采用PyBullet物理引擎模拟真实动力学,结合Gymnasium接口简化环境交互,使研究人员能够灵活调试奖励函数和数据采集策略。 任务奖励设计巧妙,将机械腕末端定位靠近目标孔位作为积极激励,并对完成插入予以高额奖励,反之若发生碰撞则给予惩罚并结束当前试验,形成有效的奖惩机制推动策略优化。实验中还开放训练数据记录及TensorBoard支持,方便直观监控学习进度及优化效率。 从硬件需求看,项目利用NVIDIA RTX 3050移动GPU完成训练,体现该系统对算力要求适中,具有广泛的适配能力和易用性。

自动保存的模型检查点和丰富日志文件方便后续复现和模型微调。用户可通过python脚本简单调用主要训练、测试和绘图函数深度定制训练节奏和实验参数。 这一配合视觉反馈的深度强化学习架构,不仅仅提升了机械臂对未知环境的适应能力,还为工业自动化装备提供了稳定可靠的智能控制方案。在电子装配、精密制造等领域,插销入孔任务需求普遍且苛刻,传统依赖高精度传感器和复杂路径规划的方法正逐渐被高效学习策略所取代。 未来,结合更丰富的视觉信息如彩色图像、多视角融合及触觉感知,将进一步增强机器人在复杂装配场景下的操作能力。同时,优化训练算法和环境模拟精度,缩短训练时间和提升样本效率,也是实现现实工业级部署的关键方向。

项目源码基于MIT开源许可,开放于GitHub平台,方便广大科研人员和工程师借鉴改进。依托开源生态,结合PyBullet的高度仿真逼真度与Stable-Baselines3的高效训练框架,构建创新的机器人智能控制管线,实现理论与工业实践的良好结合。 总体来看,利用深度强化学习实现UR5机器人臂精准完成插销入孔任务,展现了深度学习与机器人技术深度融合的强大潜力。通过眼在手视觉伺服、柔性连续动作控制和科学奖励策略,有望推动智能制造进入更高自动化与精准化的新时代。作为未来智能工业的关键组成部分,该研究为机器人自动装配领域提供了宝贵经验与实用方法,期待更多创新应用和技术突破绽放光彩。