2025年,人工智能技术迅速渗透到软件开发的各个环节,其中以自然语言驱动的软件生成技术——Vibe Coding引领了全新的发展潮流。Secure Vibe Coding作为这一趋势的安全实践范式,成为行业关注的焦点。所谓Vibe Coding,即利用大型语言模型(LLM)通过自然语言描述直接生成代码,使得原型开发速度大幅提升,同时降低了技术门槛。然而,随着大量代码由AI自动生成,安全威胁也随之悄然积累,成为业内所称的“silent killer”漏洞。这些漏洞能够完美通过传统测试环节,却潜藏着被黑客利用的安全隐患,极大地挑战了现有的安全防护体系。 Secure Vibe Coding的提出,正是为了解决这一安全盲区。

它倡导通过精准的安全提示(Secure Prompting)、多重自动化检测与人工审核相结合的工作流程,确保AI生成代码不仅高效,还必须是安全可控的。现实中,有数据统计显示,AI辅助代码库中机密信息泄露的概率比传统代码高出40%。这一数字警示着开发者,AI生成代码虽便捷,但若忽略安全要求,后果将极其严重。 从诞生背景来看,Vibe Coding概念由著名AI专家安德烈·卡尔帕西提出,他认为编码正在变成“让代码本身消失,只需沉浸于意图及结果”的过程。以此理念,知名开发者Pieter Levels利用Cursor、Claude等AI工具,仅凭一行简单的自然语言提示,即快速开发出3D浏览器飞行游戏,短短10天便吸引了超过8.9万名玩家。然而他也坦言,快速迭代背后隐藏不少安全风险,尤其是未经充分测试的AI代码往往容易被忽视。

技术上,LLM如GPT-4等虽具有强大代码生成能力,但本质上依赖训练数据和提示词,若未明确要求加入安全防护机制,模型往往会生成缺乏安全加固的代码。例如,在创建登录功能时,AI可能输出明文密码存储或缺乏多因素认证支持的代码片段。这种“安全省略症”成为普遍现象,推动行业重新审视AI的安全治理问题。 Secure Vibe Coding的实施离不开有效的提示词策略。安全研究表明,只有在提示中明确指出需要OWASP十大漏洞的防范、CSRF保护、输入校验、速率限制等高标准安全要求时,AI才会生成符合规范的代码。此外,结合多步提示机制,如先生成代码后请求模型自我审查,也能显著提升代码的安全质量。

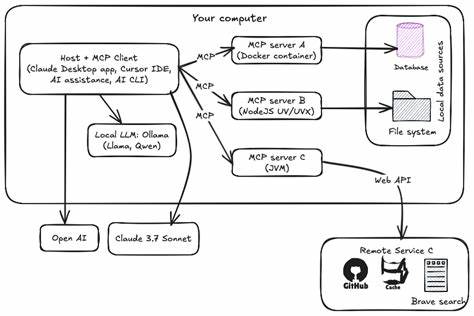

当前市场上多款AI辅助编程工具在安全表现上各有千秋。Claude以保守风格著称,经常主动标注潜在的风险代码;Cursor AI则凭借实时代码静态分析,为开发者敲响安全警钟;而GitHub Copilot紧密集成开发环境,实现了基于上下文的实时漏洞检测,但也有过度依赖上下文导致漏报的挑战。AWS的CodeWhisperer则更侧重于云端安全政策合规的自动识别,这为云原生应用提供了有力保证。综合来看,选择合适的AI工具并结合完善的安全工作流,是实现Secure Vibe Coding的关键。 行业监管层面,欧盟AI法案(EU AI Act)将部分依赖AI生成代码的系统归为高风险人工智能系统,要求企业必须进行合规性评估、维护生成过程的透明度及审计链。这对于银行、医疗、基础设施等关键领域的软件产品提出了更高的安全和合规要求。

基于此,Secure Vibe Coding不仅是技术实践,更是一种合规得分利器。 实际操作中,企业应将安全纳入Vibe Coding的每个环节。开发者应仿佛进行威胁建模一样撰写提示,覆盖常见威胁和安全控制。同时,对AI生成的代码实施自动化扫描,结合Snyk、SonarQube等工具,检测已知漏洞与敏感信息泄露。更重要的是,始终保留人工来复核AI输出,保证安全意识贯穿代码审查和集成部署流程。 Secure Vibe Coding还引发了关于技术民主化与安全保障之间的矛盾。

自然语言接口使得非专业人员也能参与应用开发,但这种便利若缺乏足够的安全培训和权限管理,极有可能埋下系统性风险。许多组织因此推行分级访问策略,将域内专家置于核心控制位置,为普通开发者提供有指导的开发环境,以平衡创新速度和安全风险。 总结来看,Secure Vibe Coding并非取代传统开发,而是作为补充和放大器,有效地加速重复性和样板化任务,快速验证创新功能概念,但仍需资深工程师把关架构设计及整体安全。英文逐渐成为编程语言的一部分,但对底层系统原理的理解依然不可或缺。忽视安全的Vibe Coding仅是在快速失败,唯有将安全第一的理念深植于AI辅助开发中,才能实现真正意义上的可持续创新。 未来,随着AI模型的不断进步和安全防护技术的成熟,Secure Vibe Coding有望成为主流软件开发流程的标配。

借助多层次的安全策略和合规框架,企业能够在享受AI带来的生产力红利同时,有效规避风险,打造稳定、可靠且安全的数字产品。对于开发者而言,学习掌握这一新兴范式不仅是时代所需,更将成为职业发展的关键竞争力。