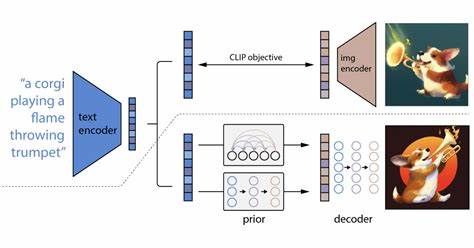

近年来,人工智能领域的快速发展极大地推动了图像生成技术的进步,尤其是文本生成图像模型的广泛应用,为创意设计、广告制作以及数字内容创作带来了革命性变化。然而,训练一个高效且性能优异的文本生成图像模型并非易事,尤其是当团队选择从零开始亲自构建与训练模型时,其复杂度和挑战性更是大幅提升。近日,一支专注于文本生成图像模型研发的团队宣布他们正全力投入从头开发训练一款开放源码的文本生成图像模型,伴随着代码、权重和整个研究流程的公开,展示了人工智能领域里开源合作的典范,同时为业界提供了宝贵的技术资源和借鉴范例。 文本生成图像模型的研发历程充满技术挑战,首先涉及的是模型架构的选择。该团队尝试了多种最新提出的架构设计,包括DiT(基于视觉Transformer的扩散模型)、UViT、MMDiT以及改进的自研Mirage变体。这些架构的核心均围绕如何有效捕捉文本信息与图像信息的复杂关联,并通过优化扩散模型的训练稳定性和生成效率来提升生成图像的质量与分辨率。

通过反复实验与调优,团队逐渐确定了一个既轻量又具备高级生成能力的骨干架构,兼顾训练难度和实际应用的可行性。 在损失函数的设计上,团队广泛尝试了REPA(Representation Alignment for Generation)配合DINOv2和DINOv3视觉特征,以及对比流匹配(contrastive flow matching)等策略。损失函数作为指导模型学习的核心,如何使模型在文本与图像特征分布之间实现最佳对齐,是提升成像效果自然度与细节还原的关键。团队指出,初期启用REPA极大促进了训练收敛速度,但在训练后期关闭REPA反而有助于进一步降低验证损失,这一发现为后续调整和完善损失函数提供了理论支持和实践指导。 编码和解码过程中的变分自编码器(VAE)也是模型性能提升的关键环节。项目中融合了Flux VAE和DC-AE(Deep Compression Autoencoder)两种不同的VAE架构,旨在在保证图像质量的同时有效压缩潜在空间,实现高效解码。

结合最新的文本嵌入技术GemmaT5,模型可以更精准地理解复杂文本描述,从而生成更加贴近语义需求的图像。同时,文本嵌入层作为连接文本输入与视觉生成两个模块的桥梁,实现两者的高效信息传递与交叉理解,也是提升最终生成质量的必备措施。 训练优化方面,除了模型内核的改进,团队还聚焦于训练过程的细节,包括超参数调整、实现细节如指数移动平均(EMA)和数值精度的控制。EMA的加入不仅平滑了模型的权重变化,也有效提升了训练稳定性,提高了最终模型的生成稳定性和图像清晰度。数值精度方面,精准的浮点计算保证了训练过程中损失函数的准确度和梯度的稳定,避免了因数值不稳定导致的训练停滞或模型发散。 此外,整个训练流程涵盖了多阶段策略和新颖技术的探索。

例如利用Muon's优化器针对隐藏层权重进行精细调节,增强了模型层间的协同效应;通过Distillation with LADD(Latent Adversarial Diffusion Distillation)实现了生成速度的大幅提升,使得模型在4步内即可完成高质量图像生成,这是对传统扩散模型生成速度的革命性突破;同时引入Uniform ROPE和Immiscible技术,提升了模型的训练效率并改善了噪声分配策略,进而提高了模型的生成稳定性及细节表现。 训练环境方面,团队选择了64块英伟达H200 GPU组成的强大集群,利用分布式训练技术最大化计算资源效率。训练过程持续约9天,共计1.4百万步,目前产生的最佳检查点基于1.2亿参数规模的Mirage模型,训练分辨率设定为256像素,这一配置在业界来说兼顾了性能和训练成本,保证了模型的可扩展性和适用范围。 团队同样重视训练过程的开放性和透明度,决定将包括代码、模型权重(兼容Hugging Face diffusers架构)以及详细的实验报告公开,所有内容均采用宽松许可证授权,确保社区能够自由使用、修改和二次开发。更难能可贵的是,他们将透明记录训练过程中的成功经验与失败教训,详细解读设计选择和调整思路,分享模型各个阶段生成结果的动画对比,方便研究者直观了解模型演进及改进点,为后续的研究和应用探索奠定坚实基础。 未来,团队计划将训练分辨率提升到512像素,进一步融合Flux VAE与DC-AE技术,强力推进模型生成质量。

在偏好对齐方面,正在尝试使用监督微调和直接偏好优化(DPO)技术,探索模型生成结果与用户期望之间的契合,从而提升用户体验和生成内容的应用价值。同时,团队正在规划更多创新技术的实验和整合,结合社区和行业反馈,不断完善和拓展模型能力。 值得一提的是,团队积极搭建社区交流平台,包括专门的Discord服务器,邀请全球AI研究者、开发者和爱好者参与讨论,分享反馈与思考,一同推动项目迈出更具影响力的步伐。对有志于贡献代码、参与研究的人员敞开大门,形成活跃的协作生态,真正实现开源精神的共建共享。 这项从零开始训练并开源发布的文本生成图像模型项目不仅展示了顶尖的技术实力与严谨的科研态度,也代表了人工智能领域日益增强的开放意识和合作文化。对行业来说,它将成为重要的技术里程碑,为各种实际应用场景提供强大工具支持,同时推动更多创新成果诞生。

对学术界而言,详尽的公开资料和研究过程则是一座知识宝库,助力进一步探索文本与视觉跨模态生成的潜力。作为人工智能领域的参与者或关注者,我们应当持续关注和积极参与这类开源项目,共同描绘技术进步背后的精彩画卷。 。