在当今科技迅猛发展的时代,人工智能(AI)已经成为了各行业不可或缺的一部分。自从机学习(Machine Learning)技术逐渐走入日常生活的每一个角落,其背后的研究推动者与资金来源的变化,开始引发学术界与工业界的广泛讨论与愤怒。随着工业界对AI研究的主导地位日益强化,许多学者开始担忧:当利润驱动成为发展AI的首要动力时,技术的方向与应用是否会背离社会的需要? 在过去,AI的研究多发生于大学和研究机构中,许多基础理论和框架都是由学术界的科研人员所提出。然而,近年来,随着大规模投资和高额利润的出现,AI领域的研究重心逐渐向私人企业转移。以美国为例,2021年,工业界在AI研究和开发上的投入超过3400亿美元,而当年美国政府和欧盟的公共投资总和仅为26亿美元。这种数字上的悬殊,不仅让学术界感到被边缘化,也使得社会对于AI技术的可持续发展和伦理规范产生了深刻的忧虑。

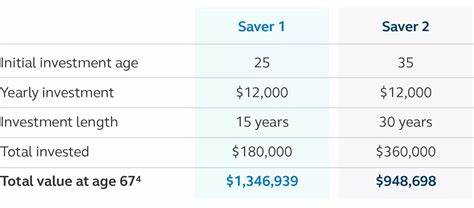

企业在AI模型的研发上,不仅具备更强的资金支持,还能够获取更为庞大的数据集进行训练。他们可以利用自己平台上产生的数据,训练出更为复杂、智能的模型。这使得学术界愈发难以与工业界相抗衡。根据相关研究,2021年,工业界的AI模型平均规模是学术模型的29倍。这种不平衡的资源配置,推动着以利润为导向的研究方向逐渐主导了AI领域的创新与发展。 然而,单纯以盈利为目标的AI研究,显然不能满足社会多样化的需求。

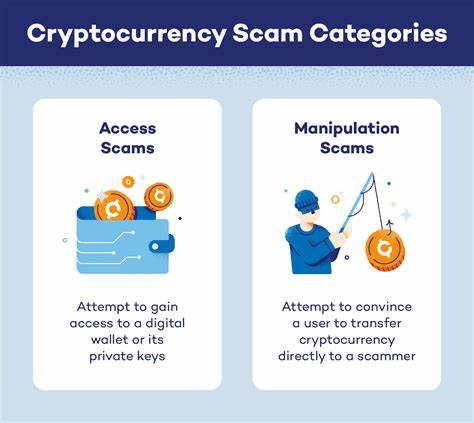

学术界的专家们指出,如果大型公司主导了AI发展的研究方向,那么社会关切的可持续性、伦理问题以及公共利益将得不到应有的关注。正如学者香农·瓦尔洛(Shannon Vallor)所言,这种情况的发生,意味着技术可能在缺乏监督和约束的情况下被滥用,威胁到公众的利益。 对于AI的负面影响,学术界和社会各界的担忧并非空穴来风。由行业主导的AI研究往往专注于商业利益,忽视了这些技术可能带来的潜在危害。例如,在算法的设计上,缺乏对公平性和透明度的关注,可能导致人工智能在决策时引入偏见,从而影响社会的公正与平等。此外,缺乏对AI技术长远影响的研究,可能导致技术的滥用,对社会造成难以估量的后果。

在这种背景下,学术界希望能够恢复其在AI研究中的话语权。学者们认为,基础研究是推动AI负责任使用的关键。通过独立、不以商业利益为导向的研究,学术界可以为社会提供更为全面和深入的AI技术评估。这不仅包括技术的有效性分析,还应涵盖对潜在风险的识别与管理。 为了实现这一目标,学术界需要更多的支持和投资,尤其是在计算能力和大数据访问方面。一些国家,如加拿大,已经采取了一些有效措施,通过合理的资金投入和政策法规,激励大学与工业界的合作,同时也关注公共利益的最大化。

加拿大在AI研究上的投资虽然不如行业那么庞大,却通过集中资源,有效促进了本国在AI研究与应用方面的全球竞争力。 尽管挑战重重,学界依然看到了与产业之间的合作潜力。虽然工业界在资源和资金上占据优势,学术界却拥有灵活的研究路径和独立的观点,高风险的探索和追求新奇的创新,更容易在学术界实现。这样的分工合作,有助于平衡短期商业利益与长远社会利益之间的冲突。 此外,建立一个良好的交流机制也至关重要。学术界与工业界之间可以通过共同的研究项目和技术分享,实现资源的互补。

学术界的研究能够为产业界提供重要的理论指导,而产业界的实践能够为学术研究提供宝贵的实验数据和应用场景。 总之,在面对机器学习和人工智能技术快速发展的当下,如何在商业利益与社会责任之间寻求平衡,成为了摆在我们面前的一道重要课题。我们需要一个透明、负责任的AI生态系统,让技术的发展不仅服务于商业利益,更为整个社会带来积极的变化。只有这样,才能确保AI技术在推动社会进步的同时,也能保护公众的利益,促进社会的和谐与可持续发展。