随着人工智能技术的高速发展,大语言模型已成为推动智能应用创新的重要驱动力。从自动问答、文本生成到辅助决策,LLM的应用场景丰富多样。然而,与其广泛使用相伴随的,是对数据安全性和合规性的重大挑战。特别是在医疗、金融等高度监管行业,企业不仅需要管理好AI模型的输入和输出,还必须确保相关日志记录的不可篡改性和真实性,以满足日益严格的数据审计要求。近日,一款用于大语言模型日志的不可篡改原型工具出现在Hacker News社区,吸引了众多开发者和安全专家的关注。这款工具的核心目标是为每一次模型交互构建“防篡改、保密且可验证”的日志体系,为行业合规和审计带来了全新思路。

本文将深入解析这一创新解决方案的设计理念和技术细节,并探讨其在实际应用中的潜力及未来发展方向。 当前市场上,许多企业习惯将LLM日志写入云存储或自建数据库,采用对象锁(object lock)和版本控制等机制,试图防止日志被非法修改或删除。然而,这些方法存在一定的局限性。云服务提供商虽然能对API调用进行审计,但对具体的模型输入输出文本捕捉和保护往往不足。更何况,如果内部人员拥有修改权限,篡改日志的可能性依然存在。面对日益严格的监管要求,例如医疗健康领域的HIPAA、金融行业的SOC 2标准以及即将实施的欧盟人工智能法案(EU AI Act),仅仅依赖传统日志管理无法彻底保证数据的不可篡改和机密性。

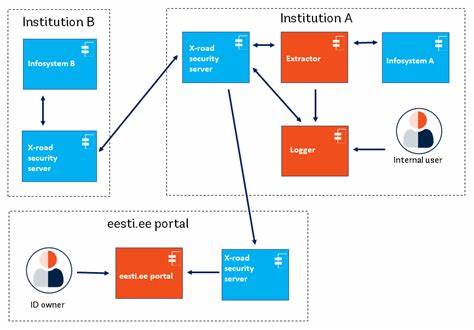

该不可篡改日志原型正是在此背景下诞生。其设计理念首先强调了数据的保密性。所有的提示词和模型输出都经过客户端加密,并使用客户自己的云密钥管理服务(KMS)进行加密操作,确保日志内容在存储和传输过程中不会被日志服务供应商或第三方读取。这种“自带密钥”(Bring Your Own Key)模式极大提升了数据控制权,满足数据主权和隐私合规的要求。日志存储方面,系统采用了可追加的存储结构,类似区块链的链式数据结构设计。每条日志记录通过哈希链接与前一条日志连接,任何对历史记录的篡改都会破坏链条的完整性,使篡改行为一目了然。

同时,该系统定期发布日志批次的公开指纹(公钥哈希),方便第三方审计机构或企业自身在不信任日志提供商的情况下,验证日志数据的完整性和真实性。这种可验证机制不仅提高了日志的可信度,也符合监管部门对审计工具独立性和透明度的要求。在实际应用中,当需要查看或回溯某条日志内容时,只有经过授权的用户才能通过密钥管理系统解密相应条目,从而避免日志数据的过度暴露。同时,这种按需解密机制也优化了存储效率,减少不必要的密钥操作,保证系统的可扩展性。该解决方案的意义不仅体现在技术层面,更为LLM在敏感行业的安全合规打开了新局面。对于医疗机构而言,患者隐私信息与医疗AI互动的日志需要长期保存且不可更改,以便合规检查或临床责任追踪。

金融机构同样需要对自动化交易策略和投资建议的生成过程进行完整记录,以防范潜在的合规风险和法律纠纷。随着欧盟AI法规的推动,所有涉及高风险AI系统的运营均必须满足严格的日志审计要求,该技术无疑为企业提供了切实可行的解决路线。尽管如此,这一原型仍在不断完善中。当前团队期待用户反馈,以识别实际应用场景中可能遇到的缺陷及功能缺口。一些值得关注的扩展方向包括改进日志存储的性能表现,支持多云环境下的密钥管理整合,以及开发更为友好的权限管理界面。此外,鉴于企业内部普遍存在多层次的审计需求,未来或可支持多方多级别的日志访问控制,以满足复杂的合规需求。

行业内目前对防篡改日志的解决方案仍处于探索阶段。许多组织采用自建方法,但往往难以兼顾保密性、不可篡改和易用性。该原型结合了强加密技术、链式数据结构以及公证式验证,使其在保证数据安全的前提下,具备良好的审计友好性和操作便利性,展示了未来AI审计工具的发展方向。总结来看,随着人工智能在核心业务中的普及,大规模的LLM交互数据正逐渐成为企业最宝贵的数字资产之一。如何构建既满足合规要求又能保障数据安全和透明度的日志体系,成为摆在企业面前的重要课题。此次不可篡改日志原型的出现,为行业提供了极具创新性的参考方案。

通过结合加密技术、不可篡改的数据结构和可信公开验证机制,企业能够有效规避篡改风险,确保每一次AI互动背后都有完整可信的审计链条,有力支撑了未来AI治理和监管的需要。随着技术的日益成熟和用户持续反馈的推动,相信这类解决方案将获得更广泛的应用,促进AI技术在合规、可信和安全的轨道上高速发展。对于所有关注AI安全审计、数据合规以及云安全的从业者和开发者而言,紧跟并参与此类创新项目的探讨,将助力实现更加透明和安全的智能世界。