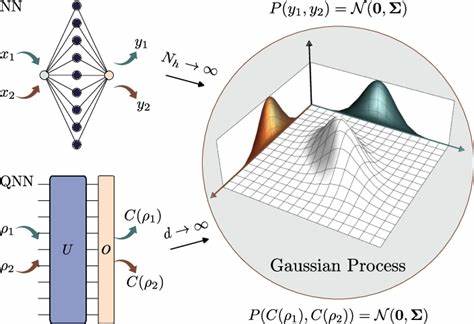

随着量子计算的迅速发展,量子神经网络(Quantum Neural Networks, QNNs)作为量子机器学习领域的重要分支,吸引了众多科学家和工程师的关注。QNNs利用量子态的叠加和纠缠特性,有望在某些复杂任务中展现出超越经典神经网络的性能和效率。近期,科学家们揭示了一个令人振奋的发现:特定条件下的深度量子神经网络输出趋近于高斯过程(Gaussian Processes, GPs)。这一理论突破不仅丰富了对QNN的理解,也为空间维度庞大的量子系统中的贝叶斯推断提供了全新视角,推动量子机器学习技术迈向成熟。高斯过程作为机器学习中的关键方法,以其非参数化的贝叶斯框架广泛应用于回归和分类等领域。传统机器学习研究表明,经典人工神经网络在隐藏层单元数趋近无限时,其输出函数收敛为高斯过程,此性质极大地简化了对其行为的数学分析与应用推动。

而对QNNs而言,其单元表现复杂且受制于量子力学的约束,输入态和测量方式的多样性更让理论研究复杂度陡增。最新研究证明,当QNNs的操作单元通过Haar随机机制从单位ary或正交群中采样时,随着希尔伯特空间维数趋于无限,网络输出的期望值及高阶矩依次收敛至多变量高斯分布。更具体地,这种结果适用于以量子态为输入,经过深度量子线路变换后对特定迹零、方阵为幺正的测量算子进行期望值测量的情境。研究还表明:若测量局限于少量量子比特,利用高斯过程回归进行输出预测表现出高度效率;反之,如测量覆盖大半甚至全部量子比特,预测的难度将指数级提升。此现象与量子设计态的生成和度量集中(concentration of measure)现象交织,为理解量子可训练性、量子信息隐藏及量子电路的复杂度提供了创造性工具。深入探讨可发现,证明这一量子GP收敛性的过程,挑战重重。

经典神经网络GP收敛证明常依赖参数独立同分布和中心极限定理,然而QNN的相关矩阵单元不独立,且受制幺正矩阵的正交性约束,使得矩阵元素协方差具有复杂结构。研究通过计算稳定的矩阵积分,借助Weingarten公式与置换群对称性,推导出所有奇阶矩为零,而偶阶矩依次满足高斯分布的等价条件。引入Carleman条件则确保矩阵元素分布由其矩决定唯一,高斯过程性质由此确立。此外,研究针对不同输入态间相关性提供多种情况分析。当输入状态间的Hilbert-Schmidt重叠强烈时,输出变量正相关;若重叠恰当弱化,输出变量则近似无关;当输入状态完全正交时,输出变量表现为负相关但极其微弱。这些结构不仅对理论证明关键,也对量子数据分类、量子特征映射的设计有重要指导意义。

另一方面,该理论结果为量子机器学习算法在数据回归、时间序列预测、以及变分量子算法优化等方面提供了统计学上的坚实支撑。例如,在量子动力学模拟场景下,通过高斯过程回归推断未来量子状态的测量结果,能显著减少实验测量需求,提升仿真效率。研究团队通过数百万量子比特维度的数值模拟验证了理论预测的准确性,并演示在中小量子比特规模下的可行性,使这一方法兼具理论价值与实践潜力。与此同时,研究亦揭示了量子神经网络训练时的“贫瘠地形”(barren plateaus)现象新视角。以往只凭第一、二矩分析梯度浓缩情况,存在估计宽松问题。通过深入刻画输出分布的高阶矩,证明输出及其参数梯度的尾部概率以双指数速率衰减,表明量子參数空间极大部分区域无梯度信息。

这样的认识加深了我们对量子神经网络训练难题本质的理解,为设计更有效的初始化和量子架构奠定基础。此外,研究扩展到t设计的量子神经网络,即在第t阶统计上等价于Haar随机分布的有限度量单位阵列,说明即使在较弱随机性的真实量子设备情况下,QNN输出依旧具备高斯过程特征。此类架构更贴近实际的近中期量子硬件实现,对算法的鲁棒性和设计提供了理论保障。结合以上理论与数值证据,量子神经网络形成高斯过程的发现为量子机器学习开辟了新路径。它不仅深化我们对QNN行为统计性质的理解,更为基于核方法的量子学习、贝叶斯优化以及跨领域的量子模拟提供了理论工具。结合未来量子计算硬件的发展,量子高斯过程或将成为连接量子信息科学与人工智能的桥梁,其潜力和价值不容忽视。

未来工作有望围绕如何在更广泛的量子架构下验证高斯过程性质展开,探索含噪声环境和非理想装置对理论结果的影响,进而设计出适应性强、泛化能力卓越的量子机器学习模型。总之,量子神经网络输出收敛于高斯过程的理论突破,标志着量子机器学习迈入理论与实践深度融合的新阶段。研究社区正站在这一变革的浪潮之巅,推动更强大、更智能的量子计算应用蓬勃发展,为科学技术和产业革新提供崭新动力。