随着数字阅读的普及,电子书尤其是EPUB格式的电子书受到了广泛喜爱。EPUB作为一种开放标准电子书格式,拥有丰富的结构与排版表现力,能够兼容多种设备和阅读软件。然而,当我们需要将EPUB电子书从一种语言翻译成另一种语言时,挑战随之而来。单纯的文本翻译远不能覆盖EPUB内嵌复杂的HTML或XML标记,还有图片、链接、公式等多种元素需要妥善处理。在技术和成本的双重限制下,如何实现高质量且免费的电子书翻译,成为了许多读者和内容创作者关注的热点。本文将详细阐述利用本地大型语言模型(LLM)翻译EPUB电子书的有效方法,探索实用工具及技术路线,帮助您实现无门槛的多语言电子书制作。

EPUB电子书翻译的核心难点主要体现在几个方面。首先,EPUB文件结构复杂,包含多层文件夹、HTML代码和样式,简单的文本抽取会导致排版混乱甚至信息丢失。其次,许多大型语言模型存在上下文窗口大小限制,不能一次性处理整本书庞大的内容,因此需要对文本进行合理分块。再者,部分电子书含有专业代码段、数学公式或技术图表,这对翻译准确度提出了较高要求。译文不仅要语言通顺,还要保证技术内容的正确与完备。 此外,电子书中的图片与超链接也是必须妥善处理的元素。

图片通常无法通过文本翻译直接转换,需要保留源文件或替换说明文字。超链接则关系到读者的阅读体验,必须确保在翻译过程中链接指向不被破坏或遗失。对初学者而言,最容易忽视但却极为重要的是云端翻译服务的资源限制和安全隐患。在免费云平台如Google Colab的免费版中,因时长限制和算力限制,翻译超长文本容易被中断。与此同时,频繁上传敏感书籍到云端,存在版权及隐私风险。为此,采用本地大型语言模型成为一条理想路径,兼顾成本效益与数据安全。

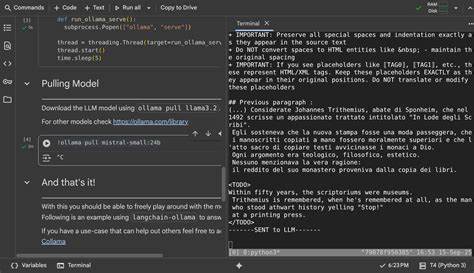

面对上述挑战,一个高效且实用的工作流程是必不可少的。TranslateBookWithLLM工具正是专门为此而设计。它能够自动解压EPUB文件,将内容切割成能够被本地LLM接受的小文本块,帮助用户逐段翻译,同时保留原书的格式和样式。该工具还提供了命令行界面,使专业用户能通过脚本批量处理多本电子书。对于不熟悉命令行的读者,工具配备的Web用户界面则大大降低了门槛,让翻译过程更加直观和友好。 选择合适的LLM是保障翻译效果的关键。

尽管如OpenAI的GPT系列模型功能强大,但使用云端API服务通常伴随高昂的费用和速率限制,不适合免费且长文本的常规电子书翻译。相反,近年兴起的本地运行模型提供了高效且经济的替代方案。Ollama平台通过简洁的界面简化了本地运行大型语言模型的步骤。用户无需进行复杂配置,即可调用多种模型完成文本生成和翻译任务。而基于llama.cpp的C/C++开源项目则支持在多种硬件平台上高效运行轻量级模型,尤其适合具备一定技术基础并希望充分利用本地算力的用户。 在具体模型选择上,gpt-oss 20B模型因其优秀的语言理解能力被广泛关注,但在资源受限的环境如Google Colab免费版中,大型模型往往面临超时或计算资源耗尽的风险。

相比之下,mistral-nemo模型尽管规模较小,智能水平略逊一筹,但其在结构化文本翻译上的表现稳定且速度快,往往能提供两倍于gpt-oss的处理效率。在实际测试中,mistral-nemo翻译技术文档和复杂排版内容的准确度令人满意,是理想的工程应用选择。 例如,使用TranslateBookWithLLM配合本地部署的mistral-nemo模型,可通过简单的一条命令行启动翻译过程,如python translate.py --provider ollama --api_endpoint http://localhost:11434/api/generate -sl English -tl Chinese -i ./book.epub -o ./book-zh.epub -m mistral-nemo。这条命令自动完成了EPUB的读取、章节划分、翻译以及格式重建,输出一份排版完善的中文电子书。 对初次尝试者而言,利用Google Colab上的免费的GPU资源配合Ollama或者mistral-nemo模型,也是一个不容忽视的快速入门途径。Colab提供的免费GPU能够支持4小时左右的模型运行时间足以应对中小型电子书翻译需求。

当然,免费资源自然存在时间和算力限制,若需要处理大批量或超长文本,建议逐步迁移到完全本地环境或购买更高级的算力套餐。 区别于传统机器翻译软件,基于本地LLM的电子书翻译兼具智能理解和保持格式的灵活优势。LLM能根据上下文动态调整翻译风格,避免逐字直译带来的生硬感。此外,保留原始排版和图片的同时,将说明文字和标签置入目标语言,从而在结构和内容上实现完美移植。 目前,随着本地LLM生态的不断壮大和性能提升,更多开源模型可供选择,用户可以根据自身硬件条件和翻译需求自由调整模型大小和精度。搭配TranslateBookWithLLM这一灵活工具,实现了专业电子书翻译从过去繁琐费时到如今自动化、高效化的大跨越。

除了技术实现层面,还应关注版权问题。翻译电子书虽是促进知识传播的重要途径,但务必保证尊重原作者和出版方版权,避免未经允许的大规模传播和商业使用。采用本地处理方式大比例降低了数据外泄的风险,为版权合规提供了基础保障。 总结来看,利用本地大型语言模型免费翻译EPUB电子书,是满足数字时代多语言知识获取需求的实用路径。它突破了传统云端翻译费用和隐私限制,助力个人读者和小型企业自行完成跨语言数字内容的创作与分享。未来,随着本地模型性能不断提升及工具链不断完善,这一方法势必成为电子书多语言化生产的重要趋势之一。

欢迎各位技术爱好者和内容创造者尝试TranslateBookWithLLM结合mistral-nemo或其他本地模型,在免费环境中开启您的电子书翻译之旅。通过学习掌握这个流程,您将拥有一种强大且经济的跨语言内容处理能力,推动数字阅读真正走向全球无障碍。 。