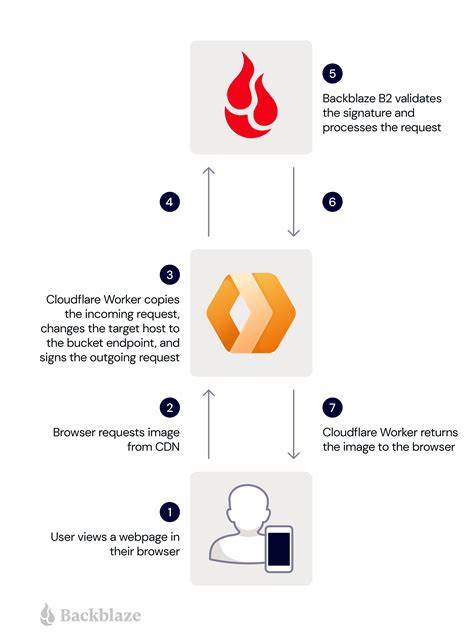

近年来边缘计算成为架构讨论的热门话题,Cloudflare Workers 因为"轻量、瞬时启动、全球分发"的卖点吸引了大量前端和后端工程师。然而在社区里也常常能看到抱怨:Workers 很难调试、路由匹配容易出幺蛾子、遇到复杂状态管理就力不从心。把这些抱怨放在一起,会不会得出"Cloudflare Workers 很糟糕"的结论?答案并非黑白,而是取决于你的需求、预期以及如何规避平台的设计限制。下面从多个维度拆解这些问题,并给出实际可行的解决思路。从"路由匹配"争议切入:问题的本质是什么许多开发者抱怨的一个典型场景是"URL 通配符太容易搞砸"。Cloudflare 在路由层面支持简单的通配符(例如 example.com/foo/* 或 example.com/*),但它并不支持像后端路由框架那样的路径参数化匹配(比如 /users/:id 这种语法)在配置层面不具备精细化的表达能力。

结果是两难:写精确路径 example.com/foo 只能匹配 /foo,但无法匹配 /foo/123 等子路径;改为 example.com/foo/* 之后则会匹配 /foo/123、/foo/123/bar 等所有子路径,容易把不想处理的路径也交给 Worker。理解这个痛点很重要:Cloudflare 的路由匹配设计偏向于"把流量引到边缘",而不是在路由层做复杂的业务判断。为了应对这种限制,一个常见且推荐的做法是在 Cloudflare 路由层使用较宽松的匹配(例如 example.com/*),把路由的精细化控制交给 Worker 内部处理。在 Worker 中可以使用标准化的 URL API 或更强大的 URLPattern 来做路径解析和参数提取。示例思路如下(伪代码说明):const url = new URL(request.url);const pattern = new URLPattern({ pathname: '/api/:resource/:id' });const match = pattern.exec(url);if (match) { // 处理 api 请求,并提取 match.pathname.groups} else { // 直接转发到源站或返回 404}这种做法的好处是把业务路由逻辑放在代码层,避免了在 Cloudflare Dashboard 上频繁调试通配符配置,缺点是 Worker 会收到更多本来不需要处理的请求,需要在代码中尽快判断并放行,以降低额外处理开销。性能、冷启动与资源限制:优势与约束并存Cloudflare Workers 基于 V8 isolates 运行 JavaScript/TypeScript,并支持 WebAssembly,启动非常快、延迟低,这也是它在边缘场景上受欢迎的根本原因。

相比传统容器化函数,Workers 的冷启动几乎可以忽略,对于延迟敏感的请求路由和静态内容处理非常友好。但任何平台都有资源约束。Workers 对单次请求的执行时间、CPU 占用和内存等有配额限制,且不同账号和方案下的限制有所不同。通常建议避免在 Worker 中做长时间的同步阻塞计算,把重计算、数据聚合等操作下沉到后端服务,或拆分为多次短时交互。此外,长期持久化状态不能靠内存,应该使用 Workers KV、Durable Objects 或外部存储。Workers KV 提供全球可读、最终一致的键值存储,适合静态配置和只读缓存;Durable Objects 提供强一致性和单实例语义,适合会话或需要序列化访问的业务逻辑;R2 提供对象存储,无出站流量费是其亮点之一。

成本与计费模型:不要只看表面免费Cloudflare 的免费层对于小规模项目非常友好,但在流量突增或高并发的生产场景下,按请求计费模型会带来即时成本增长。评估成本时要考虑的是请求数量、出站流量、KV/DO/R2 的使用以及可能的付费套餐特权。与 Lambda@Edge、Fastly 等竞争对手相比,计费细节和免费额度不同,量化成本需要基于业务流量曲线做精确估算。此外,把大量业务逻辑迁移到边缘也带来了供应商耦合度上升的风险,长期看需要把迁移成本和锁定成本纳入决策。开发者体验:工具链与本地调试经典抱怨还包括调试和本地测试不够顺滑。Cloudflare 官方提供 Wrangler CLI 来管理项目、打包、发布和绑定资源,但很多团队会觉得原生工具在本地模拟真实运行环境时与线上存在差异。

社区生态中有 Miniflare 这样的本地模拟器,可以更贴近真实行为并支持插件扩展。另外,日志和追踪在边缘平台中较为分散,Cloudflare 提供 Workers 日志功能和 Logpush,但很多团队还需要自建监控和错误上报(例如 Sentry 或自定义上报)来获得端到端的观测能力。调试技巧包括在 Worker 中尽早做路由判断并打印关键上下文到日志,或在开发阶段把大部分逻辑切换到本地模拟器逐步验证。安全、隔离与权限边界Workers 在默认模型下运行在 Cloudflare 的基础设施上,享受其网络层的 DDoS 防护和 TLS 终止等好处。与此同时,代码在沙箱环境中运行,不能直接访问宿主机资源,降低了很多传统漏洞面带来的风险。不过,任何将业务暴露到边缘的设计都会放大访问控制、认证、审计和 API 速率限制方面的挑战。

建议把认证和敏感授权逻辑放到可信的后端服务层,或使用 Durable Objects + Access 控制结合的方式来做更严格的权限管理。生态与替代方案的比较Cloudflare Workers 并非边缘计算的唯一选择。AWS Lambda@Edge、Fastly Compute@Edge、Vercel Edge Functions 和 Netlify Edge Functions 等都在竞相提供不同的权衡。简单对比思考如下:如果你已经深度依赖 AWS 生态,Lambda@Edge 或者结合 CloudFront 的方案可能更容易融合已有 IAM、S3、DynamoDB 等资源。Fastly 以及其 Compute@Edge 更强调高性能 WASM 执行和更细粒度的流量控制,适合对性能有极致要求的场景。Vercel/Netlify 则以出色的开发者体验和与前端框架的整合见长。

最终选择要基于网络覆盖、语言支持、定价模型、现有技术栈和团队熟悉度来权衡。实战建议与最佳实践在决定是否使用 Cloudflare Workers 时,可以参考以下实践思路来规避常见痛点。首先,把路由逻辑下沉到 Worker 内部,使用 URLPattern 做精确匹配,避免在 Cloudflare Dashboard 上穷尽通配符配置。其次,区分"必须在边缘处理"和"可在后端处理"的功能,把短时、低延迟、与请求路径强关联的逻辑放到边缘,其余复杂业务放回中心化后端。第三,利用 Cloudflare 的缓存策略、Workers Cache API 与 KV 缓存热点数据,减少对后端的同步请求。第四,合理使用 Durable Objects 来处理需要一致性或会话语义的功能,但要注意它的流量和地理分布特性,避免把单一对象设计成性能瓶颈。

第五,建立完善的本地模拟与 CI 流水线,使用 Miniflare 或官方的本地工具在 CI 中运行测试,确保部署可重复且可回滚。迁移策略与回退方案如果正在从传统后端迁移部分流量到 Workers,建议采用逐步迁移策略。先选取非关键路径或性能敏感度较低的端点进行迁移,监控延迟、错误率和成本指标。一旦稳定,再逐步扩大覆盖范围。同时保持回退方案:在 Worker 中对未命中或错误的请求,直接 fetch 回源站以保证可用性。这样可以在不影响用户体验的前提下探索边缘架构的优势。

结论:不是"很糟糕",而是"有取舍"把 Cloudflare Workers 简单地贴上"糟糕"标签容易,但不够客观。Workers 的优势在于超低延迟的边缘执行、快速的冷启动以及丰富的边缘服务(KV、Durable Objects、R2 等),非常适合静态加速、API 网关层面的轻量改写、A/B 测试、边缘缓存和安全中间层等场景。它的缺点主要体现在路由层的表达能力较弱、资源配额和计费模型需要仔细评估、以及调试和观测工具链尚未像成熟云平台那样完备。这些缺点可以通过把路由决策下沉到代码、使用 URLPattern、建立本地模拟和监控体系来缓解。最终的判断应当基于你的业务类型、团队技能和对延迟/一致性的实际需求。如果你的应用可以受益于全球分布的低延迟入口、对短时执行友好并能接受一定程度的供应商耦合,Cloudflare Workers 是一个非常有竞争力的选择。

反之,如果你需要复杂的路由表达、长时间计算或完全避免云厂商锁定,可能需要考虑其他替代方案或混合架构。在现实工程中更可取的策略是基于小规模的试点,量化收益与成本,然后再决定是否大规模采用边缘计算平台。 。