当国家最高领导人利用社交平台发布由人工智能(AI)生成的低俗深度伪造视频时,不仅是一则丑闻那样简单,而是对民主信息生态的一次严重冲击。近日,一段35秒的AI生成视频在美国政坛掀起轩然大波,视频中对手政客被配以粗俗台词、戏谑的墨西哥式配饰以及明显的合成音。事件在网络上迅速传播,成为关于深度伪造(deepfake)、平台责任和媒体素养的集中讨论点。深度伪造技术并非新鲜事物,但当它从普通网民层级跃升到国家元首的传播工具,问题的严重性也随之放大。公众对事实的基本判断能力将被侵蚀,政治对手之间的谈判与信任也面临被刻意破坏的风险。政治深度伪造不同于普通恶搞,它具有更强的传播动力、更高的影响力和更复杂的社会后果。

首先,技术层面上,现代AI能够在视频中重建人物的面部表情、口型和语音特征,使得观众在第一眼便可能将合成内容误认成真实发言。即便细看也并非总能轻易分辨真假,尤其是当视频被快速裁剪、加入背景音乐和视觉噪声后,检测难度进一步提升。其次,传播渠道的加速放大作用不容忽视。社交平台的算法倾向于推荐情绪化、极端化内容,而政治性深度伪造往往恰好满足这些特征。若平台缺乏及时审查或标注,误导性信息便会在短时间内广泛扩散,形成事实错位。再次,法律与监管的滞后让问题难以得到快速约束。

许多国家尚未就政治性深度伪造设立明确法律界限,现有关于诽谤、选举法或隐私法的条款难以覆盖AI合成内容的独特问题。即便法律可用,跨平台、跨境传播也使执法变得复杂。更重要的是,当最顶层的政治人物选择使用或纵容深度伪造作为辩论工具时,社会规范的底线便开始动摇。政治领袖具有巨大的话语权与示范效应。他们的一言一行会被支持者模仿,当"幽默化、戏谑化、羞辱化"的AI内容被正规化为政治斗争手段,公众对政治交流的期待将从事实核验转向情绪共鸣,民主对话的质量随之下降。面对这样的威胁,我们需要在技术、平台、法律和公众教育四个层面同时发力。

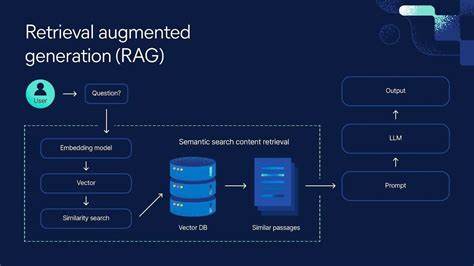

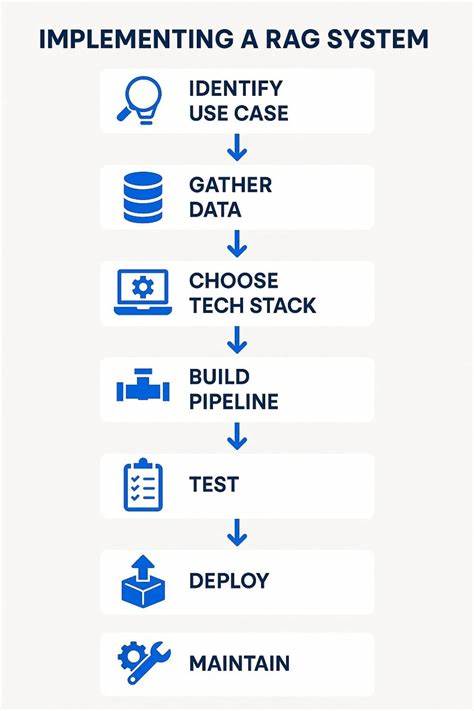

技术层面上,深度伪造检测技术应得到更多投入与标准化。现有的检测方法包括基于视觉伪影的算法、音频特征鉴别以及利用神经网络识别生成痕迹的技术。业界和学术界应建立共享的检测数据集、公开基准和评估体系,推动检测工具的开源与互操作性。与此同时,AI生成内容应尽可能实现可追溯性。数字水印与内容签名技术可用于在源头对合法生成内容打上不可篡改的标识,从而在传播链中快速识别真伪。平台责任是应对政治深度伪造的核心环节。

社交媒体平台应承担更积极的审核与标注义务,尤其是在涉及全民关注的政治内容时要有更高的透明度与审慎机制。平台可以在内容上传环节引入自动化检测,并在疑似深度伪造被识别后立即置顶警示,或限制其进一步传播。针对违反社区规范或传播恶意政治深度伪造的账户,应建立快速申诉与事实核查通道。规则的制定不能仅依赖平台自律,还需外部监督与公开报告机制来保证执行力。法律和监管框架需要与技术发展保持同步。立法者应认真考虑赋予监管机构对政治性AI生成内容的明确定义与规范,区分恶意伪造、讽刺创作与新闻再现的法律边界。

选举相关法律可以增加对故意传播误导性视频以影响选民意向之行为的惩罚力度。此外,应研究设立快速取证与跨境协作机制,以应对深度伪造的跨国传播问题。同时,要避免监管过度打击言论自由或创造性表达,法律设计应注重比例原则与程序正义。媒体与公众的媒体素养教育同样关键。面对一段看似真实却高度可能被操纵的视频,普通公众需要具备基本的辨别能力:关注信息来源、查证原始视频和音频、检索权威媒体与事实核查机构的结论、关注是否有官方声明或同一事件的多个角度报道。学校、媒体机构与非营利组织应将数字素养纳入长期教育体系,培养民众对AI生成内容的警觉性与检索能力。

此外,主流媒体在报道疑似深度伪造事件时应承担更高的信息核实责任。标题党或以"吸睛"为目的的转载只会加剧谣言的扩散。媒体可以与检测机构合作,在发布时同步提供技术鉴定结果与上下文说明,帮助受众正确理解事件性质。当政治人物自己发布或转发深度伪造内容时,平台和媒体也应更坚决地标注与限制其传播,避免权力话语成为误导传播的保护伞。事件同样暴露出社交平台经营模式与公共利益之间的矛盾。为了流量和用户粘性,平台常常优先推广能引发强烈情绪反应的内容,但这类内容恰恰是深度伪造最容易利用的通道。

将平台治理与公共政策结合,通过法规要求透明化算法推荐、内容审核报告以及对政治广告与政治内容的特别处理,可以在制度层面降低深度伪造的传播效率。技术公司也应承担更多社会责任,将AI生成工具的易用性与滥用风险对等考虑,设计出更难以被滥用的模型接口,并为关键场景提供"安全模式"或经认证的内容生成流程。道德层面的反思不可或缺。AI并非独立的道具,它反映并放大了人类的价值选择。当AI被用于羞辱、污名化或者破坏社会信任时,技术的开发者、使用者与监管者都应承担相应的伦理责任。公共话语不应被降格为低俗、侮辱或制造仇恨的战场,而是应恢复对事实与理性的尊重。

对于普通公民而言,面对类似事件需要保持冷静与怀疑。不要因为某个内容的情绪冲击而迅速下判断或转发,先寻求权威来源的核实。社交网络上的传播速度惊人,但信息的真伪辨识需要时间与方法。作为社会整体,需要在短期应对与长期建设之间找到平衡:短期内依靠平台快速反应、媒体核实与执法介入以控制危害;长期则通过法规完善、技术标准和教育提升系统性抗脆弱性。这次由高位者发布的深度伪造视频是一个警钟,提醒我们AI时代的信息治理不得再松懈。保护言论自由并不意味着容忍恶意制造混乱的手段;维护安全与秩序也不能沦为压制创新的借口。

只有通过多方协作、明确制度与技术手段的结合,才能既保留AI带来的创造性价值,又防止其成为破坏民主与公共信任的工具。未来的对策必须包括更完善的深度伪造检测体系、更严格的平台治理规则、更明确的法律边界以及更广泛的公众媒体素养教育。若任由政治深度伪造在高位者的推动下常态化,社会将逐步丧失对事实的共识,公共话语也会被极端情绪和误导性内容占据。面对AI带来的挑战,退避不是选项,积极构建抵御体系与恢复信任机制才是必须的道路。 。