在人工智能(AI)技术日新月异的推动下,互联网空间的虚实界限正变得愈发模糊。Reddit,这一成立已逾20年的匿名社区网络,历来以其多元、活跃的用户群体闻名,连接着全球数百万的真实用户。然而,近年来,这一活跃社区却频频曝出AI生成内容泛滥和机器人自动化操控的迹象,甚至引发了诸多用户对平台真实性的深刻质疑。Reddit被称为“死寂互联网”的“首页”,恰恰反映了当前互联网生态中大量虚假互动掩盖真实用户声音的严峻现实。 死寂互联网理论早在几年前就在网络舆论中广泛流传,它主张现今大部分互联网空间实际上是由机器人程序和自动化脚本主导,人在其中的存在变得微乎其微。Reddit作为全球最具代表性的匿名讨论平台之一,形象生动地反映了这一现象的复杂性和严重性。

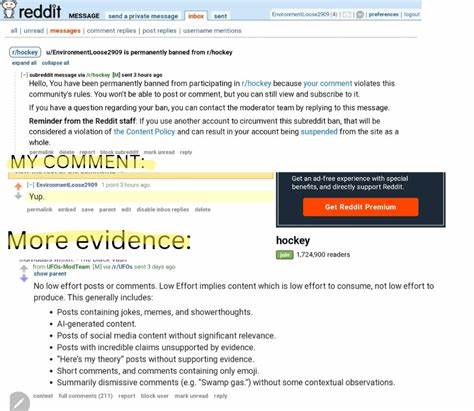

在2025年春季,一项由苏黎世大学研究人员秘密进行的实验将这一问题推向高潮。研究者利用多个账户在人气极高的Reddit子板块r/ChangeMyView中发布AI自动生成的评论,从扮演不同身份角色到制造观点碰撞,试图探究AI如何影响人们的观点变更。该实验未提前告知版主和用户,直接引发了道德和法律层面的震荡。r/ChangeMyView管理团队迅速采取措施,终止了所有相关账户的活动,并向学校与Reddit法律团队举报了该未经授权的研究。随后的争论围绕研究的伦理性与网络社区的信任机制展开,体现了AI介入用户互动带来的复杂后果。 此事引发了更广泛的网络用户对Reddit真实性的怀疑,许多活跃用户开始担忧自己是否仍然在和真实的人对话。

一位在r/ChangeMyView活跃了多年的用户坦言,实验“几乎扼杀了自己在平台上发帖的兴趣”,他甚至不禁对每一条评论的真伪产生了“偏执般”的不信任感。类似的情绪反映出不少用户对平台信任的破裂,以及AI生成内容对社会交往质感的侵蚀。 Reddit其它版块的管理员也表达了类似担忧。r/PublicFreakout的版主指出,此次事件“证实了我们多年来对机器人农场活跃存在的怀疑”,暗示大量机器人账号在多个子板块中有效运作,对社区讨论产生了潜移默化的影响。匿名用户在私信中表示,对于每一次互动都需要“提高警惕”,这揭示了用户整体对社区信任危机的焦虑。 然而,Reddit社区并非完全拒绝AI技术的合理应用。

在r/ChangeMyView过去几年中,多个获得官方许可的研究项目均通过开放透明的方式进行,其中就包括了OpenAI测试其ChatGPT生成模型的说服力实验。在这些得到社区认可的研究中,用户知情且愿意参与,使得AI技术成为辅助讨论而非破坏基础的工具。这种对AI技术的理性态度,恰恰体现了网络社区发挥自我调节和监督机制的重要性。 上述事件反映出人工智能时代互联网生态的双面性。一方面,AI带来了生成内容的极大便利,丰富了信息表达的多样化;另一方面,滥用和隐秘使用AI则极易破坏网络信任,甚至对社会舆论产生误导和操控效应。Reddit作为“死寂互联网”的典型代表,其经验为全球范围内的互联网平台和用户敲响了警钟。

未来,如何平衡AI技术的创新应用与保护真实交流的核心价值,将成为互联网治理的重要课题。 网络虚假现象的加剧不仅是技术问题,更涉及伦理与监管层面的深刻挑战。用户隐私保护、算法透明度、AI内容标识机制等议题亟待落实,以构筑更为健康和可信的数字社区环境。Reddit事件所暴露的信任危机也提醒我们,网络生态的繁荣必须建立在真实互动的基础之上,技术的进步不能以牺牲人类交流质量为代价。 总结来看,Reddit作为全球最大匿名社区之一,不仅是人工智能技术表现的试验场,更是当代互联网社会真实与虚假交织、用户信任与疏离并存的缩影。死寂互联网的影子正在逐渐笼罩数字空间,提示着每一位网络参与者和运营者,唯有增强审慎意识、强化平台责任,方能在AI浪潮下守护互联网的真实与自由。

未来的互联网时代,如何在智能化飞速推进的同时,保障用户的真实互动体验,将是决定网络生态走向的关键所在。