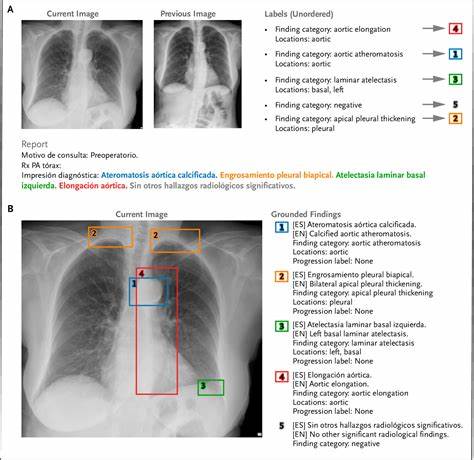

近年来,人工智能(AI)技术在医疗健康领域的渗透不断加深,涵盖疾病诊断、治疗方案推荐、药物研发以及医疗影像分析等多个方面。随着技术的快速发展,如何确保AI系统安全可靠、符合伦理及监管要求,成为行业亟需解决的核心问题。值得注意的是,医药和医疗器械行业在产品开发及监管方面拥有数十年的成熟经验,这些经验对AI系统的测试与评估提供了重要的借鉴。 医药研发和医疗器械制造领域一直致力于确保产品在使用过程中的安全性和有效性。面对高度复杂和严苛的监管环境,相关企业和机构形成了系统化的测试流程、验证标准和评估体系。这些体系以科学数据为基础,通过临床试验、实地验证和多层次风险管理来保障最终产品的质量与可靠性。

AI系统同样面临类似挑战。其算法的黑盒特性、数据依赖性强以及不断更新迭代的动态特性使得传统的软件测试方法难以完全适用。因此,借鉴医药及医疗器械行业的相关实践,有助于建立专门针对AI的测试与评估框架。 在医药产品开发过程中,临床试验是核心环节,历经多个阶段评估新药的安全性、剂量调控和疗效表现。类似地,AI系统在医疗领域的应用也需要经过严密的验证,包括算法的准确性、合理性和对不同患者群体的适用性分析。此外,医药监管机构如FDA要求系统开发者提交详细的数据支持和风险评估,以确保产品在实际应用中的风险可控。

AI系统同样应当遵循透明化的原则,提供充足的证据链,支持其功能的正确性及安全性。 另一个值得关注的方面是风险管理。医药与医疗器械行业通常采用全面的风险评估机制,识别潜在危害并制定相应的缓解策略。这一理念对于AI系统尤其重要。人工智能算法除了可能出现输出错误,还存在数据偏见、系统鲁棒性不足和隐私泄露等风险。因此,引入类似医疗行业中的风险管理框架,能够帮助AI开发者更加系统地识别和控制这些风险,确保技术的安全落地。

监管合规性是确保医疗产品进入市场的关键因素。医药和医疗器械行业受诸如FDA、EMA等多个权威机构监管,产品必须满足一系列严格的标准方能获批。人工智能应用也逐渐进入监管视野,各国纷纷出台相关规则,强调AI系统的透明度、可解释性及持续监控。对比医药领域的规范经验,AI行业应构建从设计开发、验证测试到市场监督的闭环管理机制,保障技术符合伦理、安全和法律要求。 数据质量和来源的可靠性是影响测试效果和产品性能的重要因素。在医药研发中,高质量、经过严格筛选的临床数据是保证试验有效性的基础。

同样,AI系统训练与测试所依赖的数据集必须具备代表性且无明显偏差,否则可能导致算法判断失误甚至危害患者安全。因此,建立健全的数据管理制度,确保数据的准确性和多样性,是提升AI系统测试评估质量的关键步骤。 可解释性作为医药产品上市的重要考量,也为AI系统的测试评价提供借鉴。在医疗实践中,医生需要理解药物作用机理和副作用,方能做出合理诊疗决策。人工智能尤其是深度学习模型通常缺乏透明度,难以解释内部运作逻辑。借鉴医疗产品说明书及风险告知的做法,AI系统在设计之初就应纳入可解释性考量,配合相应的测试方法来保证系统的结果可信且便于理解。

持续监测和后市场评估同样是不容忽视的环节。药品上市后需要通过药品警戒系统监控不良反应,及时采取应对措施。医疗器械也需执行定期回顾和性能检测。人工智能产品一旦投入临床应用,同样需要基于真实环境数据开展持续的性能监控和风险评估,确保系统能够在多变的应用场景下稳定、安全运行。 技术与监管的融合是未来AI医疗发展的大势所趋。药品和医疗器械行业的监管模式强调科学证据、风险控制与透明合规,为AI技术注入了强有力的质量保证思维。

行业应加强跨领域合作,结合人工智能的独特挑战,创新测试方法和评估标准,推动技术规范与政策同步进步。 综上所述,医药和医疗器械行业在测试与评估方面积累了宝贵的经验,这些经验为AI系统尤其是医疗AI的研发和应用提供了重要启示。强调科学验证、风险管理和合规性,注重数据质量与结果解释,以及建立持续监控机制,将有效提升人工智能技术在健康医疗领域的安全性和信赖度。未来,在借鉴传统医疗领域成熟流程的基础上,结合AI独特属性展开创新,将为医疗健康产业带来更大革新和价值。