近年来,人工智能(AI)技术的进步极大地改变了人们的沟通方式。作为全球领先的社交媒体巨头之一,Meta(前身为Facebook)不断探索创新手段,力求让用户在其平台上拥有更丰富、更紧密的互动体验。最新的一项举措是推出能够主动向用户发送消息的聊天机器人,这种机器人不仅响应用户请求,还能自行开始对话,重新定义了人机交互模式。首先,让我们了解这一技术的具体表现。Meta的聊天机器人基于其AI Studio平台,用户可以创建具备个性化特征和特定话题偏好的AI人格。例如,一个以电影为主题的聊天机器人可能会主动给用户发消息,推荐经典电影配乐或询问最近观影体验。

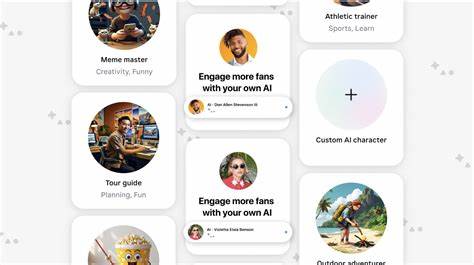

这种主动触发的交流方式不同于传统聊天机器人被动等待用户输入的方式,更加贴近人与人之间的互动习惯,增强了交流的自然感和连贯性。Meta透露,这些聊天机器人只会在用户在过去14天内主动与机器人交换至少五条信息后,才能发送首次主动消息。如果首次主动消息没有获得回复,机器人也不会重复发送信息。此设计体现出Meta对用户体验的关注,努力避免打扰造成的反感,同时也确保机器人的互动是在用户愿意的前提下进行。除了个性化服务,Meta还支持用户将自己创建的聊天机器人通过故事动态、直接链接,以及展示在Facebook或Instagram的个人主页上分享给更广泛的社交圈。这种社交分享不仅能促进不同用户之间的交流,也让AI助手作为一种新的社交元素融入到日常使用中,丰富了社交媒体的交互维度。

然而,聊天机器人主动发起对话也引发了关于隐私和安全的诸多讨论。Meta与数据标注公司Alignerr合作训练这些可定制的机器人,使其能够记住用户的偏好和过往对话内容,提升对话的智能和个性化水平。虽然提高了用户体验的精细度,但同时也对用户数据保护提出更高要求。针对安全问题,Meta在公开说明中强调,AI聊天机器人的回复可能存在不准确或不合适的情况,且不能作为医疗、心理、金融或法律等专业建议的替代品。这种免责声明显示出Meta在推广AI应用时采取了谨慎态度,防止用户过分依赖虚拟助手作出重大决策。值得注意的是,市场上类似的AI伴侣企业例如Character.AI和Replika也支持机器人主动发起对话,但该领域也经历了法律和伦理上的挑战。

Character.AI近期卷入一起因AI聊天导致未成年人悲剧的诉讼案件,凸显了AI交互技术潜在的风险。Meta对此表示高度重视,并通过一系列安全规范及用户指导保持对使用风险的警醒。从商业角度看,Meta借由这一技术的推广,预期将在未来几年实现数十亿美金的收入。公司内部文件透露,生成式AI产品在2025年可能带来20亿至30亿美元的收益,2035年甚至预计提升至1.4万亿美元。这一庞大的数字离不开Meta与托管其开源Llama模型的第三方企业的收入分成。未来,Meta的AI助手或将加入广告展示及订阅功能,进一步拓展变现渠道。

虽然目前官方尚未明确表态有关广告的具体实施方案,业内普遍看好AI聊天机器人对用户粘性提升及商业模式创新的推动作用。随着社会普遍关注“孤独感疫情”,Meta将AI聊天机器人定位为缓解用户孤独感的良方,助力打造温暖且持续的社区环境。然而,公司仍需平衡用户福祉与商业利益,确保技术应用不会陷入诱导性算法促进短时高频互动,损害用户长期体验的困境。此外,年龄限制仍是使用AI聊天机器人的一个敏感议题。尽管Meta目前未对AI助手的使用设置明确年龄门槛,部分地区法律如美国田纳西和波多黎各则对未成年人使用此类技术有严格限制。在这背景下,如何制定安全且合规的用户准入策略,防止青少年在无监督状态下接触不当内容,是Meta必须面对的重要任务。

综合来看,Meta主动消息聊天机器人成为人工智能技术应用的又一里程碑,它将带来更加积极主动和个性化的用户互动体验,丰富社交平台的生态体系。与此同时,隐私保护、内容安全、法律合规以及商业化策略的制定,都是这一技术成熟与普及过程中不可或缺的课题。未来,随着技术的持续完善以及监管框架的建立,Meta的AI聊天机器人有望成为全球社交生态中的新型互动媒介,助力用户更好地连接彼此,也推动数字生活进入全新阶段。