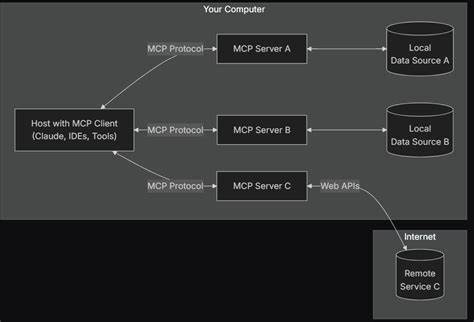

随着人工智能技术的不断进步,AI系统与外部数据源和工具的实时交互逐渐成为推动业务创新和智能化转型的重要手段。Anthropic推出的Model Context Protocol(MCP)作为一种标准化协议,旨在实现AI系统的高效集成和协同工作。然而,MCP虽然为企业带来了诸多便利和技术优势,却也引入了前所未有的安全挑战,这些挑战亟需通过企业级安全框架和技术策略加以应对。MCP的设计核心是允许人工智能模型在执行过程中访问外部工具和数据,从而实现动态上下文的注入和实时信息的获取。这种能力增强了AI的灵活性和智能水平,但同时也为攻击者创造了潜在的入口。例如,攻击者可能通过工具中毒(tool poisoning)等复杂攻击手段,注入恶意代码或伪造数据,破坏模型判断,进而导致数据泄露、系统失控甚至业务瘫痪。

面对这些威胁,建立一套全面、系统的安全框架尤为关键。首先,企业需要从架构层面对MCP的访问控制和身份验证机制进行强化。确保所有连接的工具和数据源均经过严格的权限审查与身份验证,防止未经授权的访问成为攻击通道。多因素认证和最小权限原则在此发挥重要作用。其次,行为监控与异常检测技术也是防护的重中之重。通过持续监控模型与外部工具的交互行为,结合机器学习等先进手段,及时发现异常通信模式和潜在安全事件,从而实现前瞻性的威胁预警和快速响应。

数据完整性验证机制则是保证MCP传输数据可信性的关键环节。采用加密签名、数字指纹等技术对外部数据进行完整性验证,防止数据在传输过程中被篡改或者伪造。针对工具中毒这类高复杂度威胁,提升工具链的安全性和透明度尤为必要。企业需定期对集成的外部工具进行安全审计,采用沙箱机制隔离工具运行环境,避免恶意代码影响核心模型运行。同时,建立事件响应与恢复机制也是保障系统稳定性的保障。包括详细的安全事件日志记录、自动化的安全事件分析工具,以及预设的应急方案,一旦发生安全事件可以迅速定位问题根源,降低业务中断风险。

在具体实施层面,企业可借鉴一些切实可行的安全模式,如零信任架构在MCP中的应用,强调不默认信任任何一方,通过服务器身份验证、端到端加密以及细粒度访问控制,实现全面的安全防护。与此同时,完善的安全治理体系也必不可少。定期开展安全风险评估与渗透测试,结合行业安全合规要求,建立符合企业实际需求的安全策略,不断优化和调整安全措施,确保MCP生态中的安全保障与业务发展同步推进。值得关注的是,随着人工智能和数据安全领域的研究不断深化,MCP的安全框架也在不断演进。学术界和工业界积极开展威胁建模和安全实践探索,例如利用形式化验证方法确保协议实现的安全性,推动AI模型解释性与可控性的提升,为未来构建更为坚实的安全基础打下基础。企业在推进MCP安全建设过程中,应保持对新兴威胁的敏感度,关注最新的研究成果和工业实践,结合自身业务场景,灵活应用并不断完善安全措施,形成动态防御能力。

总体来看,Model Context Protocol作为连接AI模型与外部环境的关键桥梁,其安全性直接关系到AI系统的整体可靠性和企业信息资产的安全。只有通过严密的安全设计、先进的技术手段与科学的管理体系相结合,才有可能实现对潜在安全风险的有效管控,为企业人工智能应用护航。未来,随着MCP的广泛应用和生态系统的不断扩大,安全问题将成为制约其进一步发展的核心议题之一。企业、研究机构和标准制定组织需要通力合作,推动MCP安全标准的完善和广泛采纳,共同构建一个安全、可信、可持续发展的智能互联世界。