随着人工智能技术的不断发展,基于大型语言模型(LLM)的应用逐渐普及,涵盖了自然语言处理、图像生成和音频交互等多个领域。然而,许多现有的AI接口和平台存在依赖云服务、数据隐私难以保障和部署复杂等问题。为此,开源界涌现出一些轻量级、高效且支持多模态交互的解决方案,Llms.py就是其中备受瞩目的一款。Llms.py是一款集成了聊天、图像与音频客户端及服务器功能的轻量级开放AI平台,允许用户完全离线运行并实现数据的本地化存储,从而极大地提升了隐私安全性和应用灵活性。Llms.py不仅提供简洁高效的命令行界面(CLI),还支持API调用和网页客户端,成为开发者构建定制智能交互系统的得力工具。Llms.py的设计理念聚焦于轻量化和数据私密保护。

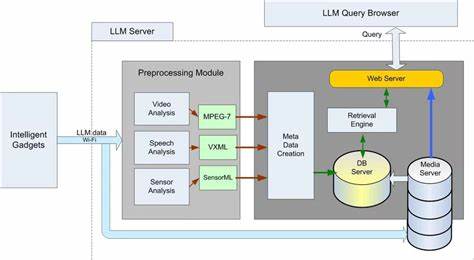

与依赖大量云计算资源的大型平台相比,Llms.py允许用户通过本地部署调用多种语言模型,显著节约计算资源和网络带宽。同时,所有数据均储存在用户本地浏览器存储或服务器端,杜绝了数据被第三方窃取或滥用的风险。对重视隐私保护的企业与开发者而言,这是一个极具吸引力的优势。平台支持多种主流的自然语言处理模型,涵盖文本生成、对话管理和智能问答,同时内置对图像和音频数据的支持能力。用户可以通过内置的接口实现基于文本的智能问答,或者结合图像生成模型进行创意内容制作,乃至使用音频处理模块执行语音识别和合成任务。多模态支持极大丰富了AI应用的场景和表现形式。

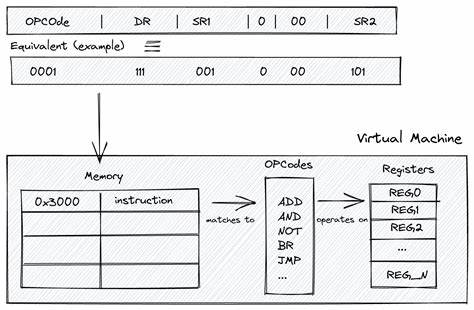

在技术实现上,Llms.py采用模块化设计,代码主要以JavaScript和Python编写,兼具灵活性与跨平台特性。系统包括命令行工具、HTTP API服务器和网页前端三大核心组件,相互协作以满足不同用户和场景的需求。无论是本地开发环境还是生产服务器,Llms.py均能稳定运行并高效响应。开源社区的持续贡献也让Llms.py具备了完善的文档、多样的示例和丰富的扩展模块,极大降低了使用门槛,便于快速上手和集成。作为轻量级的API服务,Llms.py还内置了安全认证与访问控制机制,支持通过Docker容器进行快速部署和管理。简洁的配置文件和脚本自动化流程使得初学者也能毫无障碍地体验和定制专属AI服务。

与此同时,平台的性能优化保证了响应时间和模型调用的效率,适合承载小型到中型企业应用的并发负载。Llms.py应用场景广泛。对于个人用户来说,利用它可以快速搭建具备聊天机器人、图片生成以及语音交互的智能助手,提升日常效率和娱乐体验。中小型企业亦能借助平台构建符合自身业务需求的智能客服、内容创作和自动化办公解决方案,无需依赖云厂商,节省成本且加强数据管控。在教育行业,Llms.py可支持教学场景中的自然语言理解与生成,助力打造个性化学习助手。总体来看,Llms.py为人工智能应用提供了一个安全、轻便、功能丰富的选择。

它保障用户数据隐私,摆脱云端依赖,实现了多模态智能交互的无缝融合。借助清晰的代码结构和活跃的开源社区支撑,无论是技术爱好者还是专业开发者,都能借此搭建符合自身需求的高性能智能应用平台。未来,随着模型本地推理技术的持续进步和生态的不断完善,Llms.py有望进一步拓展支持更多元的AI模型与服务,满足用户日益增长的智能化需求。作为新一代轻量级开放AI客户端与服务器软件,Llms.py的成长轨迹及其对行业的影响值得持续关注。 。