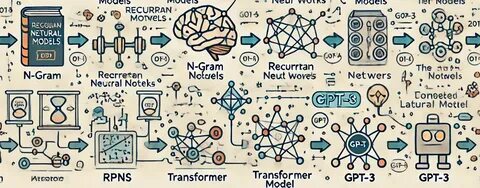

大型语言模型早已从学术概念走入日常生活,聊天助手、写作辅助、代码生成和搜索增强都在依赖同一类技术。纵观它们的演进,既有基础理论的积累,也有工程尺度化的突破。理解这段历史,有助于把握为什么当下模型能够表现出惊人的语言能力,也能更好地判断未来的发展方向。 早期自然语言处理以规则和人工特征为主,统计方法和马尔可夫链的 n-gram 模型曾长期占据主流。n-gram 通过限制上下文长度来缓解数据稀疏,但代价是语境能力受限。真正改变格局的一个核心思想是分布式表示,也就是把离散的词用连续向量表示。

上世纪八九十年代的连接主义研究奠定了分布式表示的理论基础。进入新世纪,2003 年的神经概率语言模型把词向量与神经网络联合训练的思路带入主流,指出若相近语义或句法角色的词在向量空间中也接近,那么模型就能以较少数据推广到未见组合。 词向量的规模化应用在 2013 年迎来爆发。word2vec 等方法通过更简洁且高效的目标函数快速训练出高质量词嵌入,进而揭示出诸多出人意料的线性语义规律。类似 king - man + woman ≈ queen 这类向量算术关系,让研究者意识到大量语料和简单目标有时能挖掘出深刻的语言结构。同一时期的 GloVe 等方法补充了全局共现统计与局部上下文的视角,形成了多条可行路径来学习词表示。

词向量解决了离散性与稀疏性问题,但上下文长度的限制依然明显。为了解决变长文本的表示问题,序列到序列的编码器-解码器架构被提出并迅速成为机器翻译等任务的主力。基于循环神经网络 RNN 与长短期记忆 LSTM 的 encoder-decoder 可以处理任意长度的输入与输出,但当输入变得很长时,单一的固定长度语境向量会成为瓶颈。 注意力机制的引入正是为了解决这一瓶颈。2014 年在神经机器翻译中提出的可微注意力,让解码端在生成每个词时,都能动态地检索并加权编码端的不同位置信息。注意力的核心观点是把解码器的当前状态视为查询,编码器的各个隐藏状态视为键和值,计算相似度权重后得到加权和作为上下文返回。

注意力既能实现软对齐,也能显式保留序列中不同位置的重要性,使模型应对长距离依赖时表现显著改善。 在对注意力的进一步研究中,学者们区分了不同类型的注意力:交叉注意力是编码器和解码器之间的信息检索,自注意力则让序列内部的位置相互检索,从而发掘序列内部的全局关系。并行化的需求推动了对更高效注意力实现的探索,点积注意力在计算和工程上展现出优势。 2017 年发表的变换器 transformer 架构将注意力推向了极致,抛弃了全部的循环和卷积结构,用纯注意力构建编码器和解码器。变换器引入位置编码以弥补注意力本身缺乏顺序感的不足,同时采用多头注意力来并行学习多种语义或句法关系。变换器的并行化特性极大提升了训练效率和可扩展性,使研究者能够在更大规模语料和更大参数量上实验,从而带来了性能与效率的双重飞跃。

架构之外,训练范式的进化同样关键。生成式预训练的理念是先在海量无标注文本上以自回归或掩码语言模型目标预训练,得到通用的语言表示,再在下游任务上进行微调或以少量示例进行提示学习。OpenAI 的 GPT 系列通过自回归预训练和适度的微调在零样本和少样本学习上表现出色。与之互补的 BERT 则采用掩码语言模型实现双向表示,促进了序列分类等多种任务的迁移学习能力。 仅靠预训练并不能满足对安全性、价值观与交互可控性的需求。为此,人类反馈与强化学习的结合成为重要手段。

通过收集人工对生成结果的偏好排序,训练奖励模型,再用强化学习优化策略以最大化该奖励,能够在很大程度上调整模型的输出倾向,使其更加符合可接受的行为规范。这种 RLHF 技术已成为商业化对话模型普遍采用的对齐方案,但它并不能从根本上解决所有道德和社会问题,仍需多管齐下的治理与技术改进。 另一条重要发现是尺度效应。自 AlexNet 在计算机视觉领域引发的复兴开始,研究者们逐渐认识到简单可扩展的方法在大量算力和数据下常常优于复杂的手工设计。语言模型的尺度法则显示,随着参数数量、训练数据和计算量的增加,模型在多个任务上的表现会以稳定可预测的方式提升,且在某些规模门槛之上会出现"突现"能力,例如更好的推理或链式思维表现。尽管关于为什么尺度带来这些新能力尚无统一解释,但工程上的确定性促使业界不断投入资源扩展模型规模和训练数据量。

从应用角度看,大型语言模型的用途迅速扩展到内容生成、知识问答、辅助编码、法律与医学文本处理等多个领域。与此同时,人们也越来越关注模型偏见、错误信息生成、隐私和滥用风险。学术界与产业界正在探索更严格的评估基准、更透明的模型发布策略以及更完善的对齐与监督机制。 展望未来,研究焦点可能会集中在几条主线。一是模型效率和绿色 AI,如何在减少能耗的同时保持或提升能力,包括稀疏化、蒸馏与更高效的训练算法。二是多模态能力与通用智能的融合,语言与视觉、听觉、动作控制等的联接将推动更丰富的交互系统。

三是可解释性与可控性,用户需求驱动下会有更多工具帮助理解模型决策路径并约束其行为。最后,治理、伦理与法规的完善将与技术发展并行,社会对模型透明度和责任的要求只会提高。 回顾历史我们可以看到,從分布式表示的萌芽到现代变换器基础架構,很多关键突破既源于理论洞见,也源于工程规模化的实现。大型语言模型的能力并非魔法,而是大量简单原理和海量数据在计算资源上叠加的结果。理解这段历程,可以帮助我们既欣赏其成就,也理性面对风险,推动技术向更安全、更有益的方向发展。 。