为什么需要在软件层面模拟 Spark 在大规模数据处理场景中,部署和调整 Apache Spark 集群往往代价高昂且耗时。真实生产环境中出现的节点失效、数据倾斜、网络抖动和 I/O 瓶颈,单靠少量实验很难全面评估其对作业时延和资源利用的影响。模拟器通过可控、低成本且高度可重复的方式,让团队在早期阶段就能够评估架构决策、容量规划和容错策略。FauxSpark 正是在这样的背景下诞生,目标是以简单但可解释的模型重现 Spark 运行时行为,帮助工程师做出更有数据支撑的决策。 FauxSpark 的核心是什么 FauxSpark 是基于 Python 的离散事件模拟器,使用 SimPy 实现时间推进与事件调度。它把 Spark 的运行时抽象为 DAG 级别的 stage、任务(task)和 executor。

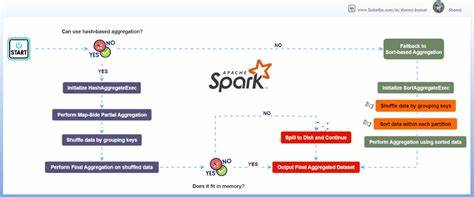

模拟关注点并不在于精确还原 JVM、Shuffle 协议或网络栈的所有细节,而是聚焦调度、资源分配、任务重试和故障恢复这些直接影响作业完成时间和资源利用率的核心因素。这样一种精简但聚焦的建模方式带来两个显著好处:一是能够快速运行大量仿真来获得统计置信区间;二是模型结构清晰,便于扩展和实验不同的策略。 FauxSpark 能解决的典型问题 FauxSpark 能帮助回答若干与 Spark 运行密切相关的问题,例如在不同集群规模下作业的延时分布如何变化;在遭遇数据倾斜或突发节点故障时,任务重试和自动替换策略对整体 SLA 的影响;以及在给定预算约束下如何选择 executor 和 core 的配置以最大化资源利用率。通过将输入数据量、分区分布、执行速率与故障事件参数化,工程师可以在安全的环境中进行大量蒙特卡洛仿真,从统计意义上评估最坏情形和尾部风险。 设计思想与实现要点 FauxSpark 的模型把 DAG 分解为一组阶段和任务。每个任务有输入大小、计算速度假设和失败概率。

Executor 则被建模为具有固定核心数和启动时间的资源池。调度器在模拟中负责将任务分配到空闲核心并触发任务执行。失败场景包括 executor 崩溃和 shuffle fetch 失败,系统支持自动替换 executor 并配置替换延迟。随机性来源于数据分区的大小分布和可能的失败时刻,使用随机采样来生成多次试验以估计百分位指标。 如何解读模拟输出 模拟通常会输出作业运行时间和资源利用率两类关键指标。资源利用率在 FauxSpark 中定义为所有任务运行时间之和除以 executor 总在线时间乘以核心数量的归一化结果。

利用率低可能意味着资源严重空闲或任务分配不均。运行时间的尾部分布(例如 p90、p95)尤为重要,因为少数慢任务或单点故障往往主导最终作业完成时间。通过在不同参数下收集大量仿真样本,能够看到决策在统计意义上的效果,而非单次实验的偶然结果。 数据倾斜与蒙特卡洛实验的重要性 数据分布对并行度利用率影响极大。均匀分布下,增加核心数通常能线性缩短运行时间,但数据倾斜会导致某些任务长时间占用核心,拖慢整体进度。FauxSpark 支持 Pareto 等非均匀分布模拟,使得工程师可以观察在预期倾斜强度下最优资源配置的变化。

由于随机性,单次模拟结果不能代表整体行为,需要运行成千上万次试验并统计百分位指标。通过这样的蒙特卡洛方法可以在概率意义上给出配置建议,并识别那些对尾延迟敏感的场景。 故障模拟与容错策略评估 在分布式系统中节点故障不可避免。FauxSpark 可以模拟 executor 在给定时间点的故障,并评估是否启用自动替换、替换延迟对作业完成时间的影响。自动替换可以提高可用核心数并减少等待时间,但替换操作本身会带来延迟和启动成本。通过仿真可以权衡替换策略与任务重试次数、重试延迟之间的关系,进而为生产环境制定更合理的容错参数。

扩容策略和成本权衡 FauxSpark 支持简单的自动扩容事件模拟,使得研究调度与成本之间的折衷成为可能。扩容能缓解临时高负载或数据倾斜带来的性能下降,但会增加成本和潜在的调度复杂度。在模拟中,工程师可以设定扩容触发时间点和新增 executor 的属性,从而研究在不同 SLA 要求下哪种扩容策略最合适。结合成本模型,可以在满足性能目标的同时尽可能降低资源浪费。 优化器与决策支持 FauxSpark 提供了基于大量仿真的优化器示例,用来在给定目标下筛选最优配置。常见目标包括最大化利用率、控制 p90 运行时间在某一阈值以下或在成本预算内最小化尾延迟。

优化器通过遍历不同的 core 数量和 executor 大小,运行大量仿真并计算目标指标的百分位数,最终将满足约束的配置标为推荐。尽管这种穷举加蒙特卡洛的方法计算代价不菲,但它在工程决策早期提供了高置信度的定量依据。 实际使用建议 在将模拟结果用于生产决策之前,先对模型做几项校准工作。第一,尽可能用历史作业的统计数据校正任务执行速率和数据分区分布。第二,合理设定失败概率和恢复延迟,这些参数对尾延迟影响显著。第三,采用分层试验策略,从粗粒度参数扫面逐步收窄到细粒度仿真,以节省计算资源并针对关键参数进行深入分析。

最后,要把模拟作为决策辅助工具而不是唯一依据,模拟结果需要与小规模真实负载测试以及线上 A/B 实验结合验证。 局限性与可扩展方向 任何模拟都依赖于模型假设,FauxSpark 也不例外。当前实现忽略了许多真实世界的细节,例如网络带宽限制、磁盘溢写导致的 I/O 阻塞、Shuffle 的真实协议开销以及多作业竞争带来的资源争用影响。因此在强耦合或跨网络通信成为瓶颈的场景下,模拟结果可能会偏乐观。未来改进方向包括将网络和磁盘 I/O 建模为独立资源、支持缓存和重用机制、引入多作业调度策略以模拟公平共享场景以及实现推测执行等调度优化策略。 如何将 FauxSpark 融入工程工作流 将模拟流程嵌入 CI/CD 或容量规划流程,可以在每次数据规模或作业变更时自动评估配置风险。

团队可以设定常规的模拟跑批任务,用于监控在预期数据增长或模型变更下的性能趋势。对于数据平台团队,模拟器还能作为沟通工具,向业务方解释为什么在高倾斜或高峰期需要额外资源,以及不同优化策略的成本与收益。 总结与展望 FauxSpark 以简洁的离散事件模型为核心,提供了一种低成本且可重复的方法来研究 Spark 的调度、倾斜和容错行为。虽然模型并非面面俱到,但其可扩展性和易用性使其成为工程团队在容量规划和故障演练时的有力补充。未来随着对网络、I/O、缓存以及多作业交互的进一步建模,模拟器将能够提供更接近真实生产环境的洞见。对于任何希望用数据而非直觉来指导 Spark 集群设计与优化的团队,FauxSpark 是值得尝试的工具。

。