在现代数字社交平台迅速发展的背景下,'这些人不真实'这一话题逐渐引发了广泛关注。所谓'这些人不真实',指的是网络空间中那些并不存在或虚构的身份、人物,甚至涉及更深层次的假象和伪装。虚假人物现象不仅在社交媒体、论坛中普遍存在,也在新闻传播、舆论导向以及虚假信息扩散环节中扮演着重要角色。理解这种现象的根源、表现形式及其影响,有助于我们更清晰地认识数字时代身份与信任的复杂关系。虚假人物的产生原因多种多样,其中包括个人出于隐私保护、恶意行为或娱乐需求而创造虚拟身份。此外,组织、团体甚至国家出于操纵舆论、信息战等目的,亦可能制造虚假人物以影响公众观点或制造混乱。

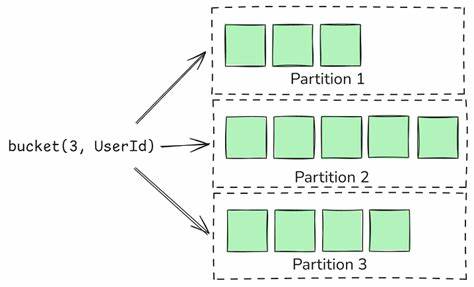

数字平台的匿名性和技术门槛降低为虚假身份的生成和散播提供了便利,推动了这一现象的迅猛发展。网络虚假人物通常表现为虚构头像、伪造个人信息,以及虚构经历和言论等形式。部分虚假人物会持续在网络中活跃,建立稳定的虚拟社交关系,甚至影响真实用户的看法和行为。这些人物有时被称为"僵尸账号"或"机器人账号",通过自动化程序实现大量信息的传播和评论互动,增加其真实性的假象。同时,普通用户很难凭肉眼识别真假,导致虚假信息误导和信任危机加剧。值得注意的是,虚假人物现象并非全然负面,有时候虚拟身份的创建是隐私保护和社会实验的表现。

例如,一些用户利用匿名或虚拟身份表达真实想法,避免现实世界的歧视或骚扰。此外,文学、艺术及数字创作领域也经常采用虚构人物作为表达工具,推动文化多样性和创新。然而,虚假人物带来的负面效应同样显著。在政治领域,虚假账号可能操作舆论风向,扩散错误信息,干扰选举公正和社会稳定。商业领域中,虚假身份被用于制造虚假评论、操纵市场行情,损害消费者权益。法律和伦理上,虚假人物的泛滥带来了监管和责任认定的难题,缺乏有效机制使治理难度增大。

在应对虚假人物现象方面,技术手段和社会治理需协同推进。人工智能和大数据分析技术被用来检测异常账号行为,辨别身份真伪。同时,增强用户的数字素养,提高识假、防范虚假信息能力至关重要。政府、企业与用户间的合作可以实现更有效的监督和管理,保障网络空间的健康生态。文化层面上,公众应树立对信息真实性的批判性思维,避免被虚假人物误导,而媒体平台则需承担责任,建立透明度高、规范严的身份验证体系。未来,随着人工智能技术的进一步发展,虚假人物现象可能愈发复杂。

深度伪造(deepfake)技术的兴起,使得虚假形象和声音更难以辨别真伪。这一趋势既给数字安全带来挑战,也提出了伦理、法律的新课题。对虚假人物现象保持警觉和主动应对,已成为数字社会发展的必然需求。综上所述,'这些人不真实'并非简单的网络恶搞现象,而是关系到数字身份、信息安全以及社会信任的复杂问题。正确认识虚假人物的成因与作用,采取科学合理的技术和管理措施,对于维护网络空间的真实性与安全具有重要意义。在数字时代,每个人都需成为信息的明辨者,共同构筑一个真实、透明、可信赖的网络环境。

。