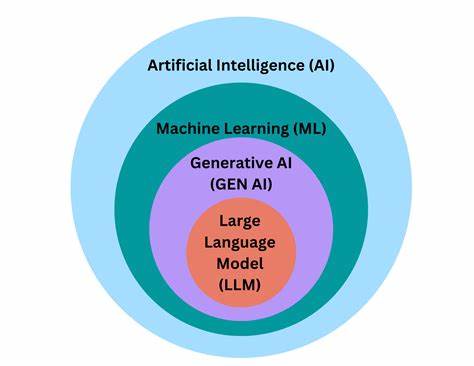

当今人工智能技术日新月异,尤其是大型语言模型(LLM),已成为大众谈论的焦点。然而,对于很多远离科技前沿的人群,尤其是年长的长辈而言,人工智能往往显得神秘且难以理解。如何以简单易懂的方式向奶奶或类似的长辈解释这项复杂技术,是许多年轻人面对的挑战。一个行之有效的类比便是把大型语言模型比作演员。这个比喻不仅形象生动,更易于唤起共鸣,帮助非专业人士理解人工智能的本质和局限性。演员的核心职责是扮演某个角色,目的是提供一个让观众信服的表演。

他们会深入研究角色的背景、性格、时代特征,有时还会夸张或创造细节,以使表演更加精彩和引人入胜。一个角色不需要完全符合现实,只要能够在观众的期待范围内显得真实可信即可。演员们在表演中可能会对现实进行一定程度的扭曲,这种扭曲往往是为了增强观众的体验和情感联结。同理,大型语言模型生成的文字输出非常类似演员的台词。它们致力于模仿人类语言的表达模式,重视语言的自然流畅和符合预期,而非追求内容的绝对正确或一致性。语言模型的"知识"并非真正意义上的事实记忆,它们并不像百科全书那样储存信息,而是通过大量的文本学习,形成一种概率上的"直觉",判断什么样的语言顺序最可能出现。

这样,当模型输出某个准确事实时,往往是因为这一内容曾在训练数据中频繁出现,形成了高概率的表达。反过来,如果模型输出错误信息,也并非故意欺骗,而是它根据语言模式所作出的"演绎",这也正是大型语言模型的"演员式欺骗"有时令人难以察觉的原因。为了让模型表现得更好,给它赋予一个具体的"角色"或"身份"非常关键。就像演员需要明确扮演哪种角色,模型也可以被设计成扮演某种特定身份或风格。比如,如果你希望模型编写优质的Python代码,直接让它"写代码"可能得到参差不齐的结果,因为它曾学习过各种风格和水平的代码。但如果告诉模型它是一位拥有20年经验的资深软件工程师,它就会从这套"角色设定"出发,更专注于生成简洁、正确、符合专业标准的代码。

这种方法能显著提升输出的准确性和实用性。把语言模型当作"演员"的比喻,提供了很强的预测力和解释力。它解释了为什么模型有时会"幻想"出事实,类似演员在表演中过度发挥情节或赋予角色新的细节以更好地打动观众。它还能帮助人们理解为何这类模型在某些任务上表现出色,而在另一些任务上却容易失误。除此之外,这一比喻的亲切性和熟悉感,有助于公众在面对复杂科技时少些困惑和抵触。进一步讨论,作为"演员"的语言模型是为谁而演呢?模型的真实"观众"并非普通用户,而是模型的开发者、科研人员和维护人员。

虽然用户通过提示词(prompt)指导模型表演,但模型的性质、技能与行为更多受制于其创造者的设计和训练。在某种意义上,用户更像是导演,借助提示引导模型扮演不同角色;而研发者则是决定整体"戏剧走向"的制片人和主创,负责编写和修订剧本,确保演出持续受到认可。随着技术不断进步,不合格的模型版本会被更新替代,最终决定模型命运的正是研发团队和市场反馈。此外,语言模型的表现不可避免地反映出其开发者的偏见和意图,这些因素在模型训练和参数调整过程中潜移默化地融入了系统。其结果是,技术并非完全中立,公众需要意识到模型输出中可能隐藏的价值观和倾向。这也提醒我们,在使用语言模型时要保持批判思维,不盲目相信其"表演"的每一句话。

科技从来都是双刃剑,语言模型虽为我们带来便利,也伴随着被误用或过度炒作的风险。一些企业和机构基于市场焦虑或商业利益,可能夸大模型能力,甚至让社会在了解不足的情况下草率采用技术,带来潜在负面影响。因此,清晰准确地向公众传播人工智能知识尤为重要。借助"演员"比喻,帮助大家合理设置期望,辨别模型的适用场景和局限,让更多人安心理智地使用语言模型技术。总而言之,把大型语言模型看作演员,是一种既形象又实用的解释方式。它揭示了模型通过模拟语言模式进行"表演",追求的是表现的真实感而非绝对真理。

通过赋予模型"角色"来指导输出方式,能极大提升生成内容的质量和相关性。这一视角有助于减轻人工智能的神秘感,令更多普通人,尤其是我们的长辈,能够理解和接受这项影响深远的技术。未来,随着AI继续融入日常生活,沟通和教育对于消除误解、理性拥抱技术的重要性将更加凸显。学会用人人熟悉的语言和比喻,或许正是我们在信息时代拥抱明天的钥匙。 。