近年来,人工智能(AI)技术在科研领域的应用日益广泛,极大地提高了数据处理和论文撰写的效率。然而,这种变革性的技术也带来了诸多潜在问题,尤其是在企业利益通过AI推动的"伪科学"(resmearch)不断涌现的情况下,科研的公正性和可信度正受到严峻挑战。公众和学术界越来越担忧,人工智能可能成为企业推广自身产品和服务的一种工具,而非单纯追求科学真理的手段。历史上,企业通过资助特定研究以塑造有利于自身产品的科学证据并非新鲜事。例如,2000年代初,美国制药巨头Wyeth因其激素替代疗法导致多名女性乳腺癌而被起诉。调查显示,Wyeth通过医疗传播公司撰写多篇"幽灵文章",这些文章由领域内知名医生署名发表,表面看似权威,却实则带有明显的商业利益倾向。

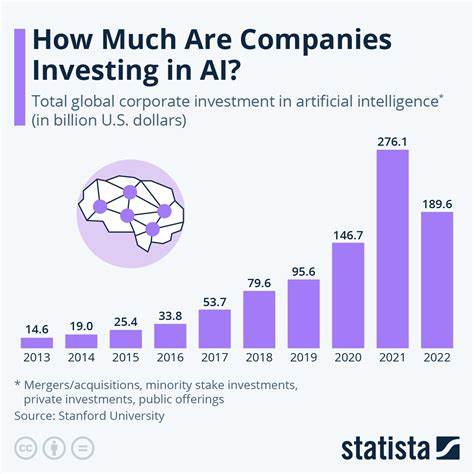

这种行为严重扭曲了医学研究的本意,最终Wyeth支付了超过十亿美元的赔偿金。类似的例子在饮料和肉类产业中也屡见不鲜,这些企业往往资助研究以淡化其产品与健康风险之间的关联。人工智能的出现,让这种现象雪上加霜。以往科研人员撰写一篇论文需要数月时间,而现在,借助AI工具,单个研究者在几小时内即可生成多篇体裁完备的科学论文。更令人担忧的是,科研成果的质量参差不齐,许多AI生成的文章趋向于依靠单因素分析,试图简单地将一个因素与某种健康结果直接关联。这种研究方法极易产生误导性结论,因为在大量数据中,偶然出现的统计相关性不足以证明因果关系。

根据学术数据库Scopus和Pubmed的统计,自2014年至2021年,平均每年发布的单因素研究文章约为四篇,但2024年前十个月,这一数字激增至近两百篇。这不仅推动了量的爆炸,也无形中为企业通过AI快速产出"科学证据"提供了温床。尤其是在英国等国家,政府新指引要求婴儿食品企业仅能在有科学证据支持的情况下宣传健康功效,这使得企业更加渴求利用人工智能快速生产符合要求的研究,在营销策略中获得合法性和竞争优势。然而,遏制这种现象并非易事。科研成果如果未经过严格同行评审就被政策制定者或法律机构采纳,可能导致利益相关方利用未经验证的研究维护自身利益。2021年,美国最高法院大法官Samuel Alito在枪械携带权相关判决中,即援引了一份由亲枪支利益集团资助的学术调研报告。

由于调研数据未公开且作者拒绝回应质疑,外界难以判断该研究是否存在偏见。能否保证科研的真实性,关键在于同行评议的质量与透明度。近年来,学术界积极推动研究预注册、全过程透明报告以及强化数据与代码共享,以减少研究的可疑性。面对AI带来的论文量激增,提高审稿人对研究计划、结果稳健性(如规范曲线分析)和数据完整性的审查严谨性变得尤为重要。有些领域如心理学在改革力度上领先于经济学,部分顶级经济学期刊的研究分析甚至暴露出过度夸大证据强度的倾向。未来同行评审不仅面临审稿量剧增的压力,还需引入激励机制保障审稿质量,激励评审者投入更多时间和精力。

维护公众对科学的信任至关重要。科学作为无偏见寻找真理的工具,正由于AI生成内容的泛滥面临被误导的风险。各界必须共同努力,推动科研规范的完善,确保人工智能成为辅助手段,而非误导工具。具体而言,强化AI研究论文的披露要求十分必要,作者应说明AI参与的程度,公开数据及分析代码,并对相关利益关系保持高度透明。此外,加强对企业资助研究的监督,防止利益驱动的"伪科学"泛滥,亦是维护学术环境健康的重要措施。总之,人工智能带来了极大便利,同时也迫使科研界警醒,切实改革现有体系以适应新形势。

唯有提高科研透明度、完善同行评审机制,并严厉打击利益驱动的信息造假,科学才能在AI时代继续承担其揭示世界本质的使命。社会各界应共同努力,让人工智能成为推动知识进步的正能量,为科学研究和公众健康保驾护航。 。