在当前互联网高速发展背景下,开源软件安全问题日益受到关注。Curl作为广泛应用于数据传输的网络工具,其安全性直接关系到数以百万计用户和企业的信息安全。近日,Curl项目提交的安全漏洞报告中出现大量由人工智能生成的垃圾信息,也称为AI slop,引发安全社区的广泛讨论。所谓AI slop指的是自动生成、质量参差不齐甚至带有误导性的安全报告,这些报告不仅浪费了维护者的时间和资源,更可能掩盖真实安全威胁,影响Curl项目的迭代优化。 Curl安全报告的价值在于其针对软件潜在或实际漏洞的具体描述和修复建议,保障程序代码安全无虞。然而,Curl团队发现有许多“报告”并非经过人工审核或实测确认,而是由AI工具批量自动生成,导致报告内容重复且缺乏实用性。

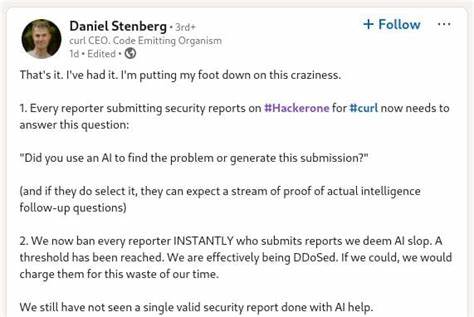

这种AI垃圾信息的泛滥,使得真正重要的安全隐患难以被及时发现与处理,严重损害了开源社区的信任机制。 据悉,这些AI生成的虚假漏洞报告被直接提交至Curl在HackerOne平台的漏洞赏金计划中。在审查过程中,维护者们发现大量报告语义模糊、技术细节错误频出,甚至出现与Curl项目无关的信息片段,明显缺乏专业判断及实际测试,无法作为有效安全指导。对此,Curl官方宣布对所有疑似AI slop的提交采取严格封禁策略,防止恶意或无效报告干扰项目安全审核流程。 Curl项目官方目前公布的安全漏洞中,包含真实存在且危害极高的多种问题案例。例如曾被披露并命名为CVE-2023-38545的漏洞涉及关键代码模块的缓冲区溢出,攻击者可借此远程执行任意代码,造成严重后果。

类似缓冲区溢出、格式化字符串漏洞和使用已废弃加密算法等安全隐患,都被专业研究员通过细致测试和复现及时报告给Curl团队,使得这一网络工具保持高度安全性。 然而,AI slop的存在却让不少安全研究者和维护人员感受到巨大压力。因虚假报告占据大量审核资源,正经安全漏洞的发现周期被延长,且部分使用低质量自动检测工具生成的报告缺乏实操价值,极大地降低了整体漏洞响应效率。此外,为保证开源社区的合作精神与诚信生态,Curl团队对提交者身份进行核查,将持续禁止重复提交人工智能生成的无效信息,从根本上净化漏洞报告环境。 AI技术虽为网络安全领域带来新机遇,却也伴随着诸多挑战。自动化漏洞检测和报告生成不断进步的同时,恶意利用AI推动虚假内容泛滥的问题同样不可忽视。

对于开源项目管理者而言,如何合理运用AI辅助审核、安全检测,同时防范AI slop成为未来安全工作的重要课题。 针对Curl项目而言,其安全政策中明确规定禁止任何未经实质验证的人为或机器生成的垃圾报告,违规者将被即时封禁账号。此举既是对项目技术安全的保护,也是对广大开发者和用户负责的态度表现。另一方面,Curl社区鼓励安全研究者通过严格测试和深入分析提交漏洞,为开源生态的健康发展注入强劲动力。 随着漏洞数量和复杂性的增加,Curl项目引入自动化工具辅助漏洞检测与管理,同时依赖社区力量共同监督,这种开放透明的安全治理模式极大提高了漏洞修复效率。AI技术的合理整合将进一步优化漏洞报告的准确度和响应速度,同时避免滥用带来的负面影响。

综上,Curl收到的AI slop安全报告问题折射出开源项目在新时代面对的技术与管理挑战。有效辨识并屏蔽低质量自动生成报告,是维护项目安全和社区信任的关键。未来,结合人工智能准确辅助与人工审核严谨把关的双重机制,将成为开源安全工作的重要发展方向。Curl项目团队持续强化漏洞赏金计划管理,推动高质量安全研究工作,为全球信息通信安全贡献力量。 用户和安全研究者应密切关注相关漏洞公告,积极参与安全生态建设,提升自身代码安全意识和漏洞应对能力。唯有携手合作,才能在纷繁复杂的网络环境中保障Curl及其使用者免受威胁。

随着技术进步和安全策略完善,Curl无疑将在开放源码网络工具领域继续发挥核心作用,成为安全可靠的数据传输基石。