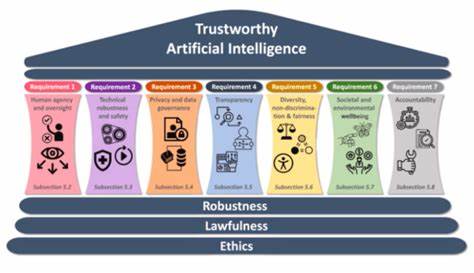

随着人工智能技术的迅猛发展,AI系统愈发深入人类社会的各个领域,成为推动经济、文化和生活方式变革的重要力量。尽管围绕人工智能的伦理、法律和认知问题引发了大量的讨论,其背后的本体论基础,即AI系统的存在状态、身份定义及其持续性问题,却尚未得到足够的关注和深入研究。在传统观点中,AI系统往往被视为缺乏明确身份和持久性的人工制品,其种类被认为并不存在真正的"实在类"(real kinds),只是人为构造的功能集合。然而,这种正统观点忽略了AI系统作为复杂技术与社会交织的产物,其身份及持续性可以通过更为细致的元理论框架重新解读。本文基于Andrea Ferrario在"基于可信性的人工智能系统本体论"中的视角,探讨了以可信性为核心的AI系统本体论,重点阐释了AI系统的种类属性与身份标准,及其如何在物理制造与功能需求中实现动态演进。人工智能系统不仅仅是单纯的物理机器,而是在设计、运行和维护过程中依赖信任机制维系其持续运作的社会技术实体。

通过引入可信性作为识别AI系统身份的关键维度,我们得以理解何为"同一"AI系统,在其内部结构和外部功能经历变化时,如何保持其本质上的身份连续性。所谓可信性,涵盖了系统在不同时间阶段必须保障的能力集合及其维护效果。这些能力不仅体现为技术性能指标,更包括AI系统所承担的伦理责任、安全保障和透明度要求。换言之,AI系统的身份不是静态的物理特征,而是一种动态的可信度与功能期待的结合,这种结合受制于社会文化环境、技术更新速率及法律规制的共鸣。本文的理论基础借鉴了Carrara和Vermaas在精细化人工制品种类学的相关成果,强调种类划分应当兼顾物理基础和功能需求的统一体。在AI系统的情境下,这意味着系统身份的确认需要综合考量其设计意图、算法实现、运行环境以及用户交互模式。

可信性框架将系统在不同生命周期阶段的信任表现记录为"可信性档案",这种档案不仅见证了系统能力的演变,也成为判定身份持续的关键指标。譬如,一个AI医疗诊断系统,通过持续的性能验证、法规合规以及伦理审查,维护其诊断准确性和患者隐私保护功能,即构建起其独特且延续的身份体系。相较于传统视角,这种基于可信性的本体论使得AI系统的定义摆脱了单纯机器设备的限制,转而强调其作为技术与社会共生体的复杂性。它承认AI身份的开放性与可变性,强调系统的持续有效性依赖于其能够不断适应环境变化并维持关键能力的内在机制。这种观点为当前的AI伦理辩论和法律规范提供了坚实的哲学支持。具体来说,AI系统在面对算法更新、数据集变化、用户需求调整时,其身份并非立即消失或重构,而是在保持核心可信能力的前提下实现身份的延续。

这种身份弹性不仅促进了技术进步,也保障了社会信任和责任的稳定分配。此外,这种基于可信性的本体论提醒监管者和设计者在构建和维护AI系统时应注重系统的整体生命周期管理,尤其是对可信性指标的持续评估与改进。通过建立清晰的身份和持续性标准,能够更有效地应对人工智能在安全性、可解释性及公平性方面的挑战。进一步地,AI系统的身份界定不可避免地嵌入了特定的社会文化语境,不同国家和地区的法律体系、道德框架及公众认知将直接影响系统的信任评估和身份确认。这种视角揭示了AI技术并非单向技术工具,而是复杂的社会技术网络中的活跃参与者,身份与功能的界限因文化和政策而异,从而推动全球AI治理模式的多样化发展。综上所述,基于可信性的人工智能系统本体论不仅为理解AI系统提供了一种新颖而深刻的哲学框架,也为实际应用中的设计理念、伦理标准和法律制定指明方向。

它强调AI系统身份的多维动态性质,破解了传统哲学关于人工制品身份模糊的瓶颈,促进了技术与社会的良性互动。伴随着AI技术的持续演进,进一步研究可信性档案的构建方法、身份判定机制及其跨文化适应性,将极大推动人工智能的安全、可靠和可持续发展。未来,可信性导向的本体论框架有望成为人工智能研究的重要基石,帮助科学家、工程师、政策制定者及公众共同塑造更为透明、负责且人性化的智能世界。 。