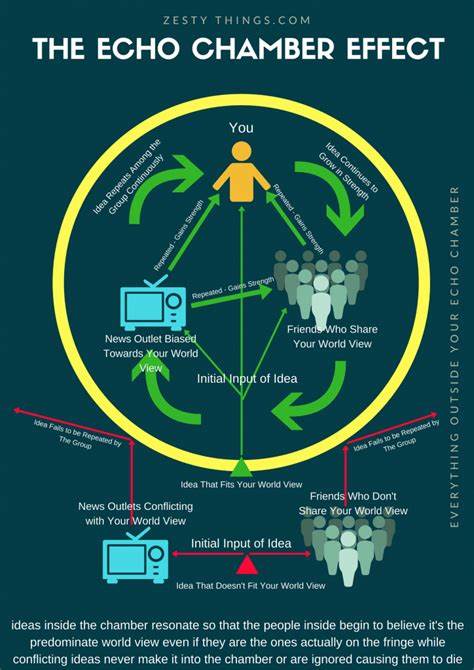

在当今这个日益数字化的时代,人工智能(AI)已经无处不在,深刻地影响着我们的生活。随着技术的发展,AI不仅改变了我们的工作方式,还塑造了我们获取信息的方式。然而,随着这些变化的来临,我们也面临着新的挑战,尤其是与算法偏见和数字多样性相关的问题。近日,AdCounty Media的联合创始人兼首席收入官德尔芬·瓦尔赫斯(Delphin Varghese)在一次引人深思的访谈中,深入探讨了AI如何在无意中建立信息的“回声室”,并提出了打破这种现象的策略。 瓦尔赫斯指出,AI算法在提高用户参与度的同时,也可能导致信息极化。由于算法通常从历史数据中提取信息,这些数据往往带有固有的偏见,可能导致相同类型的信息被不断重复,最终形成“过滤泡沫”。

用户会发现自己只接触到与自己观点一致的信息,这限制了他们的视野,使得多元化的思考受到压制。 在社交媒体上尤其如此,算法根据用户的喜好推荐内容,这种机制虽然增强了用户的参与感,但却也使得个体与不同观点的接触变得愈发困难。瓦尔赫斯提到,正是在这样的背景下,信息的回声室开始蔓延,甚至可能深化社会裂痕,造成更大的观点极化。 一个根本的问题是,许多用户可能毫无意识地沉浸在这些回声室中。他们不仅遭受到了偏见的信息轰炸,甚至在某种程度上失去了批判性思维的能力。瓦尔赫斯强调,打破回声室的首要任务,就是要增强人们对信息来源的透明度。

为了实现这一目标,企业需要在算法开发和实施的过程中引入多样化的数据集,从而减少偏见的影响。 瓦尔赫斯认为,确保AI生成内容的准确性和公正性需要一系列措施。然而,单靠算法的改进是远远不够的。企业必须增加用户对内容偏好的掌控权,同时进行定期的系统审计,以确保各种观点都能得到公平的展现。这种方法不仅可以减少算法偏见,还可以为用户提供更多的选择,从而促进健康的公共讨论。 在想要设计一种能够促进多元视角的AI系统时,瓦尔赫斯建议,企业应当注重训练AI算法时所使用的数据多样性。

他表示,只有结合不同背景的信息,才能减少回声室的风险,最终实现观点的多样化。此外,提升内容过滤的透明度至关重要,这不仅可以增强用户对系统的信任感,还能帮助他们更好地理解信息是如何被选择和呈现的。 如何标识和解决在线社区中的回声室也是一个重要的话题。瓦尔赫斯提到,AI可以通过网络分析、情感分析和参与模式的研究来识别这些现象。比如,AI能够发现仅与同类互动的社区,而几乎没有与外部社区的交互。通过分析这些信息,企业可以更好地理解社区内的讨论内容以及讨论的深度,进而发现潜在的回声室。

为了更好地解决信息的单一化问题,多样化内容供给显得尤为重要。瓦尔赫斯建议,AI生成的个性化提示可以帮助用户探索那些挑战他们固有观念的不同意见,从而促进思想的平衡。这不仅是对偏见的抵制,也是对用户信息素养的提升。 确保AI生成内容的准确性和公正性无疑是行业内的一项重大挑战。瓦尔赫斯强调,企业需要在训练AI模型时使用包容性数据集,并定期审计和更新训练数据,以排除内容偏见。使用工具检测并减轻偏见风险更是必不可少。

此外,人工监督在高风险场合也显得尤为重要,特别是在涉及重要决策时,编辑审查和反馈机制可以帮助发现不准确的信息,从而确保AI生成内容的公正性。 在随着科技不断进步的同时,打破信息回声室不仅是一个技术挑战,也是一个伦理挑战。我们必须在利用AI潜力的同时,积极防范其潜在风险,努力创造一个更加包容和公平的数字世界。通过推动多样性以及增强透明度,我们不仅能够提升用户在信息获取过程中的体验,更能够在整体上促进社会的和谐与进步。 总之,AI所带来的技术革新既为我们提供了便利,也带来了反思的契机。在这一转型的时期,掌握好技术的使用与道德的界限,将是我们每一个人的责任。

唯有如此,才能确保我们在数字化时代的声音不仅是独立的,也是多元的。