近年来,通用人工智能(AGI)的研究备受关注,科学家和工程师们一直在探寻如何打造具有人类智能水平的机器。然而,从数学和信息论的角度深入探讨,AGI的实现并非如想象般简单。结合信息论奠基人香农的理论以及熵的概念,可以发现AGI面临着极其严峻的“无限选择障碍”,这为AGI的实现提出了根本性的挑战。 首先,熵是信息论中的核心概念,它描述了系统的不确定性和信息的复杂度。在智能系统中,熵反映了系统在处理信息时所需应对的复杂程度。对于AGI来说,它必须处理庞大且复杂的信息集合,以模拟人类的认知和决策能力。

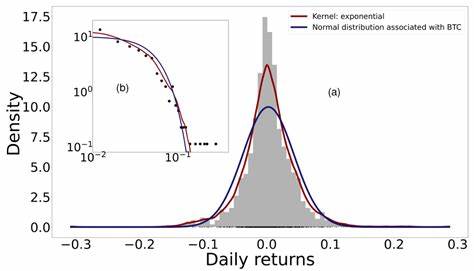

然而,随着信息量的增加,熵也随之升高,这意味着系统需要越来越多的资源来维持有效的运算和决策,这无疑增加了实现AGI的难度。 香农的信息熵理论揭示了处理信息的基本限制。即使是最先进的算法,也难以应对无限多的信息组合和可能性。换言之,AGI所面对的选择空间是极为庞大的,而且随着输入信息的迭代增长,这种空间呈指数级扩展,形成所谓的“无限选择障碍”。这一障碍意味着AGI无法在有限的时间和资源内遍历所有可能的状态和决策路径,从而无法实现真正的通用智能。 此外,熵的回归表明系统在试图降低不确定性和复杂度时,经常会陷入局部最优解,而非达到全球最优。

这与人类智能在复杂环境下的表现相似,但对于机器而言,缺少自我调整的灵活性可能导致其在处理复杂问题时效率下降。也就是说,AGI必须面对不仅仅是计算能力的局限,也有算法结构本身的限制,这些限制源自熵所带来的系统瓶颈。 另外,复杂系统理论也支持了熵回归的观点。智能系统往往由大量模块组成,每个模块都有自己的状态复杂性及相互作用。随着系统规模的扩大,整体熵又水涨船高,使系统的可预测性和稳定性降低,甚至可能导致系统崩溃。这种现象在尝试构建庞大智能网络时特别明显,体现了自然界普遍存在的熵增定律。

从数学角度分析,AGI需要解决的问题涉及组合爆炸和复杂函数空间探索。无限选择障碍实际上是组合爆炸的体现,而熵的增加则是在高维空间中搜索最优解的难度加大。现代机器学习算法如深度学习在一定程度上通过模型简化和数据驱动的方法缓解了这些问题,但仍无法根本突破熵带来的限制。 这种数学和信息理论的限制还反映在实际应用中。许多号称接近AGI的系统在处理新颖、动态的复杂环境时表现不佳。它们通常依赖大量的训练数据和预编程规则,缺乏真正的自主推理和适应能力。

这说明,尽管在特定领域表现出色,但普适性的智能仍然遥不可及,部分原因正是受到无限选择障碍和熵增定律的影响。 未来AGI研究的方向可能需要重新考虑智能的本质。或许我们需要探索非传统计算模型,如量子计算或生物计算,这些可能在处理高熵信息时表现出不同的性质。此外,智能的实现不一定局限于传统算法逻辑,也可能需要融合认知科学、神经科学及系统动力学的多学科知识,才能更接近真正意义上的通用智能。 综上所述,AGI的数学不可能性主要源于信息理论中的熵和无限选择障碍。熵的增加导致信息系统的复杂性和不确定性急剧上升,限制了智能系统在有限资源和时间内的处理能力。

香农的信息理论再一次提醒我们,无论计算能力多么强大,系统面对的信息复杂度依然是不可忽视的核心挑战。理解和应对熵回归的现象,或许是未来AGI研究能否突破重大瓶颈的关键。 总而言之,AGI并非遥不可及的科幻,而是建立在复杂数学和信息理论基础之上的前沿科学课题。认识到熵和无限选择障碍的存在,有助于我们更加理性地审视AGI的现实可能性和未来发展路径。只有深入理解这些基本限制,才能在人工智能领域做出更加科学有效的布局和创新。