在当代数字媒体高度发达的背景下,网络讨论已成为公众表达意见和参与社会议题的重要平台。随着言论自由的普及与网络群体的多样化,如何维护健康、理性且多元的讨论氛围成为网络治理的核心问题。然而,举报机制在这一过程中表现出复杂的面貌,尤其是观点导向的举报行为日益突出,是否存在压制批判性回复的现象,成为了学界和公众关注的焦点。 观点导向的举报指的是用户基于特定政治、意识形态或个人立场,对与自己观点相悖的回复或内容发起举报。这种行为在表面上有助于遏制仇恨言论、虚假信息和恶意攻击,但在实际操作中,却可能成为限制异见声音的工具,从而影响讨论的多样性与深度。 在许多社交平台或评论区,举报系统往往设计为快速响应用户反馈,优先处理举报量高的内容。

然而,当大量举报源自观点对立时,某些批判性但合理的评论可能被错误认定为违规内容,导致内容被删除或作者受限参与。长期以来,用户的自我审查现象有所加剧,这不仅侵犯了言论自由的精神,也不利于社会公共议题的深入探讨。 从具体案例来看,涉及政治敏感话题的讨论尤其容易出现观点导向举报的乱象。如某些时政事件或社会热点上,参与者的立场分歧悬殊。一方发布批判性评论后,反对方可能发动大规模举报行动,借助举报机制将声音沉默。这种现象在新闻网站评论区、视频平台弹幕以及热点社交媒体讨论中均有反映,形成某种程度的"言论围猎"。

举报功能的设计目的本是为了保障社区秩序,减少恶意骚扰和不实信息的传播,但当其执行标准因用户举报的立场偏见而变形时,也可能成为操纵舆论、排斥异议的工具。平台的监管团队通常面临难以平衡公平与效率的挑战,尤其是在举报潮涌现时,不得不依赖初步的算法筛选或快速判定,误删内容的风险随之增加。 此外,观点导向举报还可能对用户群体产生心理影响。频繁的举报与内容删除,易使用户产生恐惧感和无力感,降低参与公共讨论的积极性。部分用户可能选择远离政治或敏感议题讨论,导致讨论领域变得同质化,丧失对社会事件深入剖析和多元视角的支持环境。 应对观点导向举报带来的挑战,业界和学界提出多种建议。

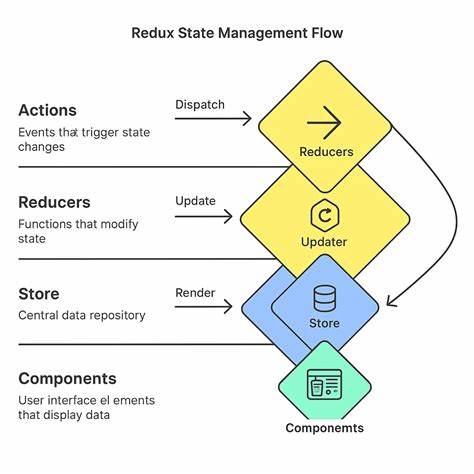

首先,举报系统的规则与执行应更透明,建立客观明确的判定标准,并通过多元的审核机制减少单一视角的影响。其次,加强对举报滥用行为的识别与惩治,防止用户利用系统进行恶意打击。第三,强化平台主体在言论自由与社区安全之间的平衡,促进理性讨论氛围的建设。 技术手段方面,人工智能和机器学习可辅助评估举报内容,通过上下文理解与情感分析,判别举报的合理性和针对性,减少误判。不过,技术并非灵丹妙药,仍需结合人类判断和用户申诉机制。社区自治和用户教育亦是关键,提高用户对言论多样性与网络素养的认知,降低盲目举报行为。

全球范围内,网络监管政策也在逐步完善。部分国家出台保护网络言论自由的法律规定,对平台的内容审核行为进行约束,鼓励构建开放包容的网络讨论空间。同时,国际组织与社会团体积极推动数字权利保护,将防止观点导向的举报滥用作为重点议题。互联网治理的新动向将影响举报机制的未来发展方向。 然而,观点导向举报反映了当代社会深层次的政治极化和认同冲突。网络空间作为现实社会理念碰撞的延续,难免带有情绪对抗和价值冲突色彩。

治理者和社会各方需认识到,控制举报滥用只是表层解决之道,更根本的是推动社会对话的宽容与理解,减少观念鸿沟,才能真正保障言论多样性和批判精神的生存土壤。 综合来看,观点导向举报机制并非单纯的言论自由威胁者,但在缺乏合理引导和规范的情况下,确实存在压制批判性回复的风险。为此,数字平台、法规制定者及用户社会应协同努力,构建坚实且健康的举报处理体系,确保批判和异见声音得到合理表达与尊重,同时净化网络环境,平衡自由与责任的界限。唯有此,网络言论空间才能真正成为促进知识传播、增进公共理解、支持民主参与的宝贵阵地。 。