在科学研究和工程实践中,模型是理解和描述现实世界复杂系统的重要工具。然而,博尼尼悖论(Bonini's paradox)却指出了一个耐人寻味的现象:当模型变得越完整和真实时,反而变得越难以理解。这种悖论不仅挑战了我们对模型构建的传统认知,也提醒科学家和工程师在设计模型时需要兼顾简洁性与复杂性之间的微妙平衡。博尼尼悖论的名称来源于斯坦福商学院教授查尔斯·博尼尼(Charles Bonini),他在研究复杂系统模拟时发现,随着模型复杂度的提升,其可用性和可解释性反而下降,这使得模型几乎与真实系统一样难以被掌握。模型是理解现实世界复杂现象的简化工具。无论是在经济学、生态学还是神经科学领域,研究人员都依赖模型来预测和模拟系统的行为。

然而,现实世界的复杂系统往往具有多层次、多变量和非线性的特点,单一的模型难以全面涵盖所有细节。为此,模型设计者常常试图通过增加参数和细节来增强模型的准确性,期望达到更"真实"的效果。但博尼尼悖论提醒我们,过于复杂的模型可能变得和现实系统一样难以理解,导致其失去指导意义。著名哲学家保罗·瓦莱里(Paul Valéry)曾用一句话精准地表达了这一困境:"简单的东西总是错误的,复杂的东西则无法使用。"这一观点恰恰体现了博尼尼悖论的本质:模型需要在简单与复杂之间找到合适的平衡。一方面,过于简单的模型忽略了诸多关键变量,导致预测结果与现实偏差较大;另一方面,过于复杂的模型则因参数过多、结构复杂而难以分析及应用。

生物学家理查德·列维恩斯(Richard Levins)也在其著名论文《种群生物学中的模型构建策略》中阐述了类似观点。他认为,模型构建需要通过平衡一般性、真实性和可操作性三者来实现最佳效果。任何试图追求极端真实性的模型,都可能牺牲操作简便性,导致"不能被人理解"的局面。随着计算机科学的发展,尤其是人工智能和大数据技术的兴起,人们对复杂模型的兴趣和依赖日益增加。然而即使拥有强大的计算能力,模型的可解释性仍然是亟需解决的问题。在人工智能领域,黑箱模型(如深度神经网络)就是典型的"黑盒",虽然预测准确率高,但其决策过程难以深入解析,受到了博尼尼悖论的启示。

博尼尼悖论也与地图与地理实体之间关系的"地图-领土关系"密切相关。一个极端的例子是乔治·路易斯·博尔赫斯的短篇小说《科学中的精确性》,描述了一个与领土等大的地图,虽完整精准,却毫无实用价值。这一隐喻形象地说明,模型如果过于真实,反而失去了其作为简化工具的意义。在实际应用中,科研人员和决策者应认识到,模型不是现实的完整复制,而是对现实的抽象与简化。为实现有效利用,模型应具备足够的简洁性以供理解和操作,同时包含关键特征以保证准确性。博尼尼悖论提醒我们,追求完美模型的同时,需重视其可理解性与可用性。

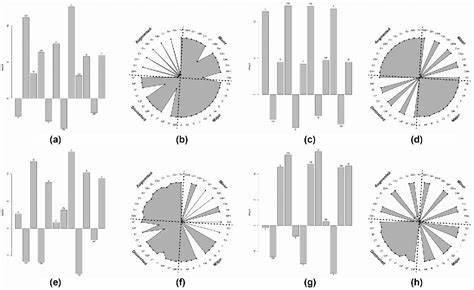

心理学领域面对人类大脑这一极其复杂的系统,同样无法摆脱博尼尼悖论的束缚。尽管神经科学家已收集海量脑部数据并开发多种脑功能模型,但完整描述大脑运作机理的模型仍不可企及。模型越详尽,涉及的神经元连接、化学反应和电信号动态越复杂,导致整体模型不可读且难以推断有效结论。社会科学领域尤其如此,社会系统本身充满不确定性和多变因素。社会学家与经济学家试图通过模型预测人口行为或经济走势时,也面临模型复杂度导致理解难题。在这些领域,模型理应服务于提供实用见解,而非追求理论完美。

技术方面,如何解决博尼尼悖论提出的挑战,是当前系统科学和人工智能研究的重要方向之一。解释性人工智能(Explainable AI)便是回应这一需求的尝试,旨在在保证决策准确性的同时,提高模型的透明度和可解释性。此外,多模型方法,即利用多个较简单模型分别处理系统的不同方面,再综合结果,也是一种避免单一复杂模型陷入博尼尼悖论的策略。这种方法强调模块化和分层设计,既保证了整体系统的代表性,也减少了理解和调试难度。总结来说,博尼尼悖论体现了模型设计的基本矛盾:越是完整准确的模型,越可能因为自身复杂性而失去使用价值。理解这一悖论对于科学研究、工程设计乃至日常决策都至关重要。

它促使我们在迎接越来越复杂系统挑战时,不能仅仅执着于提高模型精度,更要关注模型的可理解性和实用性。未来,随着技术的进步和方法的创新,如何平衡模型复杂性与简洁性,将是推动科学和技术不断突破的重要课题。 。