随着科技的迅猛发展,未来社会的形态变得愈发丰富且复杂。在这个时代,如何有效地管理和利用技术资源,保障人类的安全与福祉,成为人们关注的核心问题。人工统治(Artificracy)与"如果任何人建造,人人皆死"(If Anyone Builds It, Everyone Dies)这两种理念,正代表了未来社会技术治理的两种截然不同的路径,本文将围绕这两种思想进行深入剖析。 人工统治,字面意义上是指通过高度智能化的技术体系和自动化决策机制来管理社会和资源。在这种模式下,人工智能、算法决策和精密的监控系统将参与甚至主导社会治理,取代传统的人类行政和管理职能。这种方式旨在提高效率,降低人为错误,促进公平与可持续发展。

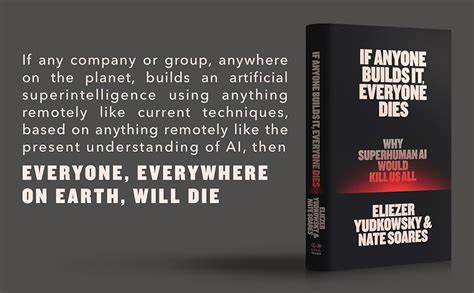

人工统治强调的是一种由科学与技术驱动的社会未来,利用人工智能的超强计算能力和数据分析能力,帮助人类制定更合理的政策和管理策略。 然而,人工统治也带来一系列的伦理和安全隐患。首先,权力高度集中于智能系统和其设计者手中,可能引发权力滥用和社会不平等问题。其次,这种依赖技术的治理模式也存在系统性风险,技术故障或被恶意攻击可能导致严重的社会混乱。此外,人工统治的"黑箱"特性令普通民众难以理解决策过程,可能削弱民主参与和透明度,增加社会的不信任感。 与之形成鲜明对比的是"如果任何人建造,人人皆死"的理念,这一观点强调的是建设和创新的风险与限制。

它警告人类在科技创造上的无节制行为可能带来的灾难性后果,提醒人们在建造和创新过程中必须谨慎,以避免技术失控导致生存环境的破坏。这种观念往往来自于对科技负面效应的深刻担忧,尤其是涉及人工智能、合成生物学和核技术等领域。 该理念背后的核心思想是:科技创新不仅带来便利和进步,也可能引发不可预测的危险。若所有人都能轻易建造高级、潜在危险的技术产品,整个社会面临的风险将急剧上升。这样的担忧呼吁对技术进行更严格的监管和限制,避免技术滥用对人类文明造成毁灭性的影响。 事实上,这两种理念并非完全对立,而是社会在面对技术进步时的不同态度和策略选择。

人工统治代表了一种积极拥抱技术、通过技术手段实现高效治理的未来愿景;而"如果任何人建造,人人皆死"则体现了对技术滥用后果的深刻忧虑,主张谨慎约束技术发展范围,两者共同反映出人类社会在技术领域的矛盾心态。 在现实世界中,如何在技术创新和风险管控之间取得平衡,是未来发展中极为重要的课题。科技带来的便利和能力不可否认,但一旦失控,可能对生态、社会甚至人类本身造成不可逆转的损害。实现这一平衡,需要多方面的合作和智慧,包括政府出台有力的法规政策,科技界加强自律和伦理建设,公众提高科技素养,积极参与监督和讨论。 此外,新时代的全球化背景也进一步复杂化了这一问题。技术的快速传播和易获取性意味着单一国家或组织难以完全控制高风险技术的开发和使用。

国际合作和共识形成显得尤为关键。只有通过跨国界的制度设计和执行,才能尽量降低技术带来的系统性风险,保障全球人类的安全与共同利益。 值得注意的是,人工统治并非单纯的技术乌托邦思想,其理念中也包含对人类价值的深切关注。设计有效的人工智能治理体系,不仅仅是技术问题,更关乎人类的伦理道德、自由权利和社会公正。构建可信赖、透明且包容的智能系统,是实现人工统治愿景的关键要素。 综合来看,未来社会面临的挑战十分复杂,而人工统治与"如果任何人建造,人人皆死"这两种思想,为我们提供了不同角度的启示。

它们提醒我们在技术飞速发展的时代,必须既保持技术乐观的态度,也不能忽视潜藏的风险。只有在理性、科学、伦理的基础上,有效融合创新与监管,方能共创一个可持续、繁荣且充满人性关怀的未来。 面对未来,或许我们需要的不只是技术的升级,更是对技术与人类关系的深刻反思和智慧调适。如何让"下一代的我们"能够共享一个安全、和谐且充满希望的世界,成为摆在当代和未来人类面前的重要课题。人工统治与"如果任何人建造,人人皆死"的讨论,正是引发这一反思的关键窗口,值得我们持续关注和探索。 。