在数字信息技术中,字节(byte)作为数据的基本单位,广泛应用于计算机存储、数据传输及信息处理领域。然而,关于字节及其倍数单位的定义并非单一标准,而是存在多个体系,导致术语使用上的混淆与争议。透过探讨字节的起源、发展及其多重定义系统,可以更好地理解现代信息技术中单位的多样性及标准化过程。 字节的概念最早由Werner Buchholz于1956年在IBM Stretch项目中提出,其本意为一组用于编码字符的二进制位,最初字节的大小并未固定,曾出现过从1位到48位不等的多种定义。在早期计算机架构里,字节的位数常依硬件设计和用途不同而变化,诸如六位、九位字节曾一度常见。随着计算机技术的进步,八位字节逐渐成为事实上的标准,因为它能代表256种不同的编码值,符合二进制的指数特性,也方便实现字符的存储与处理。

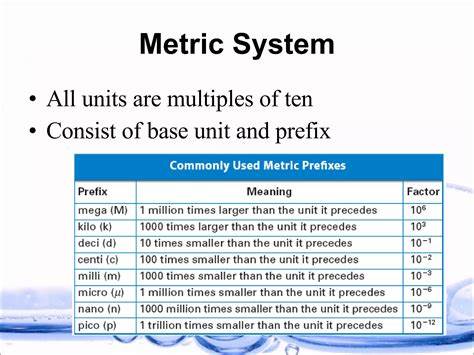

与此同时,为了消除"字节"概念的不确定性,特别是在网络协议领域,出现了"八位组"(octet)这一明确表示包含八个位的单位,以避免因字节长度不同而产生的歧义。国际电工委员会(IEC)和其他标准化组织认可字节符号为大写字母"B",而八位组则用小写字母"o"表示,并广泛用于多国语言中,以兼容不同文化和技术背景。 随着信息量持续攀升,字节的倍数单位也日益重要。这里存在两大主要体系:基于十进制的国际单位制(SI)前缀和基于二进制的IEC前缀。前者采用千进制,如千字节(kB,1,000字节)、兆字节(MB,1,000,000字节)等,广泛应用于存储设备容量标示、网络速度和数据传输率等方面。后者则以1024为底数(2的10次方),如千字节(KiB,1,024字节)、兆字节(MiB,1,048,576字节)等,更符合同二进制体系下的内存和计算操作实际情况。

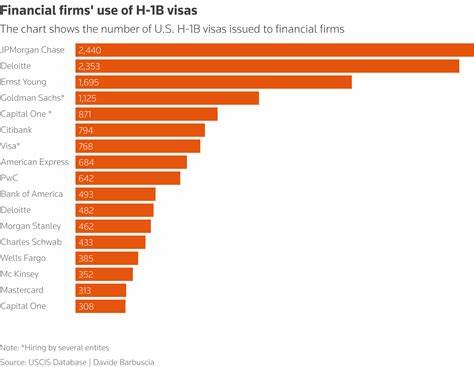

历史上,二进制与十进制单位混用造成了诸多混淆和争议。许多操作系统、硬盘和软件在展示容量时,往往使用如"KB"、"MB"、"GB"等符号,却在实际数值意义上参照的是不同基数单位。举例来说,硬盘厂商通常以十进制标准计量硬盘容量,1GB被定义为10亿字节;而Windows操作系统的文件管理器却采用二进制换算,1GB显示为2的30次方字节,即约10.74亿字节,导致用户感知到的可用容量少于厂商标称容量,引发了消费者误解及相关法律诉讼。 为解决这一混乱,国际标准化组织于1998年采纳了由IUPAC提出的二进制前缀命名方案,推出了kibi(Ki)、mebi(Mi)、gibi(Gi)等符号,专门用于标识基于1024的单位。这一措施旨在明确区分十进制和二进制单位,避免术语重叠和信息误导。虽然IEC标准已被广泛接受,但实际应用中诸如Microsoft Windows、某些通信公司及传统软件仍然沿用早期习惯,二进制和十进制单位界线依然模糊。

此外,还有一些厂商和行业采用了特有的度量单位,例如"nibble"代表4位(二进制位的半字节),或历史上的各种"字"(word)、"长字"(long word)等计算机架构相关术语,尽管这些并未形成国际统一标准,但在不同技术文献及应用领域有所保留。 信息技术进步推动了单位名称的拓展与更新。近年来,国际计量局(BIPM)相继增加了"ronna-"(10的27次方)和"quetta-"(10的30次方)等新的十进制前缀,用于标示未来超大数量级的数据规模,顺应大数据、云存储和全球互联网流量高速增长的趋势。 在计算机编程语言层面,byte类型通常指代八位宽的存储单元,能够表达0到255之间的256个不同值。主流语言如Java、Python、C#、Rust等均如此定义,为跨平台编程和数据交换提供统一基础。C和C++标准对byte的定义较为宽泛,允许不同实现的字节大小,但主流现代系统仍基本采用8位字节构架,以保证兼容性。

数据传输中,byte作为数据块概念被广泛应用,例如异步通讯协议中,一字节通常还包括起始位、停止位及奇偶校验位,整体传输单元长度超过8位,但数据有效位即为1个byte,保证数据的准确传递和处理。 法律层面,因为消费者对存储设备容量的期待与实际容量有所差异,多起关于"千兆字节"定义的诉讼均以采用十进制定义为主流判断标准告终,确认1GB应理解为10亿字节,保障了制造商的合法权益,但也促使行业逐渐推动更加明确和透明的单位标识。 总体来看,字节及其倍数单位的多重定义反映了计算机科学与技术不断发展的历史脉络及实际需求。正确理解并区分这些单位,有助于消除计算机存储容量的误解,提升设备性能的认知,促进标准化实施。全球范围内,单位规范的统一仍需各界持续推进,尤其是在大数据和云计算时代,标准明确与一致性对技术创新和用户体验尤为关键。 未来,随着技术更新带来的改变和信息量的指数级增长,数据单位的命名、使用和标准或将进一步演进。

传承历史经验的同时,通过科学严谨的定义与普及,有望实现数据度量单位的全球通用,为数字世界构建更加清晰和便捷的基础架构。 。