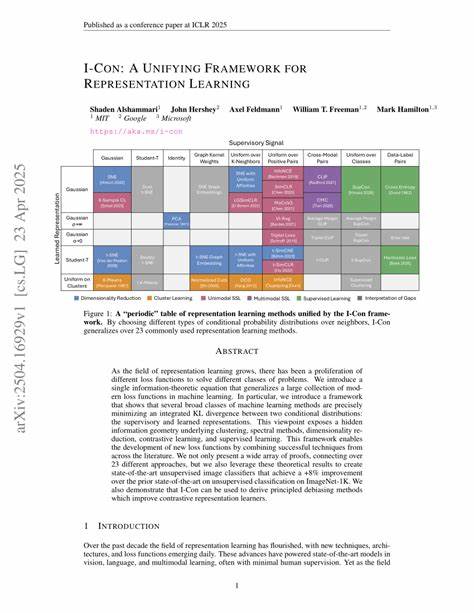

随着人工智能的发展,表征学习已成为机器学习领域的核心技术之一。表征学习旨在从原始数据中抽取有意义的特征,使得机器能够更好地理解和处理信息。在过去的几年中,研究人员提出了多种用于训练模型的损失函数,这些损失函数分别针对不同的问题和应用表现出了良好的效果。但损失函数的多样化也带来了新的挑战:如何统一这些看似分散的方法,以及如何设计出更具普适性和有效性的学习框架?最近,由Shaden Alshammari等学者提出的I-Con框架,提供了一种基于信息论的新颖解决方案,为表征学习的发展开辟了新的路径。I-Con框架的核心理念是将多种机器学习方法统一到一个信息论方程下,通过最小化两个条件分布之间的集成相对熵(KL散度),来优化学习的表示。这样一个视角不仅揭示了潜藏的“信息几何”结构,还将聚类、谱方法、降维、对比学习以及监督学习等多种方法联系起来,为表征学习的理论基础建立了坚实的桥梁。

该方法极大地推动了无监督学习的性能提升,尤其是在图像分类任务中取得了卓越表现。在无监督的ImageNet-1K图像分类测试中,I-Con框架取得了8%以上的性能提升,刷新了当前领域的最佳记录。除此之外,I-Con还为研究者们提供了设计新型损失函数的灵活工具,将不同技术优势有效融合,进一步推动了机器学习算法的创新。信息论视角是I-Con框架的理论基石。传统的方法往往通过经验性设计损失函数,而I-Con却从根本上利用了监督信号和模型学习的表示之间的概率分布差异。这种KL散度的思想,能够精准定义信息流动的高效路径,使得模型提取的特征更具代表性和判别力。

通过这种方式,I-Con揭示了数据中隐含的结构信息,提高了模型的泛化能力和稳健性。I-Con框架尤其在对比学习领域表现出色。对比学习是一种自监督学习技术,依赖于构建正负样本对来学习区分特征。传统的对比学习方法在采样正负对和设计损失上存在一定限制,而I-Con通过统一的KL散度损失为对比学习注入了理论深度和灵活性。在保持信息最大化的同时,有效抑制了无关噪声的干扰,提升了表示质量。同时,I-Con在去偏差领域实现了重要突破。

机器学习模型往往受到训练数据偏差的影响,导致在实际应用中表现不佳。通过I-Con框架,研究人员设计出了一套原理性强、效果显著的去偏差方法,从而提高了模型的公平性和鲁棒性。这不仅丰富了无监督学习的理论体系,也为实践中的模型优化提供了指导。此外,I-Con为传统的谱方法和聚类算法带来了新的诠释。通过信息几何的观点,聚类的目标可以理解为最小化不同条件分布间的距离,这种理解帮助改进了算法稳定性和聚类效果。谱方法中的特征映射和降维过程,也因I-Con框架而获得了更加明确的数学意义,增强了方法的解释力和应用范围。

从深度学习角度看,I-Con为设计更有效的神经网络损失函数提供了多样化方案。当前神经网络模型训练高度依赖损失函数的选择,I-Con统一了这一选择基础,帮助模型在不同任务之间灵活迁移,同时保证了训练的稳定性和效率。这样的统一框架,有望推动未来深度学习模型的多模态融合与跨领域应用。未来,随着I-Con框架的不断完善和应用扩展,它将成为表征学习领域的重要基石。围绕I-Con的研究不仅将带来更多理论创新,也可能催生出一系列具备高度实用价值的新算法。尤其是在无监督和自监督学习逐渐成为主流的背景下,I-Con的出现为解决数据标注困难、多样化任务需求等问题提供了有力保障。

综合来看,I-Con代表了当前表征学习研究的一个重要趋势,即通过信息论视角实现方法的统一与拓展。它不仅为机器学习领域注入了新的活力,更为实际应用带来了切实可行的提升,推动人工智能技术迈向更高层次。作为未来研究与工业界关注的热点,I-Con框架将持续引领机器学习的变革,助力智能系统更好地理解复杂数据世界,释放前所未有的潜力。