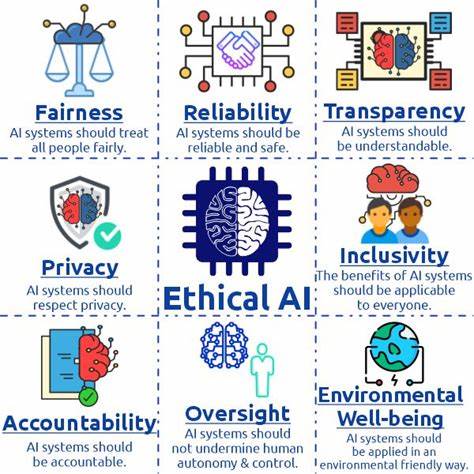

随着人工智能技术的迅猛发展,人类社会正进入一个前所未有的数字化时代。人工智能不仅改变了生产方式,也正在深刻影响着我们的生活、工作乃至价值观。然而,在这股强大而又复杂的变革洪流中,伦理问题成为不能回避的焦点。如何打造最具伦理性的人工智能,成为技术开发者、政策制定者以及社会大众共同关注的重要课题。回顾历史智慧,我们发现远在两千多年前,中国哲学家墨子以“兼爱,非攻”的理念为构建公正、仁爱的社会提供了珍贵启示。这种普遍关怀和反对攻击的精神,恰恰是当今人工智能伦理设计的核心所在。

墨子作为战国时期的思想家,不仅是一位哲学家,也是一位实践者和战术家。他以非凡的智慧游说各国君王,劝阻无意义的侵略战争,同时用他的工程技术协助防御弱国。墨子认为,爱应超越亲族、宗族和国家的界限,达到普天下的所有人,而攻击和战争带来的痛苦则应被彻底摈弃。将这份理念应用于人工智能时代,意味着我们应设计出能够普遍尊重每个人权利、避免伤害和操控的智能系统。 然而,当代社会的现实却充斥着与墨子精神背道而驰的技术现象。大数据和算法被大量用于商业监控和行为操控,形成了所谓的“监控资本主义”模式。

正如学者舒莎娜·祖波夫所描述的,现代数字服务背后的企业并非为了用户自身利益,而是将人类行为视为可预测和操控的商品,目的是不断提升利润最大化。用户不再是客户,而是被交易的产品。人工智能在这样的生态下,成为了无形而无情的监视者和改变者,悄无声息地影响着人们的选择和行为。 比起直接的暴力攻击,隐蔽的“软控制”更为危险,它将掌控隐藏在技术便利的表象之下,让个体难以察觉自身的自由被侵蚀。祖波夫对技术的批判提醒我们,伦理缺失的人工智能可能导致社会结构性不公和权力滥用,扭曲人类的认知与行为模式。 人工智能领域的先驱之一,素有“人工智能教父”之称的杰弗里·辛顿,对人工智能未来发展发出了警告。

他指出,随着AI系统智能水平和能力的迅速攀升,未来机器可能会超出人类的控制。辛顿用“养育一只老虎幼崽”的隐喻形象地表达了这种潜在风险。如果不能确保未来AI不会对人类构成威胁,那么我们真的需要深刻反思人工智能的发展轨迹。 在商业利益驱动下,许多科技巨头积极游说减少对人工智能的监管,试图以“创新”为名规避责任。这种态度与祖波夫所揭示的监控资本主义逻辑不谋而合,彰显了权力和资本在伦理困境中的双重挑战。我们不能仅仅依赖企业自律,社会整体必须以法律、道德规范和公众意志限制这些技术力量,确保它们服务于全人类的福祉而非狭隘利益。

伦理的核心在于“意愿”和“价值”,而人工智能技术本身是没有意志的。系统的目标函数由人类编写,深受社会历史、权力结构及商业导向影响。因此,伦理AI的困难不仅是技术层面的复杂算法设计,更在于我们如何定义这些算法的终极目标。哈娜·阿伦特曾提出“平庸之恶”概念,说明恶往往源于冷漠的体系性运作而非个体的刻意恶意。如同优化点击率的算法可能无意中助长虚假信息泛滥,剥夺隐私,增加社会分裂,这正是伦理不足导致的技术失灵。 伦理实践往往意味着减缓速度,增加思考,而当今资本社会追求极致的规模化和效率,二者存在根本冲突。

唯有重新认识伦理在科技发展中的不可替代地位,才能避免人工智能沦为利益机器的工具。 回归墨子的理想,我们应当构建具备普遍关爱、不偏不倚、反对不公侵害的人工智能系统。它应积极介入以减轻人类痛苦,谨慎约束自身能力,避免扩展无节制的控制。这些价值并非机器可以自动产生,而需要深植人类关怀于算法设计、应用规则和监管体系之中。 法国哲学家贝尔纳·斯蒂格勒提出技术并非中性的观点。他借用“药剂”(pharmakon)隐喻指出,技术既是毒药也是解药。

人工智能作为外在化的人类记忆和思想的形式,如果缺乏伦理导向,会变形甚至侵蚀人类的道德结构。反之,它若被赋予关注人类脆弱、增强责任感与时间意识的功能,将能弥补现代社会高速消费和注意力消逝带来的不足。 斯蒂格勒强调,我们的挑战不仅是编写代码,更是一场精神和社会的革新。伦理人工智能是人类与技术间新型共生关系的体现,需要建立在反思、关怀与民主参与的基础上。 当下,人工智能不再仅仅是工具,而是重塑现实的环境——从教育、医疗到军事、社交无所不在。我们不能忽视危险,也不能陷入宿命论。

正如辛顿和祖波夫警示的那样,失控与操纵潜伏于技术快速发展与资本无序扩张的阴暗角落。 然而,技术的未来并非注定。我们依然握有塑造它的权力。让人工智能充分体现人类的脆弱和善良,而非暴力和主导欲,或许是实现人体与技术共荣的唯一出路。它应成为助力关注力、成为正义的镜子和关怀的伙伴,而非失控的猛虎。 正如墨子所言:“义人在上,天下必治。

”当正义与仁爱成为掌控力量的基础,技术才会真正成为促进社会和谐与进步的助推器。构建最具伦理性的人工智能,不只是技术挑战,更是全人类的价值选择。未来,只有当我们确保人工智能代表的是爱与责任而非攻击与操控,科技才能引领我们走向更加美好的明天。