在生成式人工智能快速融入软件开发的今天,Claude Code与Codex CLI成为最受关注的两种命令行代码代理。两者代表了不同公司的技术路径与产品设计理念:Anthropic强调以Agent为核心的交互式CLI与安全约束,OpenAI则在模型能力和成本上持续优化。本文基于一次现实项目重构测试的观察,从多个维度对比两者在工程工作流中的优劣,以便开发团队在选择工具时能有更清晰的参考意见。 从使用方式上看,Claude Code的设计更偏向把模型当成一个可执行的团队成员。通过CLI界面,它不仅接受自然语言指令,还能执行shell命令、读写文件、运行测试与构建流程。这种"带手脚的"代理体验让开发者可以在终端内完成规划、实现与调试的闭环,尤其适合偏好脚本化、可复现流程的团队。

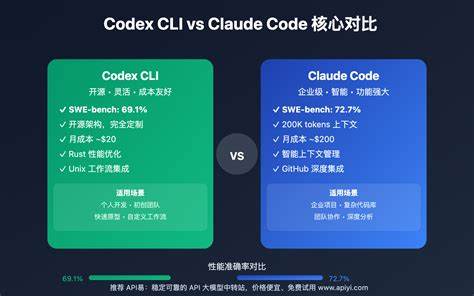

Codex CLI同样提供类似交互,但在早期版本中常以模型补全为主,后续随着GPT-5与专用Codex变体的推出,OpenAI逐步强化了其agent能力与对项目上下文的感知。 模型性能与稳定性是评估生成式代码代理的核心指标。基于实际的React/TypeScript项目重构实验,Sonnet 4.5与GPT-5-Codex均展现了很强的实现能力,但在结果质量、调试次数与生成UI体验上存在差异。Claude Code 2(Sonnet 4.5)在初始实现阶段接近完整功能,动画与交互细节一次性通过的概率更高,调试轮次较少,整体体验更流畅。Codex CLI使用GPT-5-Codex在多项细节上也能达到较高质量,但在特定视觉对齐与复杂动画修正方面出现更多迭代,部分问题需要借助截图或额外工具才能定位与修复。 调试能力不仅取决于模型的生成准确性,还依赖于agent harness提供的可见性与交互反馈。

Claude Code在调试过程中展示了更丰富的"思考轨迹",开发者可以看到模型的内部推理与步骤规划,这对于定位问题、判断改动风险与建立信任非常有帮助。相比之下,Codex CLI在日志或思路输出上的透明度较低,虽然能给出合理的事后解释,但缺乏连续性的思考痕迹会使开发者在复杂修复过程中感到不够确定。 上下文窗口与项目规模感知同样左右代理表现。理论上,Claude系列模型支持更大的上下文窗口,但在具体实现的CLI中可能存在使用限制。GPT-5与其Codex变体则在上下文管理和压缩策略上表现出不同权衡,某些场景下能更频繁保留关键信息而不被压缩。实际效果受多种因素影响,包括文件结构、执行日志、测试输出与提示工程的书写方式。

为最大化成功率,推荐将规范、关键文件与分步计划作为单独资源注入代理,并采用分步骤实现与验证的工作流。 成本因素对广泛采用至关重要。GPT-5在输入与输出令牌计费上明显低于部分Claude模型,这在长上下文或频繁交互的场景中带来直接经济优势。Anthropic的定价在高上下文或高级模型(如Opus)时可能更高,但其在某些任务上的效率与准确性可抵消部分成本差异。工程团队应结合自身交互频率、上下文长度与性能需求,进行成本效益评估,而不是仅凭单次质量比较做出决策。 安全与控制是企业级采用的另一关键考量。

Anthropic在模型行为约束与对外操作权限的管理上有一套Agent层面的治理机制,适合需要严格审计与操作可控性的组织。OpenAI在API层与模型行为上也提供多种配置手段,且在社区与生态系统方面拥有更广泛的集成与插件支持。选择时要衡量团队对外部权限、代码审计与合规需求的优先级,确保代理在文件读写、依赖安装与构建执行等操作上遵守既定安全策略。 开发者体验不仅局限于模型输出是否正确,还包括交互速度、任务规划能力与测试覆盖质量。在实际测试中,Claude Code 2展示了更为清晰的项目分解与阶段化计划,生成的单元与集成测试在通过率与相关性上表现更好。Codex在生成测试时也相当有用,但偶尔会产生与实现不同步或需要额外调整的测试代码。

两者均表明,当代理被要求逐步实施并在每一步运行与修正时,产出质量更高;一次性下达大规模实现指令往往会导致更多回滚与重工。 CLI代理的UX细节也会影响接受度。Claude Code的交互反馈、错误提示与可视化思路输出降低了用户教育成本,使团队可以更快地采纳该工具并将其融入现有流程。Codex CLI凭借更早的模型演进与更广泛的社区示例,拥有丰富的集成方案与扩展插件,这对追求生态兼容与工具链统一的团队而言是重要优势。 从长远视角来看,模型演化速度会不断改变工具之间的相对优势。短时间内版本迭代、prompt工程与agent harness的改进能显著影响体验。

基于现有观察,Sonnet 4.5与Claude Code 2在可用性、一次性达成复杂交互效果与调试效率上具有领先优势,而GPT-5-Codex在成本、生态与某些生成速度上保有强劲竞争力。企业与开发者在选择时应考虑当前项目的关键风险点:如果优先保证交互质量与减少调试迭代,Claude Code是更稳妥的选择;如果预算敏感且需要大量反复交互或整合现有OpenAI生态,Codex CLI可能更具成本效益。 在实践层面,推荐的采纳策略是以小规模试点开始,在真实项目中评估代理对开发周期、缺陷率与团队满意度的影响。为提高成功率,应把规范文档、核心数据模型与测试用例作为结构化上下文提供给代理,采用分步骤实现并在每一步运行自动化测试以快速反馈。无论最终选择哪一个工具,团队应建立明确的审计与回退流程,保留人工复核的关键环节以应对模型偶发性错误或不确定改动。 结语中应强调,Claude Code与Codex CLI代表了生成式AI在软件工程领域的两条重要路径:一种强调Agent式、交互式的开发伴侣体验,另一种侧重于模型能力、成本与生态整合。

随着模型和工具的持续迭代,开发者的工具箱会更加丰富。更重要的是,团队应基于真实工程指标和长期维护成本来判断工具适配度,而不是单次体验的偏好。对于希望提高开发效率、降低重复性工作的团队而言,理性试用并系统化评估这些代码代理,将带来可观的生产力提升与更健康的软件交付流程。 。