算法,作为计算机科学中的基础概念,原本仅指一系列明确的规则和步骤,用以解决特定的问题。然而,随着数字技术和人工智能的迅猛发展,算法的外延和内涵在公众和政府层面逐渐演变,呈现出更加复杂和多元的面貌。政府对算法的理解,不再局限于技术层面,而是涉及其在社会治理、法律监管乃至公民权益保障中的关键作用。疫情期间英国政府因应A-level考试无法正常举办,采用算法预测学生成绩的事件便成为政府对算法认知和应用的重要案例。该算法综合了学生以往考试成绩、学校历史表现及教师预估分数,试图以数据驱动的方式评定成绩。然而,独立学校与公立学校的高分发放比例异常,导致不少学生失去理想大学的录取资格,引发广泛不满与抗议,学生们更是公开表达对"算法"的强烈反感。

这一事件暴露出公众对算法决策过程透明度的期待,以及对算法可能导致不公的忧虑。在计算机科学中,长除法或宗教节日日期的计算都是算法的范例,强调其精准且可重复的特性。但在大众语境中,人们谈论"算法"时,更多是指那些以复杂模型和机器学习技术为基础,影响人们生活和决策的"黑箱"系统。例如,社交媒体上的推荐算法、自动化定价系统或招聘筛选机制,它们的运作难以被普通用户理解甚至察觉,而其决定结果却深刻影响社会公平和个人命运。政府面对这样的背景,认识到有必要对这类"大算法"进行有效监管,以防算法导致的歧视、不公或市场垄断现象发生。法律制定者试图通过立法清晰界定算法的适用范围,比如英国的《在线安全法案2023》中,依据用户数及内容推荐系统的使用情况,将服务分为不同类别,针对大型平台实施更严格的合规要求。

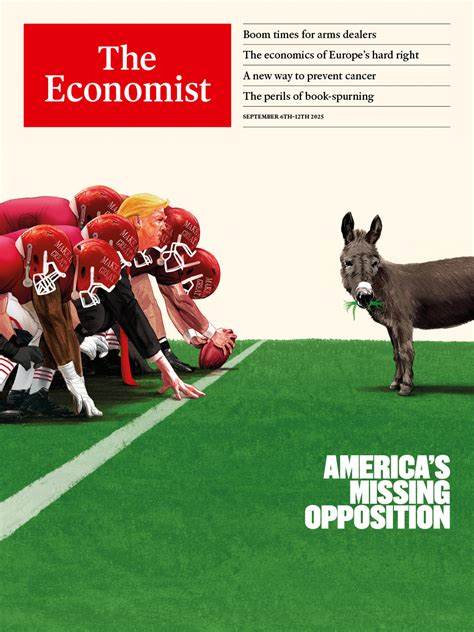

内容推荐算法被特别关注,原因在于它们影响信息流通,可能形成"信息茧房",助长极端观点或虚假信息的传播,从而危害民主价值和社会稳定。法规要求平台增加算法透明度,允许监管机构检查算法运作机制,以确保其不对特定群体产生不公平待遇。然而,要明确界定"内容推荐算法"与"普通算法"的边界极具挑战。单纯排序展示最新内容的简单算法,和运用机器学习模型精准推荐个性化内容的算法,在法律审视下如何区分,需要深厚的技术理解与法律智慧相结合。实际上,正因算法的技术复杂性与应用场景的多样性,政府在监管时必须兼顾保护创新动力和防止潜在风险之间的平衡。在教育领域,算法辅助决策要保证公平公正,避免加剧社会不平等。

在商业市场中,防止基于算法的价格操纵或不正当竞争是维护消费者权益的重要保障。而在公共舆论和信息传播层面,抵制算法驱动的极化和误导,保障多元声音,也是政府关注的焦点。公众对"算法"的不信任,很大程度源自其黑箱特性和操作不透明。解决这一矛盾,推动算法透明和责任追究机制的建立,是未来监管的关键方向。算法设计者和平台运营者应承担更大社会责任,确保算法的开发与运行符合伦理规范和法律要求。总之,政府视角下的算法远不只是冷冰冰的代码,而是关乎社会公平、法律正义与公共信任的重要工具和挑战。

只有通过审慎的政策制定、科学的技术评估和积极的公众参与,才能真正实现算法潜力的正向释放,推动社会进步与和谐发展。 。