随着大型语言模型(LLM)技术的成熟,智能代理正逐渐渗透到日常工作和业务流程中,尤其是在财务管理领域。财务场景对准确性和透明度要求极高,任何错误都可能导致信任崩塌,影响用户使用体验和业务声誉。因此,如何打造用户真正信赖的智能代理,成为研发团队面临的重要课题。 要打造可信赖的智能代理,首先需要选择适合应用场景。LLM代理最适合处理那些简单规则难以涵盖、但工作量庞大且价值巨大的任务。例如在财务管理中,费用审批、信用卡商户识别、收据解析等工作常常既繁琐又易出错,是自动化的绝佳候选者。

合理选择场景能最大化AI的效率提升和价值兑现,同时有效规避潜在风险。 沟通智能代理的决策过程至关重要。不同于传统软件,LLM的决策并非简单规则判断,而是基于语言理解和推理,可能产生一定的不确定性。为建立用户信任,智能代理需要“展示其思考过程”,清晰说明决定的原因,告诉用户为何批准或拒绝某项费用。这样的透明度不仅帮助用户快速发现错误,更提升系统整体的可靠性和可维护性。 在决策解释中,引入引用和数据来源进一步增强可信度。

大型语言模型容易产生“幻觉”,即自信但错误的信息。为避免这种情况,智能代理应直接链接到用户的实际政策条款、数据和支持材料,使用户能够方便验证并理解智能代理的依据。这种事实数据的锚定机制使得智能代理的结论更具说服力,防止盲目信任带来的隐患。 考虑到现实世界的复杂性,构建“逃生舱口”机制是非常必要的。当智能代理面对不确定或模棱两可的情况时,应允许其主动表示“我不确定”,并将决策推回人工处理,从而有效避免因自信错误造成严重后果。这种对自身局限性的承认不仅体现了智能代理的谦逊,也成为提升用户信任的强大保障。

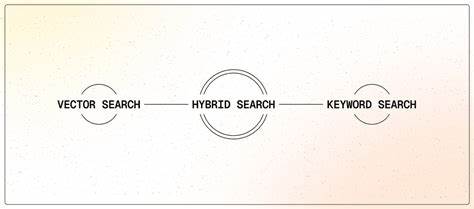

许多企业尝试让智能代理输出置信度分数,但往往会引起误导。在LLM的设计里,置信度并不像统计模型那样可靠,更像人类主观估计。相比之下,设定清晰的行动分类更为有效,例如“批准”、“拒绝”或“需要复核”。这种做法不仅易于理解,也能为用户明确指示下一步操作,减少误解和盲区。 上下文管理是智能代理表现优劣的关键因素之一。传统的LLM应用通常只在启动时注入一次上下文信息,缺乏动态更新和协同调整的机制。

相反,让用户主动参与上下文管理,实时维护并调整代理的判断依据,可以极大提升智能代理的准确性和适应性。举例而言,将用户的财务政策文档数字化并集成到系统中,允许用户直接编辑和更新,是提升代理表现的有效策略。 此外,智能代理的行为自由度设置,也就是“自主权调节器”,对建立信任同样重要。不同用户和组织对于代理自主处理事务的接受程度存在巨大差异。设计允许用户自主调整代理权限和行动范围的功能,确保智能代理不会超出用户心理预期和业务规则,是维护长期合作关系的前提。比如设置审批金额上限、禁止特定商户等规则,既是安全网又是用户对代理的信号传达。

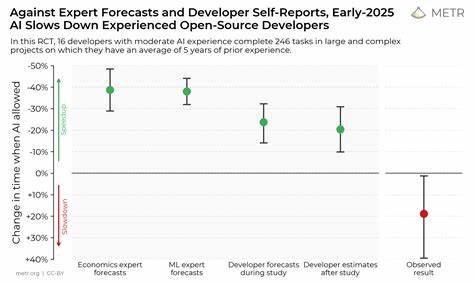

智能代理的推广路径也应循序渐进。初期通过让代理提出建议,帮助用户打开思路和节省时间,而非直接执行决策,有利于用户对代理能力建立信任。随着使用经验积累和代理准确率提升,再逐步授权代理处理部分或全部事务,实现完全自主操作。这样的渐进方式能够减少用户戒备,提高系统接受度。 在智能代理的持续优化过程中,评估系统的表现不可或缺。类似传统软件的单元测试,LLM系统需要专门设计“评估用例(evals)”,以确保系统功能的正确性和稳定性。

对关键的、复杂的边缘案例进行聚焦测试,可以迅速发现潜在缺陷并推进系统改进。同时,用户反馈和错误标注也应纳入数据训练和调试流程,建立闭环提升机制。 值得注意的是,在某些领域如财务,用户行为本身存在一定宽容度,部分并非严格违规的审批被允许通过。直接将用户操作等同于“真相”,可能导致智能代理过于宽松,从而影响风险控制。因此,专业团队审核建立的“黄金数据集”,基于系统内客观信息确定正确决策标准,成为保证代理判断客观性和精准性的有效手段。 归根结底,成功打造用户信赖的智能代理基于几个核心理念。

第一是透明度,让智能代理的推理过程对用户完全开放,增强认知和可追溯性。第二是用户主导式控制,赋予用户定义代理权限和规则的能力,保留他们对业务的完全掌控。第三是协作式反馈机制,使智能代理不断调整上下文和策略,避免僵化和失误。最后是持续评估和演进,通过科学的评测体系保障智能代理的高质量交付。 智能代理的未来充满无限可能,尤其在自动化和智能化需求日益增长的现代商业环境中。只要遵循以上原则,用心构建与用户深度互动的系统,就能突破信任壁垒,实现真正具有经济价值和操作价值的智能服务。

期待更多企业投入到可信赖智能代理的研发,将AI赋能推向全新高度,推动产业变革和效率革命。