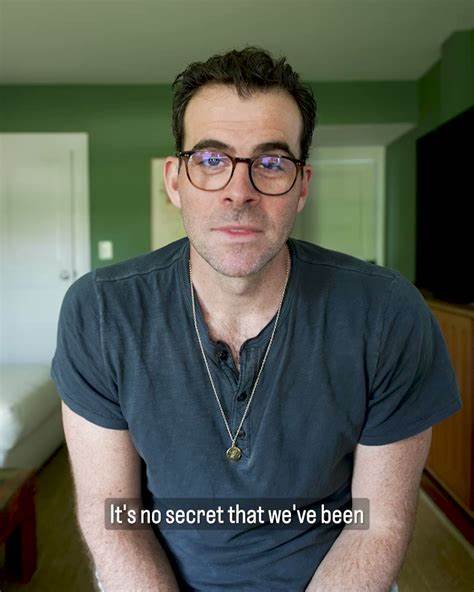

近日,Instagram 负责人 Adam Mosseri 发布了一段短视频,直接回应"Meta 会通过手机麦克风偷听用户谈话以投放广告"的流传说法。Mosseri 在视频中反复强调"我们没有监听你,也不会利用手机麦克风窃取你的对话",并列举了麦克风监听会导致电量迅速耗尽等技术上的不合理之处。恰巧同日,Meta 宣布将把用户与其 AI 聊天的内容用于广告个性化,这一时间点更让公众对隐私与数据使用的讨论升温。 要理解围绕这段视频的疑虑,需要把握三个维度:第一是人们为什么会觉得"被监听";第二是技术上是否可行以及实际代价是什么;第三是有哪些合法或者合规的替代解释,可以解释为何广告会在谈话后出现得异常精准。把这些维度并列起来看,能帮助普通用户、新闻从业者和监管者更冷静地评估风险与应对策略。 "我刚说了两句,广告就出现了"是一个典型的感知问题。

人们在日常生活中会频繁遇到正相关的经历,从心理学角度看,确认偏误和巧合放大会导致我们更容易记住那些看似"被追踪"的情形,而忽略大多数没有发生特殊关联的时刻。除此之外,广告生态本身依赖大量数据来源:浏览记录、应用内行为、搜索历史、社交互动、位置数据、第三方数据经纪人的离线购买记录、广告像素和 SDK 上传的跨站点行为等,都可以在不触及麦克风音频的情况下精确猜测用户兴趣。 技术层面上,偷偷通过麦克风持续监听用户确实存在实现路径,但并非低风险或低代价之举。无论是在 iOS 还是 Android 平台,应用要在后台持续获取麦克风音频通常需要明确权限,而且现代操作系统都在权限管理和电量提示层面做了限制。持续录音不仅会迅速消耗电池,还会产生可被监测的网络流量,将实时音频上传回服务器也意味着明显的数据传输特征。更重要的是,如果一家大型公司要靠常态化的秘密监听在大规模用户上投放广告,一旦被独立研究者或监管机构检测到,很可能面临严重的声誉和法律后果。

因此,从成本与风险角度判断,所谓"全面监听以便定向广告"的做法既不现实也不合算。 然而,这并不等于完全无风险。应用只要获得了麦克风权限,就有可能在用户不察觉的情况下记录声音,尤其是在一些权限管理不严格或存在恶意代码的第三方应用中更是如此。部分应用可能会在明确的功能需求之外滥用许可,或者通过漏洞、后门在用户不知情时激活麦克风。同时,需要强调的是,Meta 或 Instagram 公开声明不听取麦克风音频并不自动消除用户对其他隐私问题的担忧:应用仍能基于海量行为数据构建复杂的兴趣画像,AI 聊天记录若被用于广告个性化,也会带来新的同意与透明度挑战。 那么,广告为何会显得如此"可读心"?有若干常见且合理的解释。

用户在谈话前往往已经有过一次或多次相关的线上行为,比如搜索某个产品、查看相关网页、点击类似内容、在社交平台上浏览相关帖子,或者通过购物平台产生了浏览行为。广告系统会综合这些信号进行实时或近实时的竞价与投放,所以当用户在谈话后看到相关广告时,往往不是因为被偷听,而是许多数据点在恰当的时刻触发了广告展示。 另外,广告生态中广泛使用的技术也能解释高精准的展示效果。广告像素、SDK、跨设备跟踪、登录信息同步和离线转化数据(例如实体店购买与线上账户的匹配)都会帮助广告主将信息传递给广告平台,从而实现精准投放。第三方数据经纪人会汇聚来自信用卡、忠诚计划、问卷调查、电商平台等的用户属性,把这些信息卖给广告公司或平台,用以细分受众。这种基于广泛数据拼接而来的"猜测"在很多情形下比单纯的麦克风监听更加稳定且更具可扩展性。

除了数据驱动的精细定向之外,AI 驱动的个性化内容也在改变广告呈现方式。Meta 关于"将 AI 聊天用于广告个性化"的计划意味着用户与平台的对话内容可能被用于模型训练或信号生成,从而影响推荐与广告匹配。这在隐私合规性上提出了更高要求:用户是否明确同意?平台如何去标识和隔离敏感话题?是否提供便捷的撤回或删除对话数据的机制?这些都是监管者和公众应当关注的问题。 面对公众的担忧,企业层面的应对也尤为关键。像 Mosseri 这样的高管澄清能短期内缓和情绪,但长期信任建立依赖于持续的透明和外部监督。独立审计、技术透明报告(transparency reports)、隐私影响评估以及可验证的日志保存策略,都是增强可信度的必要步骤。

监管上,明确界定"使用对话内容进行广告定向"的法律边界与用户同意机制,将有助于减少灰色地带,并对滥用行为形成制约。 对于普通用户,有一系列实际可行的隐私防护措施可以降低被不必要追踪的风险。第一,应定期检查并收回不必要的麦克风与摄像头权限,尤其是那些不需要持续语音或视频输入的应用。现代操作系统提供了权限管理面板与隐私指示器(例如 iOS 的橙点与绿点提示,Android 的隐私指示器),用户应当熟悉这些功能并在手机上保持开启。第二,关闭后台应用刷新与定位共享,尤其是在未使用相关功能时;第三,审视广告个性化设置并选择限制广告跟踪或个性化广告的选项,清除应用活动记录与浏览器 cookie;第四,尽量减少在不可信来源下载安装应用,优先选择官方应用商店并关注应用的权限请求是否合理。 技术上更为主动的用户和研究人员可以通过网络流量监测工具来观察应用是否在后台上传大量未知数据或音频流,但这类方法对普通用户门槛较高且需谨慎操作,以免违反相关使用条款或影响设备稳定性。

相对易行的做法还包括在不使用手机时开启飞行模式或断开网络,以及在敏感对话场合关闭麦克风访问或使用实体麦克风开关的耳机。 媒体与监管机构也应扮演监督者角色,推动透明度提升并设计合理的检测框架。包括但不限于强制平台披露数据使用条款的可机读版本,提供独立第三方可验证的日志审计,设立举报与快速调查机制,以及对违规行为施以明确且具有威慑力的处罚。技术验证方面,鼓励独立研究者进行白盒与黑盒测试,通过行为检测、网络流量分析和设备侧传感器审计等手段检验平台是否在未获授权情况下访问或上传音频数据。 从更大的政策视角看,数字广告生态在未来可能需要朝向更具隐私保护的替代方案转型。当前一些隐私友好的技术方案,例如在终端设备上进行兴趣建模、联邦学习、差分隐私以及在不暴露原始对话文本的前提下生成汇总信号,能够在一定程度上平衡个性化服务与隐私保护。

这类方法允许平台在不传输明文敏感内容的情况下实现广告效果优化,但它们也需要透明的治理框架与严谨的技术评估来避免被表面化的"隐私包装"所掩盖。 总的来说,Adam Mosseri 的"我们没有监听你"声明触发的讨论并非单纯关于一则视频能否消除怀疑,而是在更深层次上反映出公众对现代广告技术、AI 与个人隐私之间界限的焦虑。这种焦虑既有合理成分,也有因认知偏差而放大的部分。对于用户而言,最重要的是采取可执行的防护措施并保持警觉;对于平台而言,承诺要通过透明度、审计与合规来赢回信任;对于监管者而言,需要尽快建立能够应对 AI 与广告融合带来新风险的规则与监督机制。 在未来的数字生态中,单靠一句"我们没有监听你"难以构建持久信任。更有意义的变化应来自可验证的技术实践、清晰的同意机制与有效的外部监督。

用户在等待这些制度性改进时,可以通过合理设置权限、审查隐私选项、关注平台透明报告和参与公共讨论来为自己的数字隐私争取更多保障。 。