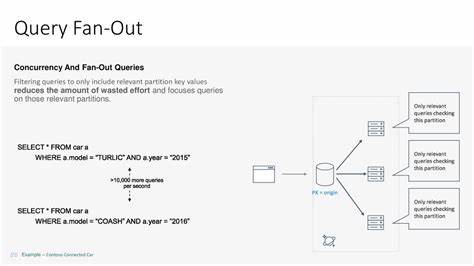

随着人工智能和搜索技术的不断进步,谷歌在查询改写领域的创新突破引起了业界广泛关注。查询扩散(Query Fan-Out)模型的提出,为搜索引擎优化和用户查询体验带来了革命性的变化。通过结合深度学习和向量空间模型,该技术能够自动生成大量优质的查询改写,显著提升搜索结果的相关性和丰富性。本文将深入解析谷歌查询扩散模型的训练过程、技术核心以及它在实际应用中的巨大潜力。 首先,理解查询扩散模型的基础依赖于现代神经检索器,如Google的GTR编码器,这类模型将查询和文档映射到共享的向量空间。在这个空间中,语义相似的查询和文档会聚集在相邻区域。

这意味着,相关文档形成的簇状结构为查询改写提供了全新的思路:通过沿向量空间中连接查询和目标文档的路径移动,可以生成越来越精准的查询表达。 谷歌的创新点在于通过潜在空间的逐步遍历,将数学上的线性插值应用于查询与相关文档的向量间。具体来说,给定一个初始查询向量和一个目标文档向量,模型会计算中间的多步点,这些点代表介于查询和文档主题之间的语义混合体。随后,利用训练好的“查询解码器”,将这些中间向量转化为自然语言查询。这种方法不仅保证了生成查询的语义连贯,还能捕捉到用户原始意图与搜索结果内容之间的重要语义桥梁。 查询解码器的训练是技术实现的关键。

谷歌采用基于T5的模型反转GTR编码器的嵌入,确保解码器能够以超高的余弦相似度(高达96%)重构输入向量对应的查询文本。这种近乎完美的向量到文本映射,使得从潜在空间中采样的每个点都能被正确地转换成具有明显信息量和检索价值的查询。 有了查询解码器的支持,谷歌从MSMarco数据集中获取查询与相关文档对,计算两者的嵌入,再沿着查询到文档向量的方向,分20步进行插值采样。对每一步生成的查询文本进行检索效果评估,只保留那些实际上提升了检索指标的查询。这种数据合成的方式一举生成了超过86万条高质量的训练样本,为后续的查询建议模型训练奠定了坚实的基础。 基于合成数据,谷歌进一步微调了大型T5模型,分别开发了纯查询输入(qsT5-plain)和查询加上伪相关文档反馈(qsT5)两种版本。

后者借助搜索结果作为上下文,实现了显著更优秀的查询改写能力。伪相关反馈的关键作用体现在消歧义、术语扩展以及意图定位上,使得模型能更精确地捕捉用户的搜索需求。例如,“python”这个词既可以指编程语言,也能指蛇。通过参考初步搜索结果,模型能够自动聚焦于用户实际感兴趣的语境。 这一训练与推理流程展现了深度学习在语义空间中的“隐式学习”现象。最终的qsT5模型不再需要显式执行向量加权计算,它内化了从查询到目标文档潜在路径的信息,能够基于上下文灵活生成多样化且高相关性的改写查询。

简言之,模型已经学会成为查询语义空间中的导航者,引导用户走向最优的搜索表达方式。 在实际应用中,用户输入初始查询后,系统会先进行一次常规的检索,并将前五条搜索结果传入qsT5模型,作为重写查询的上下文。模型生成的多条查询变体随后被并行用于搜索,形成更全面的结果覆盖。这种多查询策略不仅提升了检索效果指标如nDCG@10,更大幅丰富了搜索结果的多样化,满足了用户多元化信息需求。 综合来看,谷歌的查询扩散模型代表了搜索技术朝向自动化、连续自我优化和跨语言适应性的未来方向。该方法不依赖手工规则,依托潜在语义空间的结构特点和强大的解码能力,实现在无需人工干预的情况下生成高质量查询改写。

同时,模型设计允许通过解码器直观监控和调试,极大增强了系统的可解释性和信赖度。 从更广阔的视角来看,这种基于潜在空间的查询导航方案为搜索引擎开启了新的可能性。它促成了实时搜索适应、跨模态查询(如文本到图像)、以及基于语义路径的可解释性建议等前沿应用。甚至可以想象未来用户不再以静态文本形式提交查询,而是经历一场智能引导下的动态语义探索之旅,极大提高信息获取效率和满意度。 因此,谷歌训练的查询扩散模型不仅仅是一套技术方案,更是一种全新的搜索范式。它改变了我们对查询本质的认识,从静止的关键词替换,迈向动态的语义空间航行。

随着此类技术的逐渐成熟和普及,搜索引擎的智能化水平必将迎来质的飞跃,用户体验也将得到全方位的提升。未来,这一领域无疑将持续引领着人工智能在信息检索中的变革潮流,激发更多创新的研究和实际应用。