近年来,大型语言模型(LLM)的普及给人工智能领域带来了革命性变化,尤其是OpenAI发布的GPT系列,从GPT-2到GPT-3,再到现今复杂的GPT-4,其强大的自然语言生成能力不断刷新人们对AI的认知。然而,训练这样一个规模庞大的模型一般需要巨大的算力和资金投入,许多开发者和研究人员望而却步。正是在此背景下,karpathy团队推出的llm.c项目引起广泛关注。通过对GPT-2(124M参数版本)的复现实验,仅用90分钟和约20美元的成本,便能在单一8X A100 80GB SXM节点上完成训练,为资源有限的从业人员带来福音。本文将详细解析这一突破的技术原理和实践方法,帮助你快速掌握如何用有限预算高效训练大型语言模型。 GPT-2 124M模型作为早期的Transformer架构语言模型,虽然参数量较后续版本小很多,但依然可以胜任大量自然语言处理任务。

虽然OpenAI在2019年发布了GPT-2系列模型及其权重,想要完全复现训练过程却因为计算资源和数据集限制较难完成。llm.c项目的诞生打破了这一壁垒,利用纯C/CUDA实现核心训练逻辑,极大提升了计算效率,同时保持了相对简洁的代码规模,整体约4,000行代码,充分体现了工程上的精巧设计。 训练数据选择上,llm.c采用了FineWeb数据集的10亿令牌版本。FineWeb是近期整理的高质量互联网中文文本仓库,数据覆盖面广,能反映当代互联网语言风格。虽不完全等同于OpenAI当初使用的WebText,但FineWeb在验证集上的表现甚至优于OpenAI发布的原始模型权重,表明FineWeb具备良好的泛化能力和训练代表性。训练以12层Transformer为基础,12个自注意力头,隐藏层维度768,序列长度配置为1024,完全契合GPT-2官方结构标准。

硬件和成本方面,项目推荐使用Lambda Labs或类似平台上的8卡A100 80GB SXM节点,时租成本约14美元/小时。训练10亿令牌仅需90分钟,由此推断总花费约为20美元。若资源有限,单GPU亦可完成训练,但时间拉长至数小时至数十小时不等。该训练流程充分利用了GPU Tensor Core和cuDNN加速,结合FlashAttention等最新技术,达成约60%的理论峰值浮点运算效率,确保模型训练高效和稳定。 在具体操作上,用户需先安装Miniconda环境,配置PyTorch夜版及CUDA 12以上版本,确保GPU驱动兼容性和加速库正常加载。接着通过llm.c内置的fineweb.py脚本下载和预处理FineWeb数据,完成分片和二进制编码以优化加载性能。

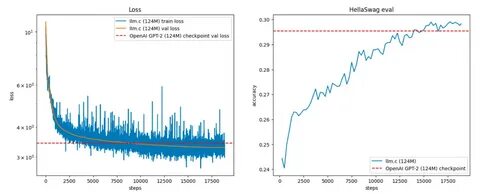

随后进行编译,启用Mixed Precision混合精度训练及cuDNN支持,实现显存和运算速度的最优均衡。训练命令中详细配置了批次大小、梯度累积步数、学习率计划、权重衰减、激活重新计算等参数,参考GPT-3论文的训练调度策略以确保收敛效率。 在训练过程中,系统将定期输出训练损失、梯度范数、学习率曲线及模型浮点运算利用率(MFU)。初始阶段模型预测困惑度较高,随着训练推进,困惑度逐渐降低,说明模型掌握了文本上下文规律。通过对FineWeb验证集以及HellaSwag问答基准测试的评估,模型表现略优于OpenAI原版GPT-2(124M),且达到接近GPT-3小型模型的水平。虽然训练令牌量差异较大(本项目10亿令牌,GPT-3约300亿令牌),但效果依然令人鼓舞,彰显llm.c训练策略的有效性。

值得注意的是,llm.c在dropout等正则化技术上尚未广泛启用,团队认为在大规模数据和合理超参数下,直接训练小型模型能够获得较为稳定的结果。此外,多GPU训练支持通过MPI通信实现参数同步,开启ZeRO-1优化阶段减少内存占用,方便扩展至多节点分布式环境,未来还有望支持更多硬件架构。 对于缺少预训练权重及解码支持的情况,llm.c设计了同步的Python训练脚本,能够导出GPT-2 tokenizer二进制文件,改善文本采样及推断体验。当前采样功能尚处于简陋阶段,条件文本生成需手工设置种子和起始tokens,但足以展现模型语言连贯度和上下文理解能力。每次随机采样都能生成结构完整、语义丰富的文本续写,体现了Transformer架构的强大泛化能力。 除124M版本外,团队还尝试复现350M参数规模的模型,训练令牌提升至300亿,耗时约14小时,总成本约200美元。

更大如740M甚至1.5B参数版本因计算资源需求上升,训练难度和费用加剧,预计1.5B版本需一周时间、小计2500美元预算。仍在代码优化、稳定性和多节点训练扩展方面持续改进,以期逐步降低训练门槛。 在社区反馈层面,llm.c获得GPU硬件爱好者和AI研究者的积极响应。许多用户分享了使用3090、4080、7900 XTX等不同显卡进行训练的经验,表明较高显存和显卡算力能显著缩短训练时间。此外,开源代码的活跃维护带动了多改进和问题讨论,促进了GPU资源低门槛利用和大模型训练民主化趋势。 总结来看,karpathy的llm.c项目不仅实现了开源、轻量级、跨平台的GPT-2训练框架,还凭借高效的算法和合理的硬件配置,将成本和时间压缩到普通开发者能够负担的范围内。

它为许多致力于自然语言处理、生成模型和机器学习的研究者提供了宝贵的实践路径。通过合理调整超参数和训练策略,任何人都可以尝试复现实用的语言模型,探索更多创新应用场景。 未来,随着更多的算法改进、多节点支持以及硬件兼容性的提升,llm.c有望推动大规模语言模型的普及和个性化定制。不论是教育科研还是工业实践,这一项目都代表了AI生态开放与共享的精神,为全球AI社区注入了新的活力和可能性。相信随着该项目的不断完善和推广,低门槛、高效率的大规模语言模型训练将不再遥不可及,激发更多富有创造力的AI应用 梦想从这里启航。 。