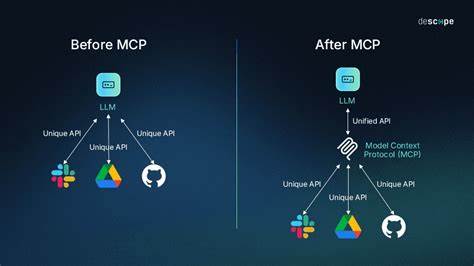

随着人工智能技术的飞速发展,越来越多的开发者和企业开始关注如何让API更好地服务于大型语言模型(LLM)及智能代理。模型上下文协议(Model Context Protocol,简称MCP)作为连接API与AI代理的桥梁,提供了标准化的交互方式,使得智能系统能够更高效地发现、理解并调用应用程序的功能。要想让API真正变得AI友好,关键在于MCP工具设计的科学与合理。本文将全面介绍MCP工具设计的核心要点,帮助开发者构建适应未来智能生态的API接口。 设计MCP工具时,首先必须深入理解LLM在工作时的上下文窗口限制。上下文窗口大小是影响模型性能的重要因素,它决定了模型处理和记忆信息的容量。

如果MCP服务器向AI代理暴露了过多的接口工具,每个工具又包含冗长的描述和复杂的输入参数,整体信息量极易超出模型上下文限制,造成模型无法有效利用全部工具。在实际经验中,精简且聚焦的上下文更有助于AI理解和使用工具,这意味着开发者要学会权衡工具数量、描述长度和输入复杂度,避免堆砌信息导致效率下降。 对于如何组织MCP工具架构,设计方法可以分为三条路径。第一种是将API的所有端点逐个暴露为单独的工具,这种直接策略简单易行,尤其适合结构清晰、接口简洁的API。第二种方法则是根据用途和权限选择部分端点暴露,避免将敏感信息或复杂操作暴露给智能代理,以保证安全性和应用稳定性。这种选择性开放提升了工具的实用性和安全等级。

第三种路径是创建复合工具,通过组合多个API端点的调用实现复杂操作,减少智能代理的调用频率,优化交互流程。复合工具有助于解决上下文窗口限制问题,同时提升用户体验。 MCP工具的设计细节同样不容忽视。工具名称需明确且具描述性,有助于LLM快速理解工具作用,避免因名称模糊引起多次错误调用。工具描述应简洁重点突出,既能传达核心功能,又不浪费上下文空间。在输入参数设计上,提倡简化结构,减少嵌套和复杂关系,优先使用默认值,实现对参数的有效估计和易用性。

此外,输出结果的设计也需合理,过于冗长的数据会消耗过多上下文资源,建议返回精炼且关键的信息,让智能代理能够快速做出推断或下一步操作。 在MCP服务器的建设过程中,测试与迭代是至关重要的环节。理论设计再完善,也无法替代真实环境下与多样LLM客户端的反复调试。不同的智能代理对MCP规范的支持程度各异,某些工具可能在一个代理表现良好,却在另一个代理中效果不佳。因此,开发者应采用端到端测试手段,观察实际调用情况,根据反馈不断调整工具参数、名称及描述,优化调用流程。针对常见错误,如参数误用、功能误解或者调用顺序低效,持续修正和完善,有助于提升整体可靠性和用户满意度。

针对输入模式特别复杂的API,设计者还需考虑对输入进行扁平化处理,消除不必要的结构层级,降低智能代理理解难度。在API设计层面,简化资源职责和接口功能,避免资源过多、功能臃肿,也能极大提升MCP工具的实用价值。此外,将不常用或测试阶段的端点暂时排除,减少干扰,也是保持服务器纯净与高效的重要策略。 MCP工具设计不只是单纯的技术问题,更是对API整体逻辑、用户需求和智能代理交互习惯的综合考量。良好的工具设计能够显著提升模型对接口的理解能力,使AI在自动化任务执行、智能决策辅助等方面发挥更大潜力。随着MCP在业内的快速普及,掌握科学合理的工具设计方法,将成为开发者赢得竞争优势的关键。

展望未来,MCP工具设计也将面临更高的要求和挑战,包括如何处理更大规模接口、适配多样化的AI代理,以及保障数据安全与隐私。在这条探索之路上,敏捷迭代、数据驱动和用户反馈将成为不断优化的基石。开发者应积极利用现有技术手段,测试各种设计方案,从实际使用中不断总结经验,推动智能API生态的健康发展。通过有针对性的设计和持续改进,MCP工具将真正成为连接智能时代应用与AI模型的桥梁,赋能各行各业的数据智能化升级。 总之,MCP工具设计是一项系统工程,涉及上下文管理、架构布局、参数简化、输出精炼和持续测试等多方面内容。理解并运用这些原则,能够帮助开发者构建高效、智能、易用的接口,满足未来AI生态的需求。

随着AI技术的不断进步与普及,深入掌握MCP工具设计已成为软件工程师和产品经理不可或缺的重要技能。拥抱MCP新的设计理念,结合自身业务特点,才能在智能化浪潮中脱颖而出,打造面向未来的AI驱动产品。