大型语言模型(LLM)作为当下人工智能领域的明星技术,已经深刻改变了自然语言处理的格局。随着模型规模的不断扩大和功能愈发强大,如何有效理解其内部工作机制成为了研究与应用中的一大挑战。可视化技术正是在这一背景下应运而生,旨在通过直观的图形展示帮助研究人员和开发者更好地解析模型行为、发现潜在问题,并优化模型性能。 大型语言模型的复杂性极高,其结构通常涉及数以亿计的参数和多层神经网络。传统上,这类模型的"黑箱"特性让人难以窥见其决策过程。可视化工具通过将模型中的注意力权重、激活模式以及输出向量等信息转化为可理解的图形,极大地提升了模型的透明度和可解释性。

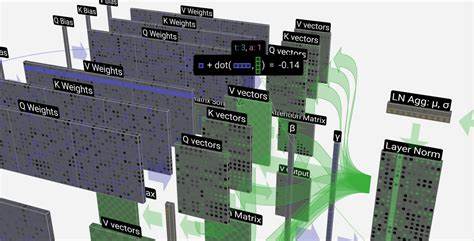

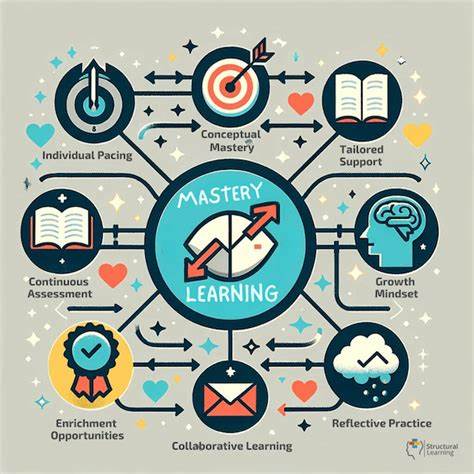

研究人员可以通过观察不同输入如何影响模型内部状态,进而评估模型的理解能力及潜在偏见。 在具体技术方面,注意力机制的可视化是目前应用最广泛的手段之一。注意力权重表现了模型在生成每一个词时关注的文本片段,通过图谱展示不同词语之间的关联,有助于揭示模型的上下文处理细节。此外,激活热图和层间关系图等也成为解析深层模型架构的重要工具。结合交互式界面,用户能够动态调整输入并实时观测模型反应,实现更加深入的模型分析。 可视化不仅为研究工作带来便利,也助推了模型调试和优化。

开发团队通过发现模型在特定情境下的异常表现,能够针对性地调整训练数据或微调参数,提升模型的稳定性和准确度。此外,面向非专业用户的可视化工具也逐渐涌现,使更多行业从业者能够借助大型语言模型实现智能化改造,无需深入代码即可把握模型运作本质。 随着人工智能道德规范的日益重视,模型可视化还承担着监督与审计的角色。通过透明展示模型决策流程,相关方可以更容易地识别潜在偏见和歧视风险,确保模型输出的公平性和可靠性。这对于金融、医疗等敏感领域的应用尤为重要,帮助构建更受信赖的智能系统。 展望未来,大型语言模型的可视化技术将更加多样化和智能化。

结合增强现实、虚拟现实技术,用户有望通过沉浸式体验深入剖析模型世界。同时,自动化可视化方案的发展将减少人工干预,提高分析效率。随着模型规模持续扩大,如何高效管理和展示信息将成为技术革新的关键。 此外,跨学科的融合也是推动可视化进步的重要动力。心理学、认知科学等领域的研究成果将助力构建更符合人类认知习惯的可视化界面,提升用户理解和操作体验。与此同时,开放式平台和社区共享机制也将促进技术交流和创新,加快可视化工具的普及和优化。

总之,大型语言模型的可视化技术在揭示复杂模型内部机制、提升应用性能及确保伦理合规等方面发挥着不可替代的作用。伴随着技术不断演进和应用场景的扩大,未来的可视化工具将更加智能、高效和人性化,助力人工智能在更多领域实现深度赋能和创新突破。 。