在现代信息化时代,文档管理成为各类机构和个人日益关注的重要问题。尤其是面对大量PDF格式文件,如何快速准确地进行分类与管理,成为提升工作效率的关键。传统的人力整理方式不仅耗时费力,还难以保障高效和精准。随着人工智能的发展,特别是大型语言模型(LLM)的崛起,利用本地部署的LLM进行PDF文件自动分类已成为可行且高效的解决方案。文章围绕“PDF Categorizer by Local LLMs”展开,深入探讨如何利用本地大型语言模型实现PDF文档的智能分类及自动整理,助力用户在海量文件中轻松找到所需内容,提高办公与学习效率。PDF文件作为信息传播和存档的重要载体,在教育、科研、企业办公、政府行政等多个领域扮演着重要角色。

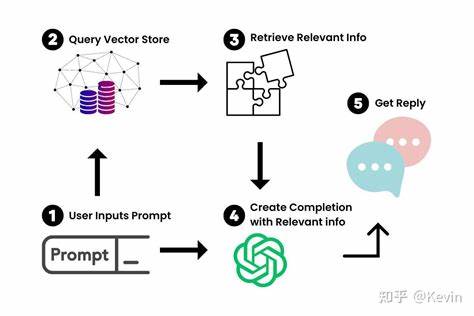

然而,文件数量日益增长过程中,若缺乏合理组织和分类,将直接影响检索速度与资源利用率。基于此,自动化分类工具的需求显得尤为迫切。传统分类通常依赖文件名、标签或人工输入的关键词,存在信息不全、分类错误率高等缺点。相比之下,利用大型语言模型结合内容理解能力,通过分析PDF内部文本和元数据,实现内容驱动的智能分类,能够带来更准确和细致的管理效果。PDF Categorizer项目采用本地部署的LLM,既保障数据隐私安全,也免除了对云服务的依赖,降低了运行成本和网络风险。该工具主要由两个核心模块组成。

第一模块为Categorizer.py,负责读取指定文件夹内所有PDF文件。它通过提取每个PDF文件的标题以及前若干页的文本内容,调用本地LLM的API接口,将文本信息转化成结构化数据,并基于预设提示词对每份文档进行主题归类。用户还可以通过编辑配置文件,针对提示语进行定制化调整,以提高分类的精准度与适用范围。所产生的结果会被记录保存至json格式的文件,方便后续处理和调用。第二核心模块为Organizer.py,作用是读取存储的分类结果文件,将对应PDF按照预测的分类标签自动移动至同名文件夹中。此举实现了文件的自动整理和归档,极大节省了人工操作时间,并形成清晰的文件目录结构,方便管理和查找。

如此一来,整个流程从文件读取、文本提取、智能分类到文件归档形成完整闭环,自动化优势显著。实现这一方案的技术依赖于本地部署的LLM模型,如gemma-3或mistral等,通过LM Studio这一本地大型语言模型平台搭建起兼容OpenAI接口的API服务,用户只需启动本地模型服务器,配置相应参数即可轻松实现。此模式保证了数据不会上传至云端,贴合对安全性和隐私性的较高要求,也减少了网络问题带来的干扰。此外,该项目使用的Python语言开发,使得其跨平台兼容性良好,便于二次开发与集成。部署环境只需安装相关依赖库,即可快速启动运行。整体使用方式灵活,用户仅需运行两个模块,先执行分类脚本生成分类信息,再执行整理脚本完成自动归档。

当前版本已实现基本功能且运行稳定,可根据具体需求进行个性化定制。相比普通关键词匹配,利用大型语言模型进行语义级别理解,可以更好地捕捉文本间细微差别,赋予分类结果更高的准确度。无论是针对科研文献、技术文档,还是商务合同、培训资料,均能做到快速且合理地归类,节约大量人工整理时间。另外,用户可根据业务场景调整扫描页数及提示内容,使模型聚焦更具代表性的文本片段,进一步提升效果。众多企业及个人用户面临的信息孤岛和内容冗余问题,通过部署本地PDF Categorizer系统,能在源头实现智能化管理,促进信息资源的有效整合。未来该项目有望集成更多智能化功能,如自动摘要、关键词提取和内容搜索等,为文档处理提供全方位的AI辅助。

此外,随着大型语言模型不断优化,分类能力也会持续提升,适应更多语言、多样化文件格式和复杂业务需求。总之,基于本地大型语言模型的PDF智能分类与整理技术,为文档管理带来了革命性变革。它不仅节约时间成本,提高数据安全,还能打造符合用户定制化需求的智慧文件生态环境。无论是企业提升数字化办公水平,还是科研人员高效管理文献资源,这一技术方案均具备广泛应用价值。随着技术日益成熟和普及,未来将迎来更加智能化、多功能的文件管理新时代,助推各行各业迈向数字智能化转型的深水区。如果您也在苦恼海量PDF文档的整理问题,不妨尝试基于本地LLM的PDF Categorizer方案,从根本上解放双手,实现文档管理自动化,提高办公效率,迈向智能化办公未来。

。