OpenAI作为人工智能领域的领军机构,自2015年成立之初便肩负着确保通用人工智能(AGI)惠及全人类的使命。然而,随着时间的推移,这一初衷遭遇了重重挑战,背后隐藏着诸多管理、文化及战略层面的争议。最新发布的“OpenAI档案”揭示了该组织在治理结构、领导诚信以及安全透明度等方面的深刻问题,反映出一个科技巨头如何在理想主义与商业利益的拉扯中不断调整自身定位。OpenAI的转型故事不仅是一个企业的发展轨迹,更是当代科技进步与伦理困境交织的缩影。OpenAI诞生于非营利性质的机构,旨在通过研究和开发安全、可控的AGI技术,造福人类。然而,到了2019年,因资金需求与市场压力,OpenAI引入了有限利润的商业子公司OpenAI LP,设定了投资回报上限意在平衡营利与使命感。

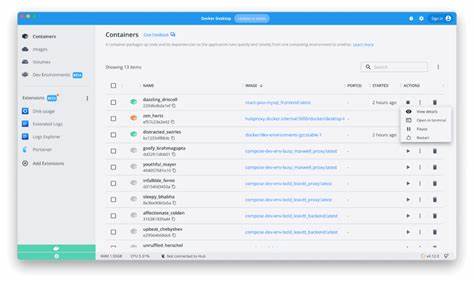

这个设计初衷在当时被视为极具创新性,旨在避免企业被纯粹的资本利益驱使,确保AI技术的伦理应用与安全。近年来,由于数十亿美元投资的进入,OpenAI开始出现结构调整的动向。最新的计划透露,OpenAI拟将之前设定的投资回报上限取消,并重塑为具有公共利益属性的股份有限公司。这一举措表面上强调继续平衡股东、利益相关者及公共利益,但实际上可能削弱了非营利董事会对公司的实质控制权。投资者的压力被视为关键推动力,他们要求取消回报上限以获得更大经济利益,而这与组织原本的使命产生了矛盾。改革后的OpenAI展现出强烈的商业化趋势,其估值已达数千亿美元规模,远远超出了最初的预期。

多年积累的内部报告和员工证词也映射出深层次的文化危机。多位高管和技术核心人员离职,公开表达对当前领导及方向的担忧,其中包括对CEO的领导方式持批评态度,质疑其在AGI安全责任上的能力。安全文化被描述为因追逐市场领先地位而被边缘化,透明度下降则加剧了外界对其道德和研发安全的担忧。在流程管理方面,据悉离职员工被迫签署极为严格的保密协议和不贬损条款,限制其公开发表对公司经营和文化的批评,这种高压的内部管理手段进一步加剧了公司环境的紧张氛围。外部媒体如《纽约时报》《华盛顿邮报》以及多家科技评论平台持续关注OpenAI的发展动态,披露了一系列与领导风格、治理方式相关的争议,揭露了这家曾经被视为行业榜样的科技公司如今面临的信任危机。这些事件促使业界重新审视AI研发的伦理边界和监管策略。

OpenAI档案不仅反映了一个企业的兴衰,更折射出现代科技公司在资本驱动、快速创新和社会责任三者之间难以调和的矛盾现状。面对如此困境,外部专家和观察者提出了一套愿景蓝图,以期指导OpenAI乃至整个AI行业实现真正的负责任治理与领导。建议包括加强组织治理结构,确保关键决策具备透明度和风险管理的严密性;领导层需以更高的伦理标准自我约束,杜绝利益冲突,重建员工和公众的信任;同时,必须落实对人工智能成果普惠共享的承诺,使得技术进步惠及更广泛社会群体,而非仅为资本所有者创造超额利润。在全球范围内,人工智能的影响日益深远,其潜力既孕育前所未有的繁荣,也蕴藏巨大的风险。OpenAI作为行业翘楚,其未来发展路线和治理模式将成为业界风向标。只有在尊重伦理原则和公共利益的基础上,才能避免技术发展的失控及社会的不公。

可以说,OpenAI正站在一个关键的十字路口。如何平衡理想主义和市场现实,如何在保持创新活力的同时保障安全和公平,将直接影响人工智能技术与社会的未来关系。未来的OpenAI若能积极采纳负责任的治理与多方利益协调机制,重新聚焦其创立时的初心,或许仍有可能引领AI走向一个真正惠及全人类的新时代。反之,则可能沦为资本巨头驱动下的科技帝国,背离其承诺,成为技术发展中亟待反思和警示的案例。无论结果如何,OpenAI的故事无疑为全球科技企业提供了深刻的教训和启发,提醒所有相关方关注技术背后的伦理考量,推动构建更加透明、安全和公平的人工智能生态系统。