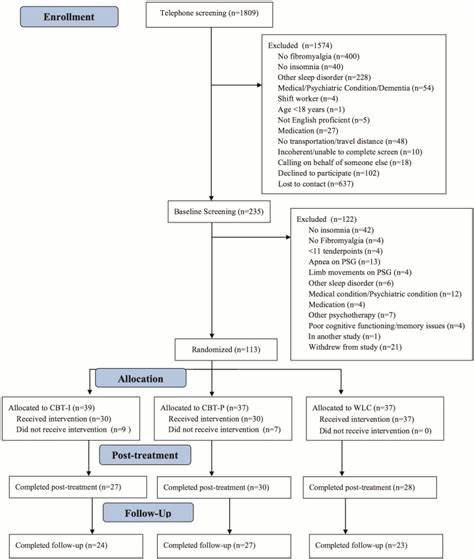

在当今高性能计算领域,图形处理单元(GPU)因其强大的并行处理能力,成为推动科学研究和工程创新的核心技术。CUDA作为NVIDIA推出的并行计算平台和编程模型,以其扩展的C++语言支持和简洁易用的API,极大地降低了GPU编程的门槛。橡树岭国家实验室(ORNL)作为美国能源部的旗舰科研机构,依托其雄厚的计算资源与科研实力,联合NVIDIA推出了系统化的CUDA培训系列,旨在助力广大开发者理解并掌握CUDA编程技术,提升GPU计算的效率和性能。 该培训系列涵盖了从CUDA C++的基础知识到高级优化技巧的丰富内容,适合既有GPU编程经验的用户,也对初学者极具价值。培训以线上形式展开,包含13个专题,每节课持续一个小时,辅以实操训练,确保学员在理论学习的同时能够充分消化和应用知识。课程讲解由NVIDIA专家远程主持,随后的实操环节则有ORNL、NERSC(国家能源研究科学计算中心)及NVIDIA的技术支持人员协助,形成覆盖理论到实战的完整学习体系。

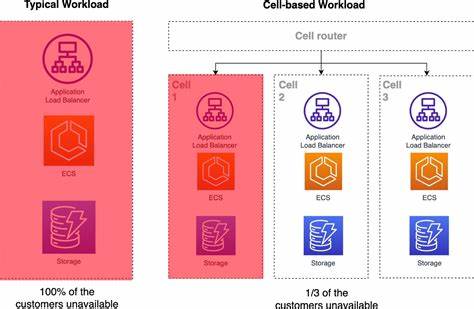

培训首要讲授内容便是CUDA C++的基础,介绍CUDA结构、线程模型和核心概念,为后续课程打下坚实基础。学员通过实际编程练习,加深对CUDA kernel编写、内存管理和线程同步的理解。随后课程逐步引入共享内存、原子操作与归约(reduction)、Warp Shuffle等进阶主题,提高程序执行效率和资源利用率。针对性能优化,培训分两部分深入探讨了关键策略与技术,帮助用户识别性能瓶颈,进行合理的代码调优,从而发挥GPU最大的计算潜力。 管理内存的讲解同样尤为重要,CUDA的托管内存简化了内存的分配和迁移,提升开发效率。课程还涉及CUDA的并发执行模型,多线程流以及多进程服务(MPS),使学员能够设计复杂的异步任务调度,提升计算资源利用率。

性能分析章节则教导如何借助NVIDIA的Profiling工具,量化程序性能指标,精准诊断程序问题。 此外,培训还介绍了合作组(Cooperative Groups)编程模型,提供了新的线程协作机制,使数据交换和同步更加灵活和高效。调试技巧的学习能够帮助开发者排查复杂GPU程序中出现的错误,保证代码的健壮性。最后,CUDA图(CUDA Graphs)模块展示了新的任务执行流图技术,进一步降低调度开销,优化复杂计算工作负载的管理。 ORNL承载着引领下一代超级计算机发展的使命,其计算平台如Summit、Frontier及Discovery等均支持大规模CUDA计算。尽管此次培训对远程用户在临时访问硬件资源上有所限制,如无法临时获得Summit或Theta GPU系统访问权限,但提供了NERSC的Cori GPU系统临时接入,确保学员能参与实际的GPU编程实践。

培训演讲视频和练习资源均公开托管于Github,方便学员自主复习和研究。 通过系统而全面的CUDA培训,学员不仅能够掌握并行程序设计基础,提高代码性能,还能够深入了解先进的CUDA功能和优化理念。这种面向科研与工业应用的培训,推动了GPU计算技术的普及和发展,为科研人员和工程师开启了高效利用超级计算资源的新路径。对于高校、研究院所及企业的GPU开发者而言,参与橡树岭国家实验室的CUDA培训系列,既是提升自身技术实力的绝佳机会,也将助力其在大数据分析、人工智能、生物信息学、物理模拟等众多领域取得突破。 展望未来,随着Exascale(百亿亿次)超级计算时代的到来,CUDA及GPU并行计算技术的重要性与日俱增。ORNL作为美国DOE的重要科技支柱,将持续提供高质量的培训和支持,助力全球计算科学社区发挥计算潜能,引领创新发展。

无论是初学者还是资深开发者,橡树岭国家实验室的CUDA培训系列都是进入GPU高性能计算世界的理想起点。 。