随着人工智能技术的不断进步,大型语言模型(Large Language Models, 简称LLM)在各领域的应用越来越广泛。无论是自动写作、翻译还是内容生成,LLM都显示出强大的语言理解和生产能力。然而,作为复杂的神经网络系统,这些模型在生成文本时往往会展示出某些"偏好"或"倾向",比如对某些主题、风格乃至颜色的偏好。这种偏好虽然看似无关紧要,但对模型的输出风格和内容选择有着潜在的影响。近期,研究者们提出了一种名为"定向向量"(Steering Vector)的技术,能够在不改变模型结构和参数的前提下,精准地引导模型表现出不同的"偏好",例如改变模型"喜欢的颜色"。这项技术的核心理念及其应用价值值得深入探讨。

大型语言模型的"偏好颜色"并非字面意义上的颜色,而是指模型在生成内容时对某些颜色词汇或相关描述的偏向性。模型训练过程中接收海量文本数据,其中某些颜色词汇或表达可能出现频率较高,导致模型倾向于更频繁地使用这些颜色描述。比如某个模型可能更"偏爱"蓝色,因此在生成场景描写、产品推荐乃至艺术相关文本时,蓝色出现的概率较高。虽然这种偏好不会影响模型整体的语言逻辑和表达能力,但对于一些有特定需求的应用场景,调整这种"偏好颜色"非常有必要。定向向量的出现正好解决了这个问题。定向向量是一种利用向量空间中的方向性来修改模型输出特征的技术。

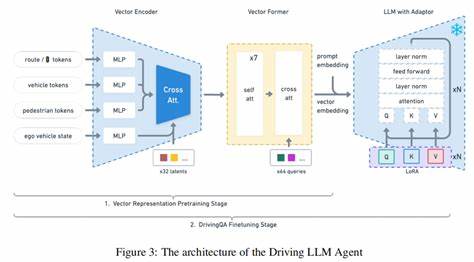

简单来说,定向向量是在模型的潜在语义空间中设计的一条特殊向量,通过将输入向量加上这个定向向量,可以驱动模型在生成文本时朝特定的方向偏移。通过合理设计这条定向向量,研究人员能够使模型在内容生成时更倾向于某个颜色或者减少对某颜色的使用。实现这一机制的关键在于对大规模模型内部语义空间的理解与精确操作。大型语言模型本质上是高维度的向量空间映射系统,每一个词汇或短语都对应着一个多维的向量表示。当模型对输入文本进行处理时,词向量在语义空间中发生连续变换,最终输出对文本的预测结果。通过分析模型对颜色相关词汇的响应,我们可以提取出代表某一颜色倾向的方向向量。

将这个方向向量作为定向向量引入,可以在推理阶段对模型输出起到引导作用。例如,如果希望模型表达更多关于红色的内容,可以设计一个增强红色表达的定向向量。这个向量会引导模型在生成过程中优先使用红色相关的词汇或描述,而降低对其他颜色的偏好。这种方法的优势在于灵活且非侵入性,不需要重新训练整个模型,节省了大量计算资源,同时可以定制化调整模型输出,从而满足不同用户或应用需求。实际应用方面,定向向量技术具备广泛的潜力。在内容创作领域,用户可以基于个人或品牌偏好调整模型表达,增强文本的一致性与个性化。

例如,时尚品牌可能偏好某种代表品牌形象的颜色,利用定向向量调整可以让AI写作工具生成更多符合品牌调性的内容。在产品设计和营销推广中,定向向量帮助企业精准传递视觉信息,提高消费者的情感共鸣。教育和心理健康领域同样可以受益,通过改变模型对颜色描述的敏感度,辅助视觉元素相关的教学和治疗方案的设计。此外,定向向量还能用于改善模型对少数派语言或文化偏好的表达能力,促进语言模型的多样性和包容性。挑战方面,虽然定向向量为调整大型语言模型输出提供了强大工具,但其效果受到向量设计精度和模型内语义结构复杂度的制约。设计定向向量需要对模型内隐语义空间有深入理解,还需大量实验调优,确保引导效果自然且不损害文本质量。

此外,过度依赖定向向量可能导致模型输出缺乏多样性,陷入某种"偏向固化"。未来,结合增强学习、元学习等技术,为定向向量设计引入自动化优化机制,将是提升该技术实用性的重要方向。总结来看,通过定向向量改变大型语言模型"偏好颜色"的方法,不仅丰富了对模型内部工作机制的理解,也为实际应用提供了创新路径。它体现了AI模型操控技术向细粒度、个性化发展的趋势,有望在内容创作、品牌传播、教育乃至文化传承等领域带来深远影响。随着相关技术的成熟与推广,我们将见证越来越多基于用户需求定制的智能语言模型,真正实现人与AI的高效协作与共创。 。