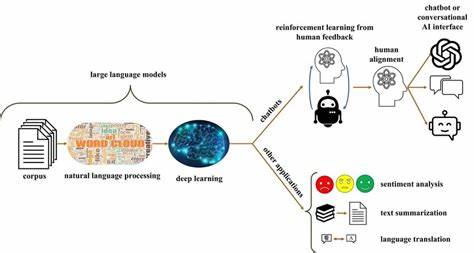

随着人工智能技术的迅猛发展,大语言模型(LLM)在多个领域展现出了强大的能力,极大地推动了自然语言处理和生成的革新。然而,围绕训练这些模型所需大量数据的来源问题,尤其是涉及版权保护作品的使用,产生了广泛的法律和伦理争议。本文将详细分析使用受版权保护作品训练大语言模型是否合法,结合美国版权法公平使用条款的四大因素以及近期美国法院判例,深入探讨其背后的法律逻辑及对未来内容创作和法律体系可能带来的影响。近年来,美国旧金山的两起备受关注的法院裁决,为LLM训练中涉及版权的争议提供了重要法律参考。首起裁决支持Anthropic公司在训练其Claude大语言模型时合理使用版权作品,另一则判决则支持Meta公司利用版权作品训练Llama模型,驳回了作家们的诉讼请求。这些判决反映出美国法院在判断LLM训练版权合理使用时趋于支持开发者,认为这种使用方式在一定程度上符合法律的公允原则。

理解公平使用原则对于判断此类案件至关重要。首先,版权法为判断合理使用提供了四个考量因素。第一是使用的目的和性质,尤其是是否具有商业性质以及是否具有转化性。Anthropic作为一家公益公司,Meta的Llama模型则免费开放,OpenAI母公司亦为非营利性机构,这在一定程度上体现了它们在组织结构和服务定位上努力符合合理使用的要求。与此同时,训练过程被认为具有高转化性——模型权重无法复现原作文本,数据内容在训练后转化为算法参数而非简单复制文本。然而,一些LLM在生成内容时偶尔会输出原文,这仍然是版权风险存在的一个方面。

第二个考量因素是受版权保护作品的性质。版权法旨在保护表达形式,而非事实与理念。LLM训练可视为将海量作品的内容提炼为事实和语言模式,通过参数表现。而作品的具体表达并未被直接复制,而是作为语言生成能力的基础被间接融入。因此,在一定程度上它符合保护公共领域事实、理念不被私有化的立法精神。此外,部分训练数据来源于开放源码软件和采用创意共享许可的内容,这在合法性上更具优势。

第三个因素是所使用作品的数量和重要性。在数以万计乃至万亿级别参数构建的模型中,单一作品所占比例微乎其微,不构成对作品核心价值的直接占用。第四个因素关注使用行为对版权作品潜在市场和价值的影响。一些观点认为,LLM的广泛使用可能间接削弱传统版权作品的市场,尤其是非虚构类书籍,因为用户可能转向通过AI获取信息而非购买作品。但这种市场影响尚缺乏实证证据,且对开放内容及软件的影响更为有限。总结以上四个因素及法院判例,不难看出目前美国版权法框架内,使用版权作品训练大语言模型在合理使用边界内具有法律基础,但这种界限并非绝对,仍存在争议和法律发展空间。

对于内容创作者而言,LLM训练带来的挑战不可忽视。生成式AI改变了知识获取和内容生产的方式,部分作品在被训练后可能因内容被直接生成而减少市场需求,进而削弱作者的收益和激励机制。这种“知识生态的退化”现象引发了业界和法律界的广泛关注,呼吁对现有版权制度进行改革。未来版权法应关注针对训练数据使用的特定规定,明确规定训练大语言模型应视为衍生作品,需取得相应版权授权。通过引入类似私有复制征费的机制,实现对原作作者的合理补偿和署名,保护其持续创作动力。这与过去对音乐版权在音频复制技术普及时所采取的应对措施有相似之处。

此外,数字时代下版权保护与创新推动的平衡尤为重要。过于严格的版权保护可能阻碍人工智能及相关技术的发展,而缺乏合理保护则可能侵蚀原创动力。法律体系和业界需共同探索合理的共享与授权模式,实现技术进步与版权保护共赢。总的来看,当前美国法院判决倾向于认可大语言模型训练中合理使用版权作品,体现出法律体系对技术变革的适应性与包容性。然而,随着技术和应用的进一步发展,版权法律必须不断优化,切实保障内容创作者的权益,推动健康可持续的知识创新生态建设。内容创作者、技术企业与法律制定者应积极对话,推动建立明确、公平的版权授权机制,保障文化艺术的繁荣与科技创新的进步并行不悖。

在这一过程中,公众意识的提升和跨领域合作同样关键,只有多方协作才能应对人工智能时代版权保护的复杂挑战,并推动知识社会的良性发展。