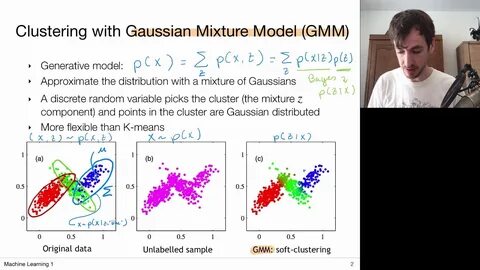

随着深度学习技术的不断进步,神经网络结构的创新越来越成为推动人工智能领域发展的关键力量。传统神经网络通常通过加权求和后利用固定非线性激活函数来处理数据,然而这种方法在表达复杂概率分布和处理数据中的不确定性时存在一定的局限。为了解决这些挑战,uGMM-NN(单变量高斯混合模型神经网络)应运而生,成为深度学习与概率模型融合的一大突破。uGMM-NN的核心理念在于每一个神经元的激活不仅仅是一个确定的数值,而是用单变量高斯混合模型来参数化,这意味着每个神经元的输出由多个高斯分布组成,涵盖了均值、方差和混合系数三个可学习参数。通过这种设计,网络能够在神经元层面捕捉多模态信息和不确定性,进而实现比传统神经网络更丰富和更灵活的表达能力。uGMM-NN不仅继承了标准前馈网络的可扩展性,还融入了概率推理的优势,成为处理复杂分布和提升模型解释性的全新选择。

其在分类任务中的表现同样具有竞争力,甚至在某些场景中优于传统多层感知器(MLP)。此外,uGMM-NN的概率解释能力为后续设计更复杂的、不确定性驱动的模型提供了理想基础。相较于传统神经元只是单一激活值的输出,uGMM-NN的神经元输出是一组可能的概率分布,这使得模型具备更强的鲁棒性和对噪声数据的适应能力,尤其在实际应用中面对数据漂移和缺失时展现出更好的稳定性。另一方面,模型内部高斯混合分布的参数可由训练过程自动调整,实现了端到端的优化流程。这种结合深度学习和统计建模的方法顺应了人工智能对模型透明度和可解释性日益增长的需求。入门级别的机器学习算法往往难以直接反映预测结果背后的不确定性,而uGMM-NN不仅能够给出预测结果,还能提供其概率分布,帮助用户做出更合理的决策。

更为重要的是,uGMM-NN为未来将生成式模型和判别式模型的边界打破提供了新途径。由于每个神经元内部采用混合高斯模型,它能够更好地捕获数据的复杂结构和多模态特性,使得生成多样性的样本成为可能,进而在图像生成、自然语言处理及强化学习等领域发挥更大潜力。此外,uGMM-NN的灵活架构同样支持与其他神经网络形式集成,从而提升整个网络的概率推理能力。例如,将uGMM-NN作为基础组件引入更大规模的深度学习模型,有望实现深度神经网络在不确定性估计方面的突破。结合现代硬件的加速优势和高效的训练算法,uGMM-NN展现出较好的计算效率,能够被实际部署于工业系统中。学术界对于uGMM-NN的关注日益增加,相关研究不仅验证了其理论可行性,也探讨了其在图像识别、时间序列分析及异常检测等多样化应用中的表现。

与此同时,uGMM-NN的独特结构也促使研究者们进一步思考如何优化模型参数学习策略,兼顾表达能力和计算资源需求。作为一种新兴的神经网络架构,uGMM-NN代表了深度学习走向概率化表达的重要方向。它结合了统计学的严谨性和深度学习的表达能力,突破了传统神经元功能的局限,提供了一个能够捕获多模态信息和不确定性的统一框架。随着人工智能技术向更高级的解释性、更强的鲁棒性和更广泛的应用场景发展,uGMM-NN无疑将成为未来研究与实践的重要组成部分。综上所述,uGMM-NN不仅丰富了神经网络设计的思路,也为应对复杂数据中的不确定性挑战提供了有效工具。它在保持传统神经网络优势的基础上,增加了对概率分布的建模能力,使得模型的输出更具信息量和可靠性。

随着进一步的理论完善和实际应用验证,uGMM-NN有望推动深度学习迈入一个兼具精度与解释力的新时代,为人工智能技术的发展注入新的动力。 。